ComfyUI Sonic ワークフロー、デジタル人動画生成

Sonic はテンセントがオープンソースしたデジタル人モデルで、画像と音声を入力するだけで良好な動画効果を出力できます。

以下は元の Sonic に関連するリンクです。 プロジェクトページ:https://jixiaozhong.github.io/Sonic/ オンライン体験:http://demo.sonic.jixiaozhong.online/ プロジェクトソースコード:https://github.com/jixiaozhong/Sonic

最近、コミュニティのユーザーが対応するプラグイン統合を完了しました。本チュートリアルは ComfyUI_Sonic プラグインに基づいており、Sonic の公式サンプル効果を再現します。

現在、このワークフローを実行する際にいくつかの問題があります。後のテストが完了した後、対応する説明をこのチュートリアルに追加する予定です。

1. ComfyUI Sonic プラグインのインストール

このワークフローは以下のプラグインに依存しています。開始前にプラグインと依存関係のインストールを完了していることを確認してください。または、ワークフローをダウンロードした後、ComfyUI-manager を使用して不足しているノードをインストールしてください。

ComfyUI_Sonic: https://github.com/smthemex/ComfyUI_Sonic ComfyUI-VideoHelperSuite: https://github.com/Kosinkadink/ComfyUI-VideoHelperSuite

インストールに不慣れな場合は、ComfyUI プラグインインストールチュートリアルを参照して、対応するプラグインのインストールを完了してください。

2. Sonic 関連モデルのダウンロードとインストール

プラグインリポジトリの作者が対応するプラグインのダウンロードを提供しています。以下のモデルリンクが無効またはアクセスできない場合は、プラグイン作者のリポジトリを訪れて更新があるか確認してください。

モデルを保存する場所は以下の通りです。ダウンロードしたモデルを対応する場所に保存してください。

📁ComfyUI

├── 📁models

│ ├── 📁checkpoints

│ │ └── 📁video // videoフォルダは主にモデルの分類に使用されますが、このフォルダを作成しなくても構いません

│ │ └── svd_xt_1_1.safetensors // svd_xt.safetensors または svd_xt_1_1.safetensors モデルファイル

│ └── 📁sonic // sonicフォルダを新しく作成し、すべての内容をこのフォルダに保存してください。この部分の内容はGoogle Driveから来ています

│ ├── 📁 whisper-tiny

│ │ ├── config.json

│ │ ├── model.safetensors

│ │ └── preprocessor_config.json

│ ├── 📁 RIFE

│ │ └── flownet.pkl

│ ├── audio2bucket.pth

│ ├── audio2token.pth

│ ├── unet.pth

│ └── yoloface_v5m.pt2.1 Stable video diffusion の下の2つのモデルから1つを選択してください:

svd_xt_1_1.safetensors https://huggingface.co/stabilityai/stable-video-diffusion-img2vid-xt-1-1/tree/main svd_xt_1_1.safetensors https://huggingface.co/stabilityai/stable-video-diffusion-img2vid-xt-1-1/tree/main

2.2 Sonic 関連モデルのダウンロード

以下のリンクにアクセスし、フォルダ内のすべてのリソースをダウンロードしてください。 sonic関連モデル: https://drive.google.com/drive/folders/1oe8VTPUy0-MHHW2a_NJ1F8xL-0VN5G7W

2.3 whisper-tiny モデルのダウンロード

whisper-tiny https://huggingface.co/openai/whisper-tiny/tree/main

以下の3つのファイルのみをダウンロードしてください。

- config.json

- model.safetensors

- preprocessor_config.json

ComfyUI Sonic ワークフロー関連素材

以下の音声、写真、およびワークフローファイルをダウンロードするか、自分の素材を使用してください。

画像:

音声は、サンプル部分の任意の音声をダウンロードしてください: https://github.com/smthemex/ComfyUI_Sonic/tree/main/examples/wav

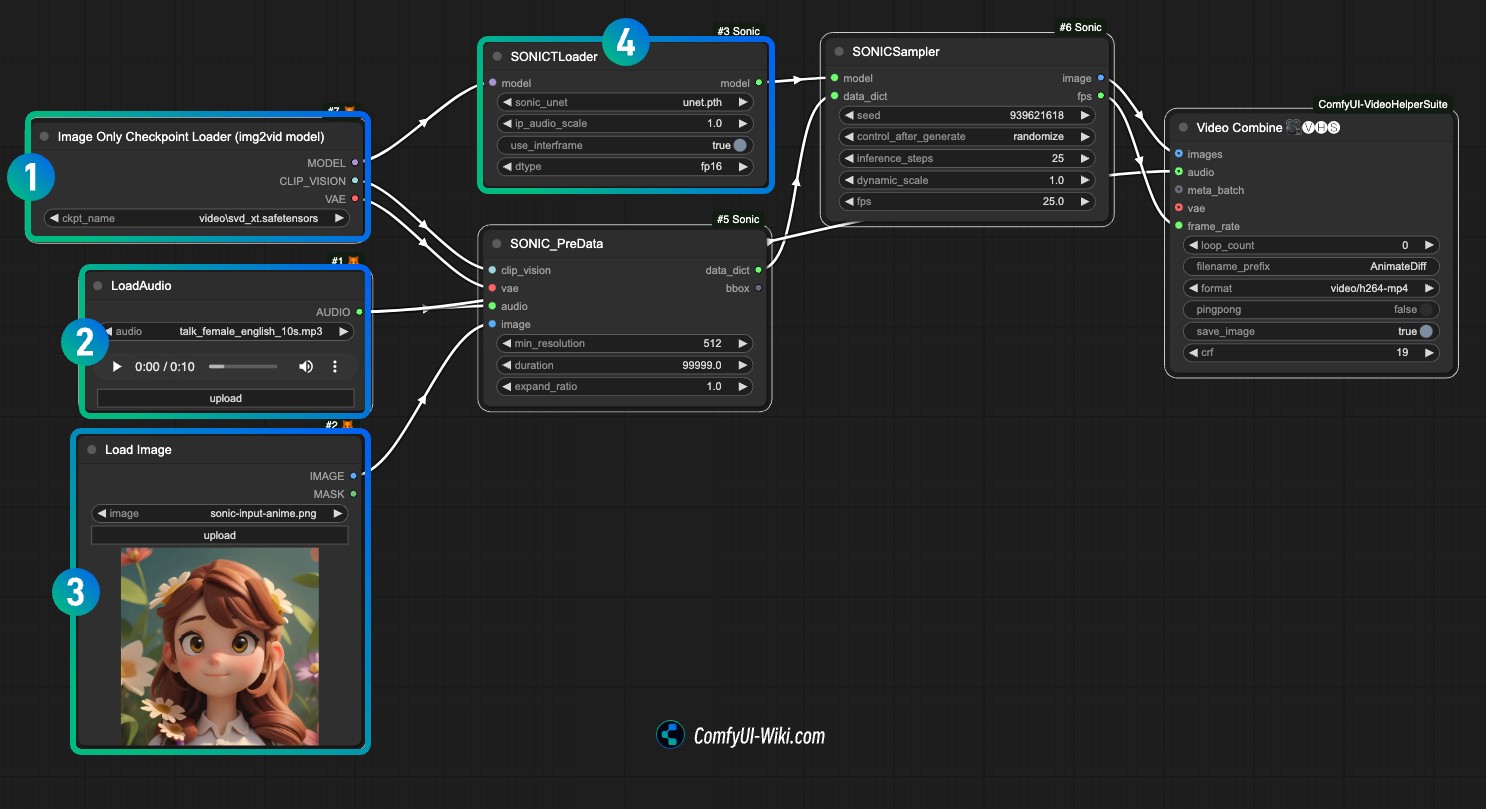

ComfyUI Sonic ワークフローの説明

- 番号

1の場所で、stable video diffusion 関連モデルをロードします(例:svd_xt_1_1.safetensors)。 - 番号

2の場所で、音声ファイルをアップロードし、音声ファイルをロードします。 - 番号

3の場所で、サンプル画像をアップロードします。 - 番号

4の場所で、unet.pth モデルファイルをロードします。 - Queue またはショートカット

Ctrl(Command)+Enterを使用して、ワークフローを実行し、画像を生成します。

問題解決

- transformers バージョンの問題 このプラグインは transformers==4.43.2 を使用する必要があります。ワークフローが正常に動作しない場合は、以下を修正してください。

📁ComfyUI

├── 📁custom_nodes

│ └── 📁ComfyUI_Sonic // プラグインディレクトリ

│ └── requirements.txt // 依存ファイルrequirements.txt ファイルの中を修正してください

#transformers ==4.43.2*#*の記号を削除してください

transformers ==4.43.2ComfyUIを再起動するか、pipを使用して依存関係をインストールしてください。

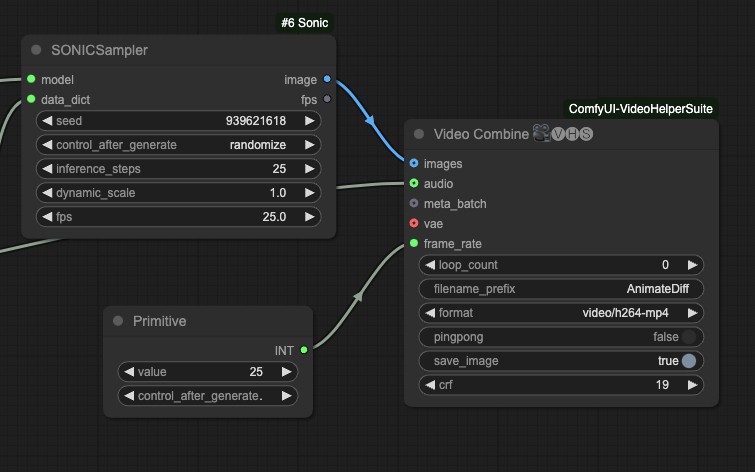

- frame_rateの型不一致の問題

最後のノードで数値型の不一致の問題に直面しました。primitiveノードを入力として使用してみました。

その他、現在このワークフローはまだテスト中ですので、より良い解決策があればコメント欄にお知らせください。迅速にこのチュートリアルに更新します。