ComfyUI Wiki

💡 多くのコンテンツがまだ更新中です。

AIGCをマスターするためのオンラインComfyUIチュートリアルドキュメント [非公式]

ComfyUIを初めて使う?始めましょう!

ComfyUIを実行する方法を選択してください。

ComfyUI Desktop インストールガイド

ComfyUI公式のWindowsおよびMacバージョンのワンクリックインストーラー

ドキュメントを読むWindowsでComfyUIを実行する

WindowsでComfyUIをインストールして実行するガイド。

ドキュメントを読むLinuxでComfyUIを実行する

LinuxでComfyUIをインストールして実行するガイド。

ドキュメントを読むMacでComfyUIを実行する

MacでComfyUIをインストールして実行するガイド。

ドキュメントを読むクラウドでComfyUIを実行する

クラウドインストールまたは無料でComfyUIを実行するプラットフォーム

ドキュメントを読むGitをインストールする

後でプラグインやモデルのダウンロードとインストールを容易にするために、Gitの使用に慣れてください。

ドキュメントを読むAaaki Launcherを使用してComfyUIを実行する

Aaaki Launcherは、中国の著者aaakiによって開発されたComfyUIアシスタントで、中国語、日本語、英語に対応しています。

ドキュメントを読むComfyUI モデルインストールガイド

ComfyUI 上の様々なタイプのモデルのインストール方法

ドキュメントを読むComfyUI インターフェイスガイド

ComfyUIのインターフェイスレイアウト、基本操作、ショートカットについて学ぶ

1. 基本インターフェース

このガイドは、ComfyUIのユーザーインターフェースに関する包括的な概要を提供し、基本操作、メニュー設定、ノード操作、その他の一般的なユーザーインターフェースオプションを含みます。

ドキュメントを読む2. ノード操作ガイド

このガイドでは、ComfyUIのノードインターフェース、メニューオプション、エラー状態、および一般的な操作について包括的な説明を提供します。

ドキュメントを読む3. ワークフロー

ComfyUI ワークフローの基本概念、使用方法、インポート/エクスポートなどの操作について詳しく説明します。初心者向けの入門ガイドです。

ドキュメントを読む4. プロンプト

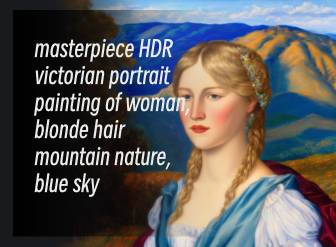

このガイドは、ComfyUIプロンプトテクニックの包括的な概要を提供します。

ドキュメントを読む5. ファイル構造

ComfyUIインストールパッケージのフォルダ構造に関する包括的なガイド。ComfyUIセットアップ内の各ディレクトリとファイルの目的と内容について学びます。

ドキュメントを読むマスクエディタ - ComfyUI マスクエディタの使用方法と設定ガイド

ComfyUIのマスクエディタの使用方法と設定について詳しく説明するガイド

ドキュメントを読む部分実行 - ComfyUIでノードの一部のみを実行することを許可

ComfyUIで部分実行(Partial Execution)機能の使用方法と条件

ドキュメントを読むサブグラフ機能 - ComfyUIのワークフロー整理ツール

ComfyUIでサブグラフ(Subgraph)機能の使用方法を説明し、サブグラフの作成、ナビゲーション、管理方法を含みます

ドキュメントを読むワークフローテンプレート - ComfyUIのワークフローテンプレートを開いて使用する方法

テンプレートはComfyUIでネイティブにサポートされているモデルワークフローとカスタムノードが提供するサンプルワークフローを提供します。テンプレートで現在サポートされている関連モデルのワークフローを見つけて使用できます。

ドキュメントを読む1. 設定メニュー

本章ではComfyUIシステムのメニュー設定オプションについて説明します

ドキュメントを読む2. Comfy

ComfyUI設定メニューの設定オプションの詳細な説明

ドキュメントを読む3. Lite Graph

ComfyUIのインターフェース関連設定の紹介。キャンバス設定、グラフ設定、リンク設定、ノード設定などの設定オプションを含みます

ドキュメントを読む4. 外観

ComfyUI 外観メニュー(Appearance)設定オプションに関する詳細説明、テーマスタイルの設定、自分好みのテーマ設定、サイドバー設定など一連の外観設定

ドキュメントを読む5. キー割り当て

ComfyUIの一般的なショートカットとそれらをカスタマイズする方法

ドキュメントを読む6. 拡張

ComfyUI設定メニューにおける拡張機能設定の説明と機能解説

ドキュメントを読む7. サーバー設定

ComfyUI サーバー関連の設定およびネットワーク設定、LAN共有などの説明

ドキュメントを読む8. 情報

ドキュメントを読むComfyUI 基本チュートリアル

ComfyUIの基本概念と基本機能を学ぶ

このチュートリアルでは、ComfyUIにおける3つの異なる画像拡大方法を紹介します:ピクセルリサンプリング、SD二次サンプリング拡大、および専用の拡大モデルの使用。それぞれの方法には特徴と適用シーンがあります。

ComfyUI 高度なチュートリアル

ComfyUIの高度な機能とカスタマイズ技術を深く掘り下げる

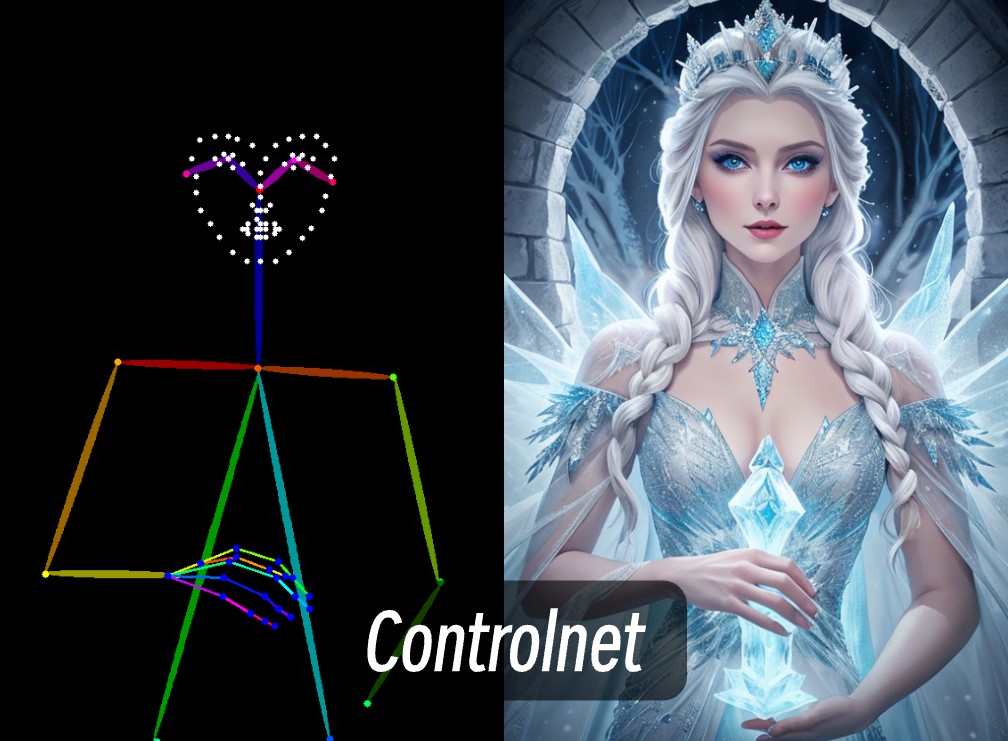

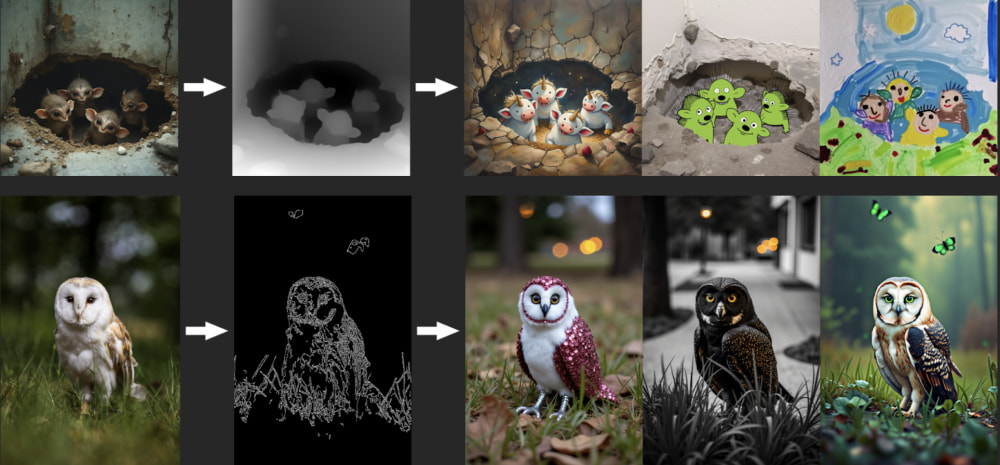

このチュートリアルでは、ComfyUIでのCanny ControlNetの使用方法について、インストール、ワークフローの使用、パラメータの調整など、初心者向けに詳しく説明します。

このチュートリアルでは、ComfyUIでのDepth ControlNetの使用方法について、インストール設定、ワークフローの使用、パラメータ調整など詳しく説明し、画像の深度情報と空間構造をより良くコントロールできるようサポートします。

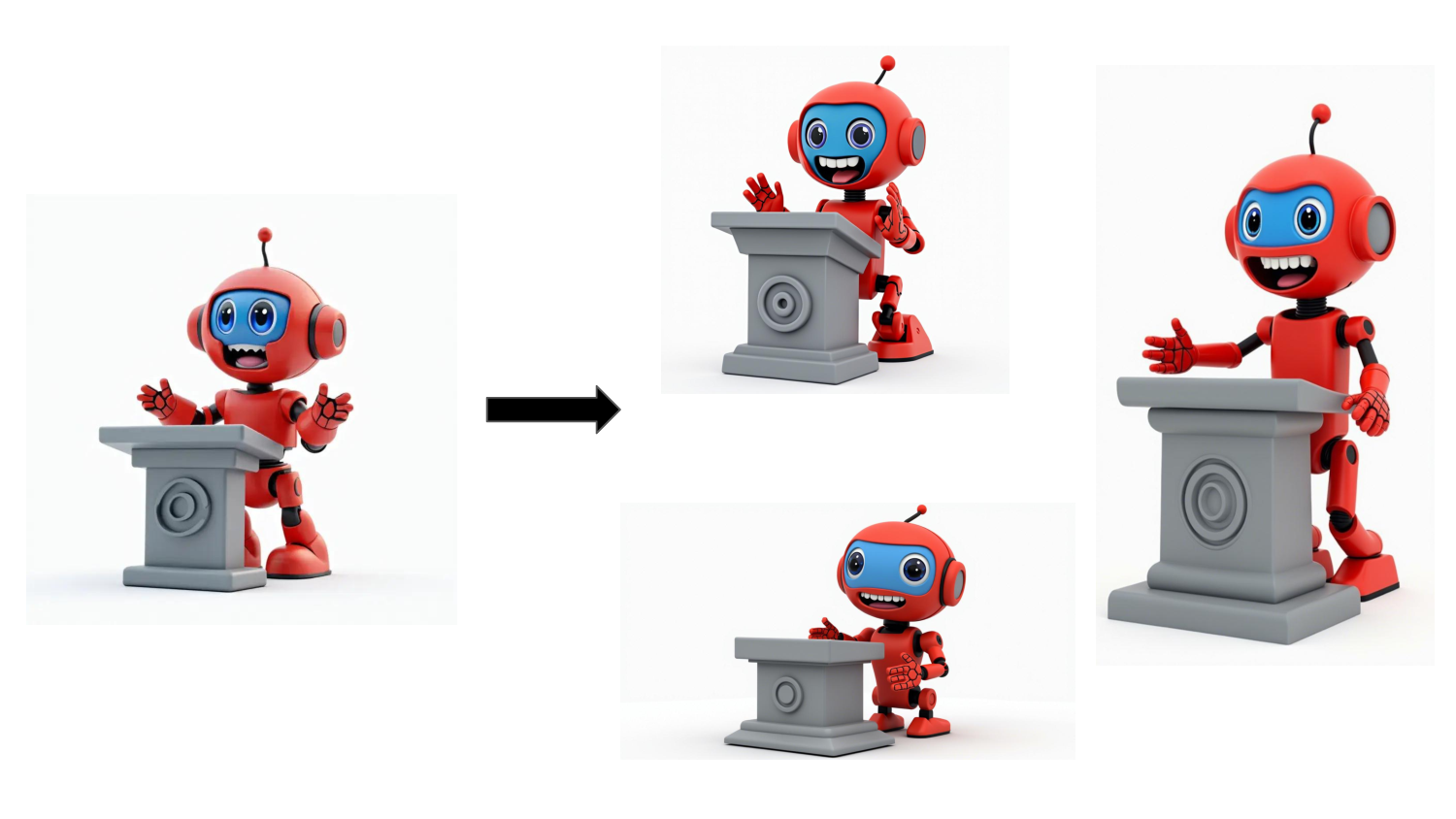

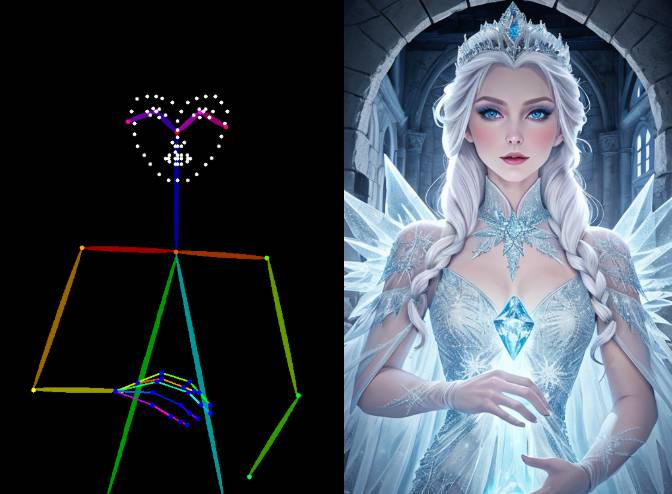

ComfyUI OpenPose ControlNetの詳細なガイド。インストール、ワークフローの使用方法、パラメータ調整など、ステップバイステップのチュートリアルを提供します

ComfyUIで複数のControlNetを組み合わせる方法、複数のControlNet間でApply ControlNetノードを連結することで、より正確な制御と生成効果を実現します。

ComfyUIでテンセントのHunyuanVideoモデルを使用して画像から動画を生成する完全なチュートリアル。環境設定、モデルのインストール、ワークフローの使用方法を詳しく説明します

ComfyUIでFLUX.1 Kontextバージョンを画像編集でマスター:ネイティブワークフロー設定、GGUF/FP8モデルバージョン、APIノード使用、マルチラウンド編集、キャラクター一貫性、プロンプト最適化戦略 - 基本から高度な応用まで

Qwen-Image-Layered は、Alibaba の Qwen チームが開発した画像レイヤー編集モデルで、画像を複数の RGBA レイヤーに分解し、各レイヤーを他のコンテンツに影響を与えずに独立して編集できます。

ComfyUIでLBM(Latent Bridge Matching)技術を使用して高速画像リライティングを実現し、背景環境に基づいて前景オブジェクトの照明効果を自動調整する方法を学びます

このチュートリアルでは、ComfyUIでWan2.1モデルを使用する方法を詳しく説明します。インストール設定、ワークフロー使用、パラメータ調整などの内容を含み、テキストから動画、画像から動画、動画から動画への変換などをカバーしています。

このチュートリアルは、ComfyUIでWan Fun Controlモデルを使用する方法について、完全なモデルのインストール、ワークフローの使用などを含む詳細な紹介を提供します。

最も包括的なWan2.2ビデオ ComfyUI チュートリアル:公式ネイティブ版、Kijai WanVideoWrapper、GGUF量子化版、Lightx2v高速生成など複数バージョンのワークフローを含む

最も包括的なWan2.2 Fun Controlビデオ ComfyUI チュートリアル:公式ネイティブ版、Kijai WanVideoWrapper、GGUF量子化版など複数のビデオ制御生成ワークフローを含む

ComfyUI エキスパートチュートリアル

ComfyUIのエキスパート技術:高度なカスタマイズと最適化

ComfyUI ワークフロー

ComfyUIワークフローの例

ComfyUI オンラインリソース

Stable Diffusion AIモデルとComfyUIリソースディレクトリナビゲーション

This article compiles ControlNet models available for the Flux ecosystem, including various ControlNet models developed by XLabs-AI, InstantX, and Jasperai, covering multiple control methods such as edge detection, depth maps, and surface normals.

本記事では、UNETモデルとそのバリアントについて紹介し、一般的に使用されるStable Diffusion UNETモデルのリソースとさまざまなUNETアーキテクチャの簡単な説明を含みます。

ComfyUI 組み込みノード

ComfyUI公式の組み込みノードのドキュメント

CLIP Text Encode SDXL

ComfyUIのCLIP Text Encode SDXLノードについて学びます。このノードは、SDXLアーキテクチャに特化したCLIPモデルを使用してテキスト入力をエンコードし、画像生成や操作タスクに適した形式にテキスト記述を変換します。

ドキュメントを読むCLIP Text Encode SDXL Refiner(CLIPテキストエンコードSDXLリファイナー)

ComfyUIのCLIP Text Encode SDXL Refinerノードについて学びます。このノードは、CLIPモデルを使用してテキスト入力のエンコーディングを洗練し、美的スコアと寸法を組み込むことで生成タスクの条件付けを強化します。

ドキュメントを読むCLIP Text Encode Hunyuan DiT

ComfyUIのCLIPTextEncodeHunyuanDiTノードの詳細なドキュメント。入出力タイプ、メソッド、BERTとmT5-XLの紹介、使用方法とヒントを含みます。

ドキュメントを読むConditioning Set Timestep Range

ComfyUIのConditioning Set Timestep Rangeノードについて学びます。このノードは、特定のタイムステップ範囲を設定することで、条件付けの時間的側面を調整し、よりターゲットを絞った効率的な生成を可能にします。

ドキュメントを読むConditioning Zero Out(条件ゼロアウト)

ComfyUIのConditioning Zero Outノードについて学びます。このノードは、コンディショニングデータ構造内の特定の要素をゼロにし、後続の処理ステップでの影響を効果的に中和します。

ドキュメントを読むCLIPTextEncodeFluxノードの説明 (CLIPTextEncodeFlux Node)

ComfyUIにおけるCLIPTextEncodeFluxノードの機能を発見し、高度なテキストエンコーディングと条件付き画像生成について学びます。

ドキュメントを読むFluxGuidance - ComfyUIノード機能説明

ComfyUIにおけるFluxGuidanceノードについて学び、テキストプロンプトが画像生成に与える影響を制御します。

ドキュメントを読むCLIP Loader(CLIPローダー)

ComfyUIのCLIP Loaderノードについて学びます。このノードは、CLIPモデルをロードするために設計されており、stable diffusionやstable cascadeなどの異なるタイプをサポートしています。CLIPモデルのロードと設定の複雑さを抽象化し、特定の設定でこれらのモデルにアクセスするための効率的な方法を提供します。

ドキュメントを読むLoad Checkpoint With Config (DEPRECATED)(設定付きチェックポイントのロード(非推奨))

ComfyUIのLoad Checkpoint With Config (DEPRECATED)ノードについて学びます。このノードは、モデルのチェックポイントとその設定をロードするために設計されています。さまざまなアプリケーションで使用するためのモデルチェックポイントのロードと設定の複雑さを抽象化し、特定の設定でこれらのモデルにアクセスするための効率的な方法を提供します。

ドキュメントを読むDiffusers Loader(ディフューザーズローダー)

ComfyUIのDiffusers Loaderノードについて学びます。このノードは、diffusersライブラリからモデルをロードするために設計されており、提供されたモデルパスに基づいてUNet、CLIP、およびVAEモデルのロードを特に扱います。これにより、これらのモデルをComfyUIフレームワークに統合し、テキストから画像生成、画像操作などの高度な機能を可能にします。

ドキュメントを読むDual CLIP Loader - その動作と使用方法

ComfyUIのDual CLIP Loaderノードについて学びます。このノードは、2つのCLIPモデルを同時にロードするために設計されており、両モデルの特徴を統合または比較する操作を容易にします。

ドキュメントを読むquadruple-clip-loader

ドキュメントを読むUNET Loader Guide | Load Diffusion Model - ドキュメント & 例

ComfyUIのUNET Loaderノードについて学びます。このノードは、U-Netモデルを名前でロードするために設計されており、システム内で事前訓練されたU-Netアーキテクチャの使用を容易にします。

ドキュメントを読むModel Sampling Continuous EDM(モデルサンプリング連続EDM)

ComfyUIのModel Sampling Continuous EDMノードについて学びます。このノードは、連続EDM(エネルギーベースの拡散モデル)サンプリング技術を統合することで、モデルのサンプリング能力を強化します。これにより、モデルのサンプリングプロセス内でノイズレベルを動的に調整でき、生成品質と多様性をより精密に制御できます。

ドキュメントを読むModel Sampling Discrete(モデルサンプリングディスクリート)

ComfyUIのModel Sampling Discreteノードについて学びます。このノードは、モデルのサンプリング動作を離散サンプリング戦略を適用することで修正します。epsilon、v_prediction、lcm、x0などの異なるサンプリング方法を選択でき、オプションでゼロショットノイズ比(zsnr)設定に基づいてモデルのノイズ削減戦略を調整します。

ドキュメントを読むRescale CFG(リスケールCFG)

ComfyUIのRescale CFGノードについて学びます。このノードは、指定された乗数に基づいてモデルの出力の条件付けおよび非条件付けスケールを調整し、よりバランスの取れた制御された生成プロセスを目指します。モデルの出力をリスケールすることで、条件付きおよび非条件付き成分の影響を修正し、モデルの性能や出力品質を向上させる可能性があります。

ドキュメントを読むCheckpoint Save(チェックポイントセーブ)

ComfyUIのCheckpoint Saveノードについて学びます。このノードは、モデル、CLIP、VAEなどのさまざまなモデルコンポーネントの状態をチェックポイントファイルに保存するために設計されています。この機能は、モデルのトレーニング進捗や設定を後で使用したり共有したりするために保存するのに重要です。

ドキュメントを読むCLIPMerge Simple

ComfyUIのCLIPMerge Simpleノードについて学びます。このノードは、指定された比率に基づいて2つのCLIPモデルを統合し、それらの特性を効果的にブレンドします。位置IDやロジットスケールなどの特定のコンポーネントを除外し、一方のモデルからもう一方のモデルにパッチを選択的に適用することで、両方のソースモデルの特徴を組み合わせたハイブリッドモデルを作成します。

ドキュメントを読むCLIP Save(CLIPセーブ)

ComfyUIのCLIPSaveノードについて学びます。このノードは、プロンプトや追加のPNGメタデータなどの情報と共にCLIPモデルを保存するために設計されています。モデルの状態をシリアライズして保存する機能を備えており、モデルの設定や関連するクリエイティブプロンプトの保存と共有を容易にします。

ドキュメントを読むModel Merge Add

ComfyUIのModelMergeAddノードについて学びましょう。このノードは、あるモデルから別のモデルに重要なパッチを追加することで、2つのモデルを統合するように設計されています。このプロセスは、最初のモデルをクローンし、次に2番目のモデルからパッチを適用することで、両方のモデルの特徴や動作を組み合わせることができます。

ドキュメントを読むModel Merge Blocks(モデルマージブロック)

ComfyUIのModelMergeBlocksノードについて学びましょう。このノードは、異なるモデルの部分に対してカスタマイズ可能なブレンド比率を設定し、2つのモデルを統合するために設計されています。指定されたパラメータに基づいて、2つのソースモデルのコンポーネントを選択的にマージすることで、ハイブリッドモデルの作成を容易にします。

ドキュメントを読むModel Merge Simple

ComfyUIのModelMergeSimpleノードについて学びます。このノードは、指定された比率に基づいて2つのモデルのパラメータをブレンドすることで、モデルをマージするために設計されています。このノードは、両方の入力モデルの強みや特性を組み合わせたハイブリッドモデルの作成を容易にします。

ドキュメントを読むModel Merge Subtract(モデルマージサブトラクト)

ComfyUIのModelMergeSubtractノードについて学びましょう。このノードは、高度なモデルマージ操作のために設計されており、指定された乗数に基づいてあるモデルのパラメータを別のモデルから減算します。これにより、あるモデルのパラメータが別のモデルに与える影響を調整することで、モデルの動作をカスタマイズし、新しいハイブリッドモデルの作成を可能にします。

ドキュメントを読むVAE Save

ComfyUIのVAESaveノードについて学びます。このノードは、プロンプトや追加のPNG情報を含むVAEモデルとそのメタデータを指定された出力ディレクトリに保存するために設計されています。モデルの状態と関連情報をファイルにシリアライズする機能をカプセル化し、訓練済みモデルの保存と共有を容易にします。

ドキュメントを読むStable Zero 123 Conditioning(ステーブルゼロ123条件付け)

ComfyUIのStableZero123_Conditioningノードについて学びます。このノードは、StableZero123モデルに特化した条件付け情報を処理するために設計されています。これらのモデルに適合し、最適化された特定の形式で入力を準備することに重点を置いています。

ドキュメントを読むStable Zero 123 Conditioning Batched(ステーブルゼロ123条件付けバッチ処理)

ComfyUIのStableZero123_Conditioning_Batchedノードについて学びます。このノードは、StableZero123モデルに特化したバッチ処理で条件付け情報を処理するために設計されています。複数の条件付けデータセットを同時に効率的に処理し、バッチ処理が重要なシナリオでのワークフローを最適化します。

ドキュメントを読むCLIP Set Last Layer(CLIP設定停止層)

ComfyUIのCLIPSetLastLayerノードについて学びます。このノードは、特定の層を最後に実行するように設定することで、CLIPモデルの動作を変更するために設計されています。これにより、CLIPモデル内の処理の深さをカスタマイズでき、処理される情報量を制限することでモデルの出力に影響を与える可能性があります。

ドキュメントを読むCLIP Text Encode (プロンプト)

ComfyUIのCLIPTextEncodeノードについて学びます。このノードは、CLIPモデルを使用してテキスト入力をエンコードし、生成タスクでのコンディショニングに利用できる形に変換するために設計されています。テキストのトークン化とエンコードの複雑さを抽象化し、テキストベースのコンディショニングベクトルを生成するための簡潔なインターフェースを提供します。

ドキュメントを読むCLIP Vision Encode(CLIPビジョンエンコード)

ComfyUIのCLIPVisionEncodeノードについて学びます。このノードは、CLIPビジョンモデルを使用して画像をエンコードし、視覚入力をさらなる処理や分析に適した形式に変換するために設計されています。画像エンコードの複雑さを抽象化し、画像をエンコードされた表現に変換するための簡潔なインターフェースを提供します。

ドキュメントを読むConditioning Average(条件平均)

ComfyUIのConditioningAverageノードについて学びます。このノードは、2つのコンディショニングデータセットをブレンドし、指定された強度に基づいて加重平均を適用するように設計されています。このプロセスにより、コンディショニングの影響を動的に調整し、生成されたコンテンツや特徴の微調整を可能にします。

ドキュメントを読むConditioning (Combine)(条件合成)

ComfyUIのConditioning(Combine)ノードについて学びます。このノードは、2つのコンディショニングデータセットを統合し、その情報を効果的に結合するために設計されています。コンディショニング入力を統合するための簡潔なインターフェースを提供し、生成されたコンテンツや特徴の動的な調整を可能にします。

ドキュメントを読むConditioning (Concat)(条件結合)

ComfyUIのConditioning(Concat)ノードについて学びます。このノードは、コンディショニングベクトルを連結するために設計されており、'conditioning_from'ベクトルを'conditioning_to'ベクトルに効果的に統合します。コンディショニング入力を統合するための簡潔なインターフェースを提供し、生成されたコンテンツや特徴の動的な調整を可能にします。

ドキュメントを読むConditioning (Set Area)|条件設定(エリア指定)

ComfyUIのConditioning(SetArea)ノードについて学びます。このノードは、条件設定コンテキスト内の特定のエリアを設定することで、条件情報を修正するために設計されています。指定された寸法と強度に基づいて、条件要素の精密な空間操作を可能にし、ターゲットを絞った調整と強化を実現します。

ドキュメントを読むConditioning (Set Area with Percentage)(条件エリアを割合で設定)

ComfyUIのConditioning(SetAreaWithPercentage)ノードについて学びます。このノードは、条件要素の影響範囲を割合値に基づいて調整するために設計されています。画像全体のサイズに対する割合としてエリアの寸法と位置を指定でき、条件効果の強度を調整するためのパラメータも備えています。

ドキュメントを読むConditioning (Set Area Strength) - コンディショニング(エリア強度設定)

ComfyUIのConditioning(SetAreaStrength)ノードについて学びます。このノードは、指定されたエリア内のコンディショニング要素の強度を調整するために設計されています。エリアの寸法と位置を画像全体のサイズのパーセンテージとして指定し、コンディショニング効果の強度を調整するための強度パラメータを提供します。

ドキュメントを読むConditioning (Set Mask)|条件設定(マスク適用)

ComfyUIのConditioning(SetMask)ノードについて学びます。このノードは、特定のエリアに指定された強度のマスクを適用することで、コンディショニング情報を修正するために設計されています。これにより、コンディショニング内でのターゲットを絞った調整が可能となり、生成プロセスをより精密に制御できます。

ドキュメントを読むApply ControlNet | コントロールネットの適用

ComfyUIのApplyControlNetノードについて学びましょう。このノードは、画像とコントロールネットモデルに基づいてコンディショニングデータにコントロールネット変換を適用するように設計されています。生成されたコンテンツに対するコントロールネットの影響を微調整し、条件のより正確で多様な修正を可能にします。

ドキュメントを読むApply ControlNet (Advanced)|コントロールネット適用(高度)

ComfyUIのApplyControlNet(Advanced)ノードについて学びます。このノードは、画像とコントロールネットモデルに基づいて、条件データに高度なコントロールネット変換を適用するために設計されています。生成されたコンテンツに対するコントロールネットの影響を微調整し、条件のより正確で多様な修正を可能にします。

ドキュメントを読むGLIGEN Text Box Apply(GLIGENテキストボックス適用)

ComfyUIのGLIGENTextBoxApplyノードについて学びます。このノードは、テキストボックスのパラメータを適用し、CLIPモデルを使用してエンコードすることにより、生成モデルの入力にテキストベースのコンディショニングを統合するように設計されています。このプロセスは、空間的およびテキスト情報でコンディショニングを豊かにし、より正確でコンテキストに基づいた生成を促進します。

ドキュメントを読むInpaint Model Conditioning(内補モデル条件付け)

ComfyUIのInpaintModelConditioningノードについて学びます。このノードは、インペイントモデルの条件付けプロセスを容易にするために設計されており、さまざまな条件付け入力を統合および操作して、インペイント出力を調整することができます。特定のモデルチェックポイントのロードやスタイルまたはコントロールネットモデルの適用、条件付け要素のエンコードと結合など、幅広い機能を備えており、インペイントタスクをカスタマイズするための包括的なツールとして機能します。

ドキュメントを読むApply Style Model(スタイルモデル適用)

ComfyUIのStyleModelApplyノードについて学びます。このノードは、CLIPビジョンモデルの出力に基づいてスタイルモデルを適用し、与えられたコンディショニングのスタイルを強化または変更するように設計されています。スタイルモデルのコンディショニングを既存のコンディショニングに統合し、生成プロセスでスタイルをシームレスにブレンドすることができます。

ドキュメントを読むunCLIP Conditioning|unCLIP条件付け

ComfyUIのunCLIPConditioningノードについて学びます。このノードは、CLIPビジョン出力を条件付けプロセスに統合するために設計されており、指定された強度とノイズ増幅パラメータに基づいてこれらの出力の影響を調整します。視覚的なコンテキストで条件付けを豊かにし、生成プロセスを強化します。

ドキュメントを読むSD_4X Upscale Conditioning(SD_4Xアップスケールコンディショニング)

ComfyUIのSD_4XUpscale_Conditioningノードについて学びます。このノードは、4倍のアップスケールプロセスを通じて画像の解像度を向上させるために設計されており、出力を洗練するためにコンディショニング要素を組み込んでいます。拡散技術を活用して画像をアップスケールし、スケール比率とノイズ増強の調整を可能にして、プロセスを微調整します。

ドキュメントを読むSVD img2vid Conditioning(SVD画像から動画へのコンディショニング)

ComfyUIのSVD_img2vid_Conditioningノードについて学びます。このノードは、SVD_img2vidモデルを使用したビデオ生成タスクのためのコンディショニングデータを生成するように設計されています。初期画像、ビデオパラメータ、VAEモデルなどのさまざまな入力を受け取り、ビデオフレームの生成をガイドするためのコンディショニングデータを生成します。

ドキュメントを読むComfyUI WanFunControlToVideoノード

ComfyUIのWanFunControlToVideoノードについて学びます。このノードは、特にWan 2.1 Fun Controlモデルでのビデオ生成タスクのために条件データを生成するために使用されます。初期画像、ビデオパラメータ、VAEモデルなど、さまざまな入力を受け入れ、ビデオフレーム生成をガイドするために使用できる条件データを生成します。

ドキュメントを読むSave Animated PNG|アニメーションPNG保存

ComfyUIのSaveAnimatedPNGノードについて学びます。このノードは、フレームのシーケンスからアニメーションPNG画像を作成および保存するために設計されています。個々の画像フレームを統合して一貫したアニメーションを組み立て、フレームの持続時間、ループ、およびメタデータのカスタマイズを可能にします。

ドキュメントを読むSave Animated WEBP|アニメーションWEBP保存

ComfyUIのSaveAnimatedWEBPノードについて学びます。このノードは、画像のシーケンスをアニメーションWEBPファイルとして保存するために設計されています。個々のフレームを統合して一貫したアニメーションを作成し、指定されたメタデータを適用し、品質と圧縮設定に基づいて出力を最適化します。

ドキュメントを読むImage From Batch|バッチからの画像抽出

ComfyUIのImageFromBatchノードについて学びます。このノードは、指定されたインデックスと長さに基づいて、バッチから特定の画像セグメントを抽出するために設計されています。バッチ化された画像に対してより細かい制御を可能にし、大きなバッチ内の個々またはサブセットの画像に対する操作を実現します。

ドキュメントを読むRebatch Images|画像の再バッチ化

ComfyUIのRebatchImagesノードについて学びます。このノードは、画像のバッチを新しいバッチ構成に再編成し、指定されたバッチサイズに調整するために設計されています。このプロセスは、バッチ操作における画像データの処理を管理し最適化するために不可欠であり、画像が効率的に処理されるように、希望するバッチサイズに従ってグループ化されることを保証します。

ドキュメントを読むRepeat Image Batch|画像バッチの繰り返し

ComfyUIのRepeatImageBatchノードについて学びます。このノードは、指定された回数だけ特定の画像を複製し、同一の画像バッチを作成するために設計されています。この機能は、バッチ処理やデータ拡張など、同じ画像の複数のインスタンスを必要とする操作に役立ちます。

ドキュメントを読むEmpty Image|空の画像

ComfyUIのEmptyImageノードについて学びます。このノードは、指定された寸法と色の空白画像を生成するために設計されています。均一な色の画像を作成でき、さまざまな画像処理タスクで背景やプレースホルダーとして使用できます。

ドキュメントを読むImage Batch|イメージバッチ

ComfyUIのImageBatchノードについて学びます。このノードは、2つの画像を1つのバッチに結合するために設計されています。画像の寸法が一致しない場合、2番目の画像を自動的にリスケールして最初の画像の寸法に合わせてから結合します。

ドキュメントを読むImage Composite Masked|イメージコンポジットマスクド

ComfyUIのImageCompositeMaskedノードについて学びます。このノードは、指定された座標でソース画像を宛先画像にオーバーレイするために設計されており、オプションでリサイズやマスキングを行うことができます。

ドキュメントを読むInvert Image|画像反転

ComfyUIのImageInvertノードについて学びます。このノードは、画像の色を反転させるために設計されており、各ピクセルの色を色相環上の補色に変換します。この操作は、ネガティブ画像の作成や色反転を必要とする視覚効果に役立ちます。

ドキュメントを読むImage Pad For Outpainting|アウトペインティング用画像パッド

ComfyUIのImagePadForOutpaintノードについて学びます。このノードは、アウトペインティングプロセスのために画像の周囲にパディングを追加して準備するために設計されています。画像の寸法を調整してアウトペインティングアルゴリズムとの互換性を確保し、元の境界を超えた拡張画像領域の生成を促進します。

ドキュメントを読むLoad Image|画像をロード

ComfyUIのLoadImageノードについて学びます。このノードは、指定されたパスから画像をロードし、前処理を行うために設計されています。複数フレームを持つ画像フォーマットを処理し、EXIFデータに基づく回転などの必要な変換を適用し、ピクセル値を正規化し、オプションでアルファチャンネルを持つ画像のマスクを生成します。このノードは、パイプライン内でのさらなる処理や分析のために画像を準備するために不可欠です。

ドキュメントを読むImage Blend|イメージブレンド

ComfyUIのImageBlendノードについて学びます。このノードは、指定されたブレンドモードとブレンドファクターに基づいて、2つの画像をブレンドするために設計されています。通常、乗算、スクリーン、オーバーレイ、ソフトライト、差分など、さまざまなブレンドモードをサポートしており、多様な画像操作と合成技術を可能にします。このノードは、2つの画像レイヤー間の視覚的な相互作用を調整することで、合成画像を作成するために不可欠です。

ドキュメントを読むImage Blur|イメージブラー

ComfyUIのImageBlurノードについて学びます。このノードは、画像にガウスぼかしを適用するために設計されており、エッジを柔らかくし、ディテールやノイズを低減します。パラメータを通じて、ぼかしの強度と広がりを制御できます。

ドキュメントを読むImage Quantize|イメージ量子化

ComfyUIのImageQuantizeノードについて学びます。このノードは、画像の色数を指定された数に減らすために設計されており、視覚的な品質を維持するためにディザリング技術を適用することもできます。このプロセスは、パレットベースの画像を作成したり、特定のアプリケーションのために色の複雑さを減らすのに役立ちます。

ドキュメントを読むImage Sharpen|イメージシャープ

ComfyUIのImageSharpenノードについて学びます。このノードは、画像のエッジとディテールを強調することで、画像の鮮明さを向上させるために設計されています。画像にシャープ化フィルターを適用し、その強度と半径を調整することで、より明確で鮮明な画像を作成します。

ドキュメントを読むCanny Node|キャニー ノード

ComfyUIのCannyノードについて学びます。このノードは、画像のエッジ検出を目的として設計されており、Cannyアルゴリズムを利用してエッジを識別し強調します。このプロセスでは、入力画像に一連のフィルターを適用し、高い勾配を持つ領域を検出します。これにより、エッジに対応する画像の構造的な詳細が強調されます。

ドキュメントを読むPreview Image|プレビュー画像

ComfyUIのPreviewImageノードについて学びます。このノードは、一時的なプレビュー画像を作成するために設計されています。各画像に対して一意の一時ファイル名を自動生成し、指定されたレベルに圧縮して一時ディレクトリに保存します。この機能は、処理中に元のファイルに影響を与えずに画像のプレビューを生成するのに特に便利です。

ドキュメントを読むSave Image|画像を保存 - ComfyUIでローカルに画像を保存

ComfyUIのSaveImageノードについて学びます。このノードは、画像をディスクに保存するために設計されています。テンソルから適切な画像フォーマットへの変換、オプションのメタデータの適用、指定された場所への画像の書き込みを、設定可能な圧縮レベルで行います。

ドキュメントを読むImage Crop|イメージクロップ

ComfyUIのImageCropノードについて学びます。このノードは、指定されたxおよびy座標から始まる特定の幅と高さに画像をクロップするために設計されています。この機能は、画像の特定の領域に焦点を当てたり、特定の要件に合わせて画像サイズを調整するために不可欠です。

ドキュメントを読むImage Scale|イメージスケール

ComfyUIのImageScaleノードについて学びます。このノードは、特定の寸法に画像をリサイズするために設計されており、さまざまなアップスケール方法を提供し、リサイズされた画像をクロップする機能も備えています。画像のアップスケールとクロップの複雑さを抽象化し、ユーザー定義のパラメータに基づいて画像の寸法を変更するための簡単なインターフェースを提供します。

ドキュメントを読むImage Scale By Node|イメージスケールバイノード

ComfyUIのImageScaleByノードについて学びます。このノードは、指定されたスケールファクターを使用して、さまざまな補間方法で画像をアップスケールするために設計されています。柔軟に画像サイズを調整でき、さまざまなアップスケールのニーズに対応します。

ドキュメントを読むImage Scale To Total Pixels|イメージスケールトゥトータルピクセル

ComfyUIのImageScaleToTotalPixelsノードについて学びます。このノードは、アスペクト比を維持しながら、画像を指定された総ピクセル数にリサイズするために設計されています。目的のピクセル数を達成するために、さまざまなアップスケール方法を提供します。

ドキュメントを読むImage Upscale With Model|画像をモデルで拡大

ComfyUIのImageUpscaleWithModelノードについて学びます。このノードは、指定されたアップスケールモデルを使用して画像を拡大するために設計されています。画像を適切なデバイスに調整し、メモリを効率的に管理し、タイル状にアップスケールモデルを適用することで、メモリ不足のエラーを回避します。

ドキュメントを読むLatent Upscale

ComfyUIのLatentUpscaleノードについて学びます。このノードは画像の潜在表現を拡大するために設計されています。出力画像の寸法や拡大方法を調整することができ、潜在画像の解像度を柔軟に向上させることが可能です。

ドキュメントを読むEmpty Latent Image

ComfyUIのEmptyLatentImageノードについて学びます。このノードは、指定された寸法とバッチサイズで空の潜在空間表現を生成するように設計されています。このノードは、潜在空間での画像生成や操作の基礎となるステップを提供し、さらなる画像合成や修正プロセスの出発点となります。

ドキュメントを読むLatent Upscale By

ComfyUIのLatentUpscaleByノードについて学びます。このノードは、指定されたスケールファクターによって画像の潜在表現を拡大するように設計されています。このノードは、スケールファクターと拡大方法の調整を可能にし、潜在サンプルの解像度を向上させる柔軟性を提供します。

ドキュメントを読むLatent Composite

ComfyUIのLatentCompositeノードについて学びます。このノードは、2つの潜在表現を1つの出力にブレンドまたはマージするように設計されています。このプロセスは、入力された潜在の特性を制御された方法で組み合わせることによって、合成画像や特徴を作成するために不可欠です。

ドキュメントを読むVAE Decode

ComfyUIのVAEDecodeノードについて学びます。このノードは、指定されたVariational Autoencoder(VAE)を使用して潜在表現を画像にデコードするように設計されています。圧縮データ表現から画像を生成し、潜在空間エンコーディングからの画像再構築を促進します。

ドキュメントを読むVAE Encode

ComfyUIのVAEEncodeノードについて学びます。このノードは、指定されたVariational Autoencoder(VAE)を使用して画像を潜在空間表現にエンコードするように設計されています。エンコードプロセスの複雑さを抽象化し、画像を潜在表現に変換する簡単な方法を提供します。

ドキュメントを読むLatent Composite Masked

ComfyUIのLatentCompositeMaskedノードについて学びます。このノードは、指定された座標で2つの潜在表現を合成するように設計されており、オプションでマスクを使用してより制御された合成を行うことができます。このノードを使用すると、1つの画像の一部を別の画像に重ね合わせることで、複雑な潜在画像を作成でき、ソース画像を完璧にフィットさせるためにリサイズすることも可能です。

ドキュメントを読むLatent Add|Latent相加

ComfyUIのLatentAddノードについて学びます。このノードは、2つの潜在表現の加算を目的として設計されています。これにより、これらの表現にエンコードされた特徴や特性を要素ごとに加算することで組み合わせることができます。

ドキュメントを読むLatent Batch Seed Behavior|潜在バッチシードの挙動

ComfyUIのLatentBatchSeedBehaviorノードについて学びます。このノードは、潜在サンプルのバッチのシード挙動を変更するために設計されています。バッチ全体のシードをランダム化または固定することができ、生成プロセスにおいて、生成された出力の変動性を導入するか、一貫性を維持するかに影響を与えます。

ドキュメントを読むLatent Interpolate|潜在インターポレート

ComfyUIのLatentInterpolateノードについて学びます。このノードは、指定された比率に基づいて2つの潜在サンプルセット間で補間を行い、両方のセットの特徴をブレンドして新しい中間の潜在サンプルセットを生成するように設計されています。

ドキュメントを読むLatent Multiply|潜在乗算

ComfyUIのLatentMultiplyノードについて学びます。このノードは、指定された乗数によってサンプルの潜在表現をスケーリングするように設計されています。これにより、生成されたコンテンツの微調整や、特定の潜在方向内でのバリエーションの探索が可能になります。

ドキュメントを読むLatent Subtract|潜在減算

ComfyUIのLatentSubtractノードについて学びます。このノードは、一つの潜在表現から別の潜在表現を減算するために設計されています。この操作により、ある潜在空間に表現された特徴や属性を別の潜在空間から効果的に除去することで、生成モデルの出力の特性を操作または修正することができます。

ドキュメントを読むLatent Batch|潜在バッチ

ComfyUIのLatentBatchノードについて学びます。このノードは、2つの潜在サンプルセットを1つのバッチに統合するように設計されています。統合前に、必要に応じて一方のセットのサイズを他方に合わせて調整することができます。この操作により、異なる潜在表現を組み合わせて、さらなる処理や生成タスクを行うことが可能になります。

ドキュメントを読むLatent From Batch|バッチからの潜在抽出

ComfyUIのLatentFromBatchノードについて学びます。このノードは、指定されたバッチインデックスと長さに基づいて、与えられたバッチから特定の潜在サンプルのサブセットを抽出するように設計されています。これにより、潜在サンプルの選択的な処理が可能になり、効率やターゲットを絞った操作のためにバッチの小さなセグメントでの操作が容易になります。

ドキュメントを読むRebatch Latents|潜在バッチ再構成

ComfyUIのRebatchLatentsノードについて学びます。このノードは、指定されたバッチサイズに基づいて、潜在表現のバッチを新しいバッチ構成に再編成するように設計されています。潜在サンプルが適切にグループ化され、次元やサイズの変動を処理し、さらなる処理やモデル推論を容易にします。

ドキュメントを読むRepeat Latent Batch|潜在バッチの繰り返し

ComfyUIのRepeatLatentBatchノードについて学びます。このノードは、指定された回数だけ潜在表現のバッチを複製するように設計されています。ノイズマスクやバッチインデックスなどの追加データを含むことも可能です。この機能は、データ拡張や特定の生成タスクなど、同じ潜在データの複数のインスタンスを必要とする操作において重要です。

ドキュメントを読むSet Latent Noise Mask|潜在ノイズマスクの設定

ComfyUIのSetLatentNoiseMaskノードについて学びます。このノードは、潜在サンプルのセットにノイズマスクを適用するように設計されています。指定されたマスクを統合することで、入力サンプルのノイズ特性を変更します。

ドキュメントを読むVAE Encode (for Inpainting)|インペインティング用VAEエンコード

ComfyUIのVAEEncodeForInpaintノードについて学びます。このノードは、インペインティングタスクに適した潜在表現に画像をエンコードするために設計されており、VAEモデルによる最適なエンコードのために入力画像とマスクを調整する追加の前処理ステップを組み込んでいます。

ドキュメントを読むCrop Latent(クロップレイテント)

ComfyUIのLatentCropノードについて学びます。このノードは画像の潜在表現に対してクロップ操作を行うように設計されています。クロップの寸法と位置を指定することで、潜在空間のターゲットを絞った修正が可能です。

ドキュメントを読むFlip Latent(フリップレイテント)

ComfyUIのLatentFlipノードについて学びます。このノードは、潜在表現を垂直または水平にフリップすることで操作するように設計されています。この操作により、潜在空間の変換が可能となり、データ内の新しいバリエーションや視点を発見することができます。

ドキュメントを読むRotate Latent(ローテートレイテント)

ComfyUIのLatentRotateノードについて学びます。このノードは、指定された角度で画像の潜在表現を回転させるように設計されています。潜在空間を操作して回転効果を実現する複雑さを抽象化し、ユーザーが生成モデルの潜在空間で画像を簡単に変換できるようにします。

ドキュメントを読むEmpty Hunyuan Latent Video ノードチュートリアル

ComfyUIにおけるEmpty Hunyuan Latent Videoノードの機能、パラメータ設定、使用方法について説明します。このノードは、Tencentのhunyuanビデオモデルを使用してビデオ生成のための空の潜在ビデオキャンバスを作成します。

ドキュメントを読むチェックポイントローダー(シンプル)

ComfyUIのCheckpointLoaderSimpleノードについて学びます。このノードは、設定を指定することなくモデルのチェックポイントをロードするために設計されています。チェックポイント名のみを必要とすることで、設定の詳細に不慣れなユーザーにもアクセスしやすくなっています。

ドキュメントを読むCLIP Vision Loader(CLIPビジョンローダー)

ComfyUIのCLIPVisionLoaderノードについて学びます。このノードは、指定されたパスからCLIP Visionモデルをロードするために設計されています。CLIP Visionモデルの位置特定と初期化の複雑さを抽象化し、さらなる処理や推論タスクにすぐに利用できるようにします。

ドキュメントを読むControlNet Loader(コントロールネットローダー)

ComfyUIのControlNetLoaderノードについて学びます。このノードは指定されたパスからControlNetモデルをロードするために設計されています。ControlNetモデルの位置特定と初期化の複雑さを抽象化し、さらなる処理や推論タスクにすぐに利用できるようにします。

ドキュメントを読むDiff ControlNet Loader(ディフコントロールネットローダー)

ComfyUIのDiffControlNetLoaderノードについて学びます。このノードは、指定されたパスから差分制御ネットをロードするために設計されています。差分制御ネットの位置特定と初期化の複雑さを抽象化し、さらなる処理や推論タスクにすぐに利用できるようにします。

ドキュメントを読むGLIGEN Loader(GLIGENローダー)

ComfyUIのGLIGENLoaderノードについて学びます。このノードは、指定されたパスからGLIGENモデルをロードするために設計されています。GLIGENモデルの位置特定と初期化の複雑さを抽象化し、さらなる処理や推論タスクにすぐに利用できるようにします。

ドキュメントを読むHypernetwork Loader(ハイパーネットワークローダー)

ComfyUIのHypernetworkLoaderノードについて学びます。このノードは、指定されたパスからハイパーネットワークをロードするために設計されています。ハイパーネットワークの位置特定と初期化の複雑さを抽象化し、さらなる処理や推論タスクにすぐに利用できるようにします。

ドキュメントを読むLora Loader - ComfyUIノードドキュメント

このノードは、指定された強度とLoRAファイル名に基づいて、モデルとCLIPインスタンスにLoRA(低ランク適応)調整を動的にロードして適用するように設計されています。元のモデルの重みを直接変更することなく、微調整された調整を適用することで、事前学習済みモデルのカスタマイズを容易にします。

ドキュメントを読むLora Loader Model Only(Loraローダーモデルのみ)

ComfyUIのLoraLoaderModelOnlyノードについて学びます。このノードは、CLIPモデルを必要とせずにLoRAモデルをロードするために設計されており、LoRAパラメータに基づいて既存のモデルを強化または修正することに焦点を当てています。LoRAパラメータを通じてモデルの強度を動的に調整することができ、モデルの動作を細かく制御することが可能です。

ドキュメントを読むStyle Model Loader(スタイルモデルローダー)

ComfyUIのStyleModelLoaderノードについて学びます。このノードは、指定されたパスからスタイルモデルをロードするために設計されています。スタイルモデルの位置特定と初期化の複雑さを抽象化し、さらなる処理や推論タスクにすぐに利用できるようにします。

ドキュメントを読むunCLIP Checkpoint Loader(unCLIPチェックポイントローダー)

ComfyUIのunCLIPCheckpointLoaderノードについて学びます。このノードは、unCLIPモデルに特化したチェックポイントをロードするために設計されています。指定されたチェックポイントからモデル、CLIPビジョンモジュール、VAEを取得し、初期化するプロセスを簡素化し、さらなる操作や分析のためのセットアップを効率化します。

ドキュメントを読むアップスケールモデルローダー (Upscale Model Loader)

ComfyUIのUpscaleModelLoaderノードについて学びます。このノードは指定されたパスからアップスケールモデルをロードするために設計されています。アップスケールモデルの位置特定と初期化の複雑さを抽象化し、さらなる処理や推論タスクにすぐに利用できるようにします。

ドキュメントを読むVAE Loader(VAEローダー)

ComfyUIのVAELoaderノードについて学びます。このノードはVariational Autoencoder(VAE)モデルをロードするために設計されており、標準および近似VAEの両方に対応しています。'taesd'や'taesdxl'モデルの特別な処理を含む、名前によるVAEのロードをサポートし、VAEの特定の設定に基づいて動的に調整します。

ドキュメントを読むImage Only Checkpoint Loader (img2vid model)|イメージ専用チェックポイントローダー(img2vidモデル)

ComfyUIのImageOnlyCheckpointLoaderノードについて学びます。このノードは、ビデオ生成ワークフロー内で画像ベースのモデル専用のチェックポイントをロードするように設計されています。指定されたチェックポイントから必要なコンポーネントを効率的に取得し、モデルの画像関連の側面に焦点を当てて構成します。

ドキュメントを読むJoin Image with Alpha(画像とアルファの結合)

ドキュメントを読むPorter-Duff Image Composite | ポーター・ダフ画像合成

PorterDuffImageCompositeノードは、Porter-Duff合成オペレーターを使用して画像合成を行うように設計されています。さまざまなブレンドモードに従ってソース画像と宛先画像を組み合わせることができ、画像の透明度を操作し、創造的な方法で画像を重ね合わせることにより、複雑な視覚効果を作成できます。

ドキュメントを読むSplit Image with Alpha(アルファ付き画像の分割)

SplitImageWithAlphaノードは、画像の色成分とアルファ成分を分離するために設計されています。入力画像テンソルを処理し、RGBチャンネルを色成分として抽出し、アルファチャンネルを透明度成分として抽出します。これにより、これらの異なる画像要素を操作する必要がある操作を容易にします。

ドキュメントを読むCrop Mask(クロップマスク)

CropMaskノードは、指定されたマスクから特定の領域を切り取るために設計されています。ユーザーは座標と寸法を指定することで、関心領域を定義し、マスクの一部を効果的に抽出してさらなる処理や分析に利用できます。

ドキュメントを読むFeather Mask(フェザーマスク)

FeatherMaskノードは、指定されたマスクのエッジにフェザリング効果を適用するように設計されています。各エッジから指定された距離に基づいて不透明度を調整することで、マスクのエッジを滑らかに移行させます。これにより、より柔らかく、よりブレンドされたエッジ効果が生まれます。

ドキュメントを読むGrow Mask (成長マスク)

GrowMaskノードは、指定されたマスクのサイズを拡大または縮小し、オプションで角にテーパ効果を適用するように設計されています。この機能は、画像処理タスクでマスクの境界を動的に調整するために重要であり、関心領域をより柔軟かつ正確に制御することができます。

ドキュメントを読むImage Color To Mask(イメージカラーからマスクへ)

ImageColorToMaskノードは、画像内の指定された色をマスクに変換するために設計されています。画像とターゲットカラーを処理し、指定された色が強調されたマスクを生成します。これにより、色に基づくセグメンテーションやオブジェクトの分離などの操作が容易になります。

ドキュメントを読むImage To Mask(イメージからマスクへ)

ImageToMaskノードは、指定されたカラーチャンネルに基づいて画像をマスクに変換するために設計されています。これにより、画像の赤、緑、青、またはアルファチャンネルに対応するマスクレイヤーを抽出し、チャンネル特定のマスキングや処理を必要とする操作を容易にします。

ドキュメントを読むInvert Mask(反転マスク)

InvertMaskノードは、指定されたマスクの値を反転させ、マスクされた領域とマスクされていない領域を効果的に入れ替えます。この操作は、前景と背景の関心の焦点を切り替える必要がある画像処理タスクにおいて基本的なものです。

ドキュメントを読むLoad Image (as Mask) | 画像をマスクとして読み込む

LoadImageMaskノードは、指定されたパスから画像とその関連マスクを読み込み、さらなる画像操作や分析タスクとの互換性を確保するために処理します。マスクのアルファチャンネルの存在など、さまざまな画像フォーマットと条件に対応し、標準化されたフォーマットに変換して画像とマスクを下流処理のために準備します。

ドキュメントを読むMask Composite(マスク合成)

MaskCompositeノードは、加算、減算、論理演算などのさまざまな操作を通じて2つのマスク入力を組み合わせ、新しい修正されたマスクを生成するように設計されています。これは、マスクデータの操作を抽象的に処理し、複雑なマスキング効果を達成するための重要なコンポーネントとして、マスクベースの画像編集および処理ワークフローで機能します。

ドキュメントを読むMask To Image | マスクを画像に変換

MaskToImageノードは、マスクを画像形式に変換するために設計されています。この変換により、マスクを画像として視覚化し、さらなる処理が可能になります。これにより、マスクベースの操作と画像ベースのアプリケーションの間の橋渡しが可能になります。

ドキュメントを読むSolid Mask(ソリッドマスク)

SolidMaskノードは、指定された値で全体が均一なマスクを生成します。特定の寸法と強度のマスクを作成するように設計されており、さまざまな画像処理やマスキングタスクに役立ちます。

ドキュメントを読むSamplerCustom(サンプラーカスタム)

SamplerCustomノードは、さまざまなアプリケーションに対して柔軟でカスタマイズ可能なサンプリングメカニズムを提供するように設計されています。ユーザーは、特定のニーズに合わせた異なるサンプリング戦略を選択し、設定することができ、サンプリングプロセスの適応性と効率を向上させます。

ドキュメントを読むKSampler Select(Kサンプラーセレクト)

KSamplerSelectノードは、指定されたサンプラー名に基づいて特定のサンプラーを選択するように設計されています。サンプラー選択の複雑さを抽象化し、ユーザーがタスクに応じて異なるサンプリング戦略を簡単に切り替えることができます。

ドキュメントを読むサンプラー DPMPP_2M_SDE

SamplerDPMPP_2M_SDEノードは、DPMPP_2M_SDEモデル用のサンプラーを生成するために設計されています。指定されたソルバータイプ、ノイズレベル、計算デバイスの好みに基づいてサンプルを作成することができます。サンプラー設定の複雑さを抽象化し、カスタマイズされた設定でサンプルを生成するための簡潔なインターフェースを提供します。

ドキュメントを読むサンプラー DPMPP_SDE

SamplerDPMPP_SDEノードは、DPMPP_SDEモデル用のサンプラーを生成するために設計されています。指定されたソルバータイプ、ノイズレベル、計算デバイスの好みに基づいてサンプルを作成することができます。サンプラー設定の複雑さを抽象化し、カスタマイズされた設定でサンプルを生成するための簡潔なインターフェースを提供します。

ドキュメントを読むBasic Scheduler|基本スケジューラー

BasicSchedulerノードは、指定されたスケジューラー、モデル、およびデノイズパラメータに基づいて、拡散モデルのためのシグマ値のシーケンスを計算するように設計されています。デノイズファクターに基づいて総ステップ数を動的に調整し、拡散プロセスを微調整します。

ドキュメントを読むExponential Scheduler(指数スケジューラ)

ExponentialSchedulerノードは、拡散サンプリングプロセスのために指数スケジュールに従ったシグマ値のシーケンスを生成するように設計されています。拡散プロセスの各ステップで適用されるノイズレベルを制御するためのカスタマイズ可能なアプローチを提供し、サンプリングの挙動を微調整することができます。

ドキュメントを読むKarras Scheduler(カラススケジューラー)

KarrasSchedulerノードは、Karras et al. (2022)のノイズスケジュールに基づいてノイズレベル(シグマ)のシーケンスを生成するように設計されています。このスケジューラーは、生成モデルにおける拡散プロセスを制御するのに役立ち、生成プロセスの各ステップで適用されるノイズレベルを微調整することができます。

ドキュメントを読むPolyexponential Scheduler(多項指数スケジューラ)

PolyexponentialSchedulerノードは、多項指数ノイズスケジュールに基づいてノイズレベル(シグマ)のシーケンスを生成するように設計されています。このスケジュールは、シグマの対数における多項式関数であり、拡散プロセス全体を通じてノイズレベルの柔軟でカスタマイズ可能な進行を可能にします。

ドキュメントを読むSD Turbo Scheduler(SDターボスケジューラー)

SDTurboSchedulerノードは、指定されたノイズ除去レベルとステップ数に基づいて、画像サンプリングのためのシグマ値のシーケンスを生成するように設計されています。これは、特定のモデルのサンプリング機能を活用してこれらのシグマ値を生成し、画像生成中のノイズ除去プロセスを制御するために重要です。

ドキュメントを読むVP Scheduler|VPスケジューラー

VPSchedulerノードは、Variance Preserving (VP) スケジューリング手法に基づいてノイズレベル(シグマ)のシーケンスを生成するように設計されています。このシーケンスは、拡散モデルにおけるノイズ除去プロセスを導くために重要であり、画像や他のデータタイプの制御された生成を可能にします。

ドキュメントを読むFlip Sigmas(フリップシグマ)

FlipSigmasノードは、拡散モデルで使用されるシグマ値のシーケンスを逆順に並べ替え、最初の値がゼロの場合は非ゼロにするように設計されています。この操作は、ノイズレベルを逆順に適応させるために重要であり、データからノイズを徐々に減少させるモデルでの生成プロセスを促進します。

ドキュメントを読むSplit Sigmas(分割シグマ)

SplitSigmasノードは、指定されたステップに基づいてシグマ値のシーケンスを2つの部分に分割するように設計されています。この機能は、シグマシーケンスの初期部分と後続部分を異なる方法で処理する必要がある操作にとって重要であり、これらの値をより柔軟かつターゲットを絞って操作することを可能にします。

ドキュメントを読むKSampler|Kサンプラー

KSamplerノードは、さまざまなアプリケーションに対して基本的なサンプリングメカニズムを提供するように設計されています。ユーザーは、特定のニーズに合わせた異なるサンプリング戦略を選択し、設定することができ、サンプリングプロセスの適応性と効率を向上させます。

ドキュメントを読むKSampler (Advanced)|Kサンプラー(アドバンスト)

KSamplerAdvancedノードは、サンプリングプロセスを強化するために高度な設定と技術を提供するように設計されています。これは、モデルからサンプルを生成するためのより洗練されたオプションを提供し、基本的なKSampler機能を向上させることを目的としています。

ドキュメントを読むSampler(サンプラー)

Samplerノードは、さまざまなアプリケーションに対して基本的なサンプリングメカニズムを提供するように設計されています。ユーザーは、特定のニーズに合わせた異なるサンプリング戦略を選択し、設定することができ、サンプリングプロセスの適応性と効率を向上させます。

ドキュメントを読むVideo Linear CFG Guidance(ビデオ線形CFGガイダンス)

VideoLinearCFGGuidanceノードは、ビデオモデルに線形条件付けガイダンススケールを適用し、指定された範囲内で条件付きおよび非条件付きコンポーネントの影響を調整します。これにより、生成プロセスを動的に制御し、望ましい条件付けレベルに基づいてモデルの出力を微調整することが可能になります。

ドキュメントを読むNote (ノート)

Noteノードは、さまざまなアプリケーション向けに基本的なサンプリングメカニズムを提供するように設計されています。ユーザーが特定のニーズに合わせた異なるサンプリング戦略を選択および構成できるようにし、サンプリングプロセスの適応性と効率を向上させます。

ドキュメントを読むPrimitive プリミティブノード

プリミティブノードは接続された入力の種類を認識し、それに応じた入力データを提供します。このノードが異なる入力タイプに接続されると、異なる入力状態に変化します。複数の異なるノード間で統一されたパラメータを使用するために利用できます。例えば、複数のKsamplerで同じシードを使用することができます。

ドキュメントを読むReroute(リルート)

Rerouteノードは、さまざまなアプリケーションに基本的なサンプリングメカニズムを提供するように設計されています。ユーザーは、自分の特定のニーズに合わせた異なるサンプリング戦略を選択し、設定することができ、サンプリングプロセスの適応性と効率を向上させます。

ドキュメントを読むターミナルログ (マネージャー) Terminal Log (Manager)

ターミナルログ (マネージャー) ノードは、ComfyUIのインターフェース内でターミナルに表示される実行情報を主に表示するために使用されます。使用するには、`mode`を**logging**モードに設定する必要があります。これにより、画像生成タスク中に対応するログ情報を記録できます。`mode`が**stop**モードに設定されている場合、ログ情報は記録されません。ComfyUIをリモート接続やローカルエリアネットワーク接続を介してアクセスおよび使用する際、ターミナルログ (マネージャー) ノードは特に便利です。ComfyUIインターフェース内でCMDからのエラーメッセージを直接表示できるため、ComfyUIの動作状況を理解しやすくなります。

ドキュメントを読むよくある質問

ComfyUIに関する一般的な質問と回答

なぜウィジェット(widget)はComfyUIで入力(input)に変換できないのか

ComfyUIのフロントエンドバージョンの更新により、コンポーネントの入力は常に存在し、手動での変換はもはや必要ありません。

ComfyUI ワークフローをインポートした後、widget が消えて設定や調整ができない

ComfyUI と Automatic1111 WebUI の画像生成における違いについて詳しく説明し、ノイズ生成やプロンプトの重みの扱い方を含みます

ComfyUI Managerのセキュリティレベルエラー「このアクションは許可されていません」の完全ガイド

Git URLを介してComfyUIプラグインをインストールする際に「このアクションはこのセキュリティレベル構成では許可されていません」というエラーが発生する場合、これはComfyUI Managerのセキュリティポリシーが外部コードの実行を制限しているためです。このガイドでは、Windows/macOS/Linuxのすべてのプラットフォームに対応した解決策を提供します。

ComfyUI Fast Groups 代替案と使用ガイド

ComfyUIにおけるFast Groups Muterの代替案を探り、ワークフローでのノードグループ管理を改善するためのヒントを提供します。

ComfyUIでのフォントサイズ変更方法: ステップバイステップガイド

ComfyUIのさまざまなエリアでフォントサイズを調整するための詳細ガイド

ComfyUI 出力フォルダの場所を変更する方法

ComfyUIでデフォルトの出力フォルダの場所を変更するための包括的なガイド

ComfyUIの新メニューの有効化方法

ComfyUI v0.2.0以降での新しいメニューインターフェースの有効化に関するガイド

同じシードでもComfyUIとA1111で生成される画像が異なる理由

ComfyUIとAutomatic1111 WebUIの画像生成における違いについての詳細な説明。ノイズ生成とプロンプトの重み付け処理の違いを含む

ローカルネットワークからComfyUIにアクセスする方法

PortableバージョンとDesktopバージョンでのComfyUIサーバーのローカルネットワークアクセス設定方法