OpenMOSS 发布 MOVA - 开源音视频同步生成模型

2026/01/29

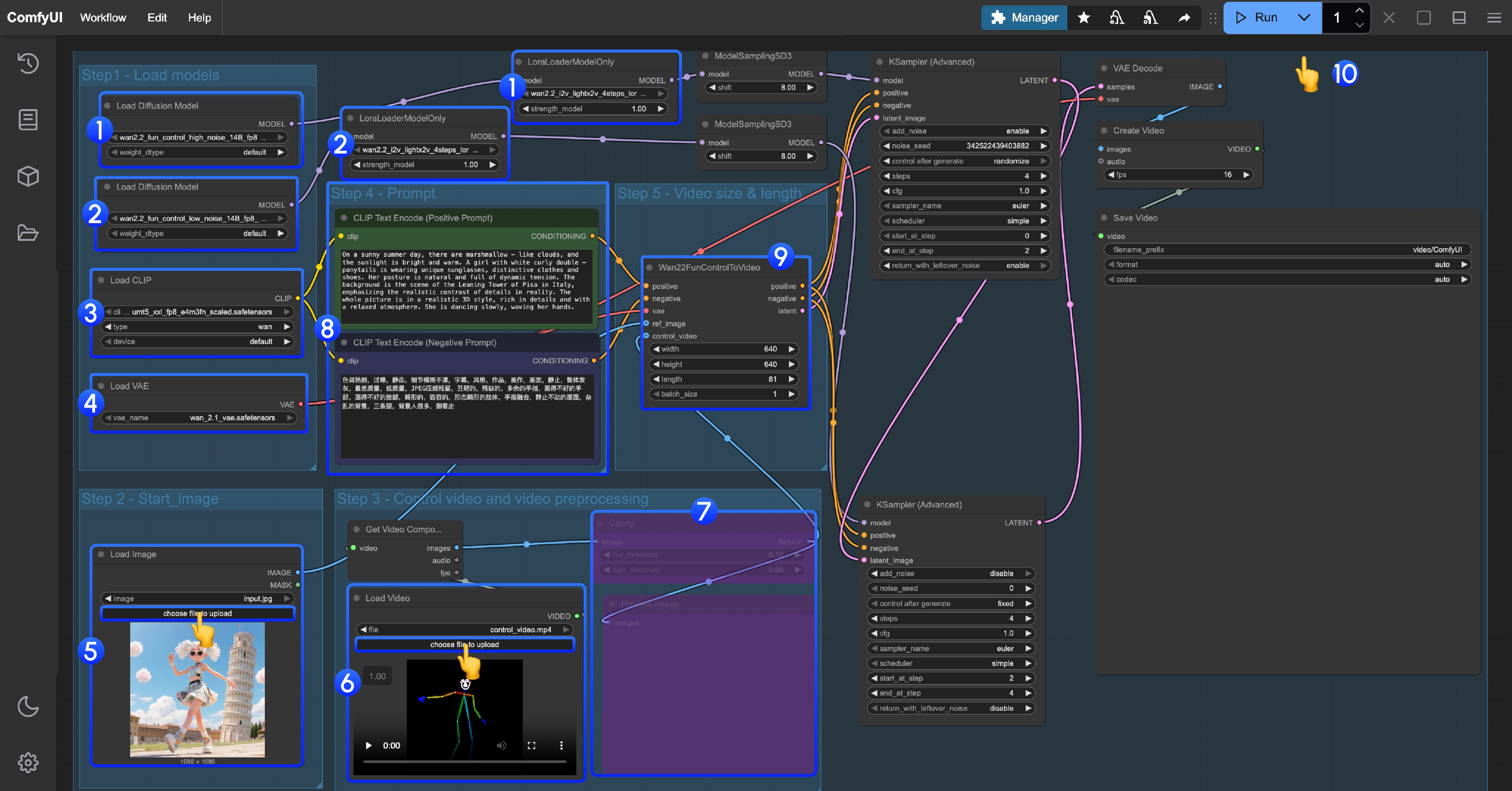

Wan2.2 Fun Control ComfyUI 工作流完整使用指南,官方+社区版本(Kijai, GGUF)工作流全攻略

本教程将全面介绍 Wan2.2 Fun Control 视频控制生成模型在 ComfyUI 中的各种实现方式和使用方法。Wan2.2 Fun Control 是阿里云推出的新一代视频生成与控制模型,通过引入创新性的控制代码(Control Codes)机制,结合深度学习和多模态条件输入,能够生成高质量且符合预设控制条件的视频。

本教程涵盖的版本和内容

已完成的版本:

- ✅ ComfyUI 官方原生版本 - 由 我再 ComfyOrg 官方文档中提供的完整工作流

- ✅ Wan2.2 Fun Control 14B 视频控制版本 - 高质量多模态控制视频生成

正在准备中的版本:

- 🔄 Kijai WanVideoWrapper 版本 - 社区开发的便捷包装器

- 🔄 GGUF 量化版本 - 适用于低配置设备的优化版本

模型技术特点

Wan2.2 Fun Control 基于 Wan2.2 架构,专门针对视频控制生成进行了优化,具备以下核心特性:

核心优势:

- 多模态控制:支持多种控制条件,包括 Canny(线稿)、Depth(深度)、OpenPose(人体姿势)、MLSD(几何边缘)等,同时支持使用轨迹控制

- 高质量视频生成:基于 Wan2.2 架构,输出影视级质量视频

- 多语言支持:支持中英文等多语言提示词输入

- 多分辨率支持:支持生成512×512、768×768、1024×1024等分辨率的视频,适配不同场景需求

开源协议说明

Wan2.2 Fun Control 系列模型基于 Apache2.0 开源协议,支持商业使用。Apache2.0 许可证允许您自由使用、修改和分发这些模型,包括商业用途,只需保留原始版权声明和许可证文本。

Wan2.2 Fun Control 开源模型版本概览

| 模型类型 | 模型名称 | 参数量 | 主要功能 | 模型仓库 |

|---|---|---|---|---|

| 视频控制 | Wan2.2-Fun-A14B-Control | 14B | 支持不同的控制条件,如Canny、Depth、Pose、MLSD等,同时支持使用轨迹控制 | 🤗 Wan2.2-Fun-A14B-Control |

相关代码仓库

- VideoX-Fun GitHub 仓库 - 官方提供的完整实现代码

- Wan2.2 Fun Control 官方文档 - 详细的模型说明和使用指南

Wan2.2 Fun Control ComfyUI 官方原生版本工作流使用指南

版本说明

ComfyUI 官方原生版本由 ComfyOrg 团队提供,使用重新打包的模型文件,确保与 ComfyUI 的最佳兼容性。该版本支持标准模式和 Lightx2v 4步 LoRA 加速模式。

性能对比测试

下面是使用 RTX4090D 24GB 显存 GPU 测试的结果 640*640 分辨率, 81 帧长度的用时对比:

| 模型类型 | 分辨率 | 显存占用 | 首次生成时长 | 第二次生成时长 |

|---|---|---|---|---|

| fp8_scaled | 640×640 | 83% | ≈ 524秒 | ≈ 520秒 |

| fp8_scaled + 4步LoRA加速 | 640×640 | 89% | ≈ 138秒 | ≈ 79秒 |

由于使用了4 步 LoRA 对于初次使用工作流的用户体验较好,但可能导致生成的视频动态会有损失,我们默认启用了使用了加速 LoRA 版本,如果你需要启用另一组的工作流,框选后使用 Ctrl+B 即可启用。

1. Wan2.2 Fun Control 视频控制生成 ComfyUI 工作流

工作流获取方式

下载下面的视频或者 JSON 文件并拖入 ComfyUI 中以加载对应的工作流

下载 JSON 格式工作流

请下载下面的图片及视频,我们将作为输入。

这里我们使用了经过预处理的视频, 可以直接用于控制视频生成

模型文件下载

下面的模型你可以在 Wan_2.2_ComfyUI_Repackaged 找到

Diffusion Model

- wan2.2_fun_control_high_noise_14B_fp8_scaled.safetensors

- wan2.2_fun_control_low_noise_14B_fp8_scaled.safetensors

Wan2.2-Lightning LoRA (可选,用于加速)

- wan2.2_i2v_lightx2v_4steps_lora_v1_high_noise.safetensors

- wan2.2_i2v_lightx2v_4steps_lora_v1_low_noise.safetensors

VAE

Text Encoder

ComfyUI/

├───📂 models/

│ ├───📂 diffusion_models/

│ │ ├─── wan2.2_fun_control_low_noise_14B_fp8_scaled.safetensors

│ │ └─── wan2.2_fun_control_high_noise_14B_fp8_scaled.safetensors

│ ├───📂 loras/

│ │ ├─── wan2.2_i2v_lightx2v_4steps_lora_v1_high_noise.safetensors

│ │ └─── wan2.2_i2v_lightx2v_4steps_lora_v1_low_noise.safetensors

│ ├───📂 text_encoders/

│ │ └─── umt5_xxl_fp8_e4m3fn_scaled.safetensors

│ └───📂 vae/

│ └── wan_2.1_vae.safetensors操作步骤详解

这个工作流是使用了 LoRA 的工作流,请确保对应的 Diffusion model 和 LoRA 是一致的, high noise 和 low noise 的模型和 LoRA 需要对应使用

- High noise 模型及 LoRA 加载

- 确保

Load Diffusion Model节点加载了wan2.2_fun_control_high_noise_14B_fp8_scaled.safetensors模型 - 确保

LoraLoaderModelOnly节点加载了wan2.2_i2v_lightx2v_4steps_lora_v1_high_noise.safetensors

- Low noise 模型及 LoRA 加载

- 确保

Load Diffusion Model节点加载了wan2.2_fun_control_low_noise_14B_fp8_scaled.safetensors模型 - 确保

LoraLoaderModelOnly节点加载了wan2.2_i2v_lightx2v_4steps_lora_v1_low_noise.safetensors

- 确保

Load CLIP节点加载了umt5_xxl_fp8_e4m3fn_scaled.safetensors模型 - 确保

Load VAE节点加载了wan_2.1_vae.safetensors模型 - 在

Load Image节点上传起始帧 - 在第二个

Load video节点控制视频的 pose 视频, 提供的视频已经经过预处理可以直接使用 - 由于我们提供的视频是预处理过的 pose 视频,所以对应的视频图像预处理节点需要禁用,你可以选中后使用 Ctrl + B` 来禁用

- 修改 Prompt 使用中英文都可以

- 在

Wan22FunControlToVideo修改对应视频的尺寸, 默认设置了 640*640 的分辨率来避免低显存用户使用这个工作流时过于耗时 - 点击

Run按钮,或者使用快捷键Ctrl(cmd) + Enter(回车)来执行视频生成

补充说明

由于在 ComfyUI 自带的节点中,预处理器节点只有 Canny 的预处理器,你可以使用使用类似 ComfyUI-comfyui_controlnet_aux 来实现其它类型的图像预处理

Wan2.2 Fun Control Kijai WanVideoWrapper ComfyUI 工作流

此部分内容正在准备中,预计将在近期更新。

这部分教程将介绍使用 Kijai/ComfyUI-WanVideoWrapper 的便捷方式。

相关模型仓库:https://huggingface.co/Kijai/WanVideo_comfy_fp8_scaled

Wan2.2 Fun Control GGUF 量化版 ComfyUI 工作流

此部分内容正在准备中,预计将在近期更新。

GGUF 版本适用于显存有限的用户,提供以下资源:

QuantStack/Wan2.2-Fun-A14B-Control-GGUF

相关自定义节点: City96/ComfyUI-GGUF