OpenMOSS 发布 MOVA - 开源音视频同步生成模型

2026/01/29

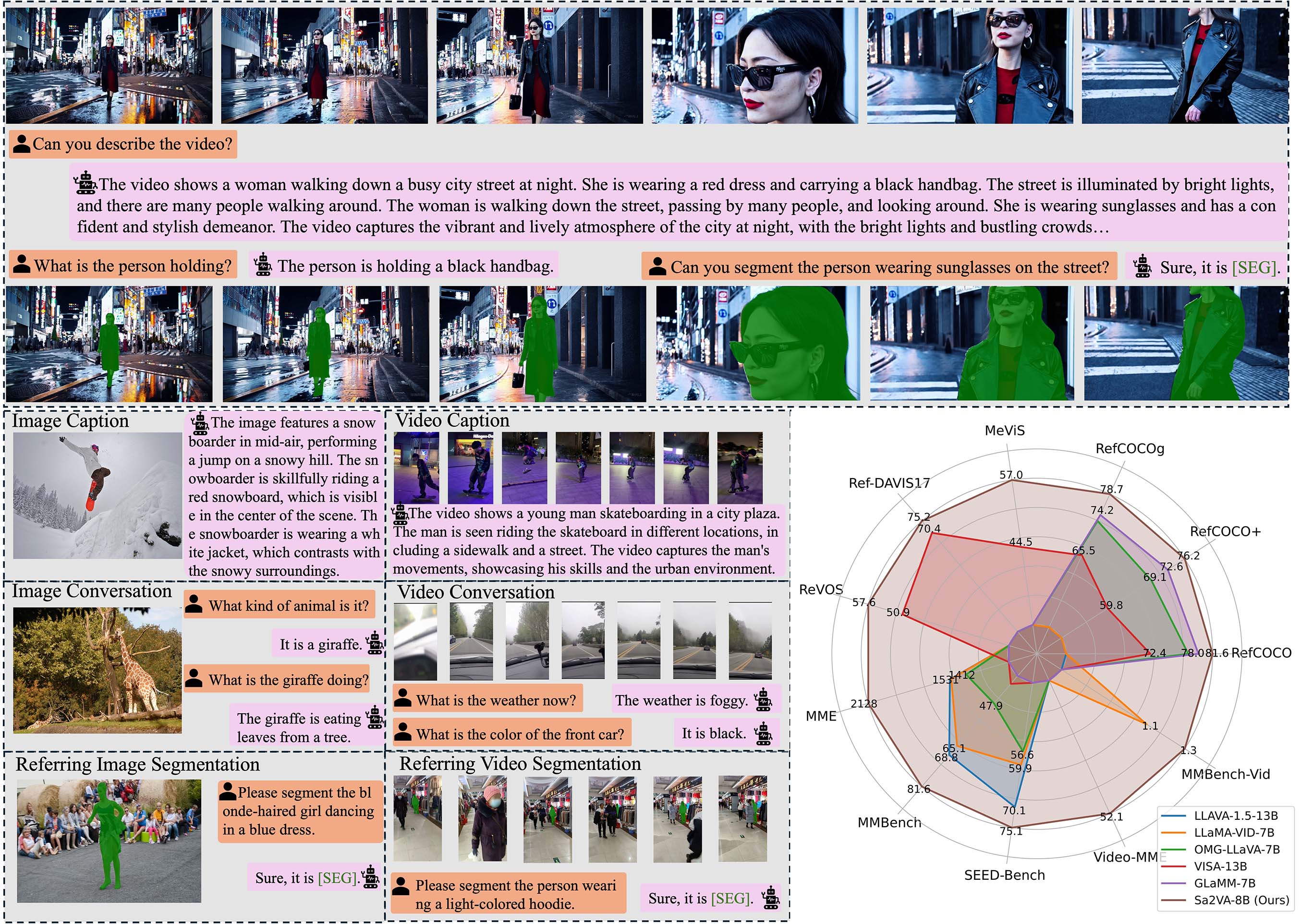

ByteDance发布Sa2VA:首个图像视频统一理解模型

ByteDance今日在Hugging Face平台发布了Sa2VA(SAM2 + LLaVA)多模态模型,这是首个能够同时处理图像和视频的密集分割理解模型。Sa2VA将Meta的SAM2分割技术与LLaVA视觉问答能力相结合,在保持与顶级多模态模型相当的问答性能的同时,新增了视觉提示理解和密集对象分割功能。

技术特点:多模态理解的新突破

Sa2VA的核心创新在于将两项先进技术有机融合:

1. 视觉分割能力

- 密集对象分割:能够精确识别并分割图像和视频中的多个对象

- 视觉提示理解:支持通过遮罩等视觉提示进行交互式分割

- 跨帧一致性:在视频处理中保持对象分割的时间连续性

2. 多模态问答

- 图像理解:提供详细的图像描述和分析

- 视频分析:理解视频内容的时间动态变化

- 交互式对话:支持基于视觉内容的多轮对话

模型系列:多规格满足不同需求

ByteDance基于Qwen2.5-VL和InternVL系列构建了完整的Sa2VA模型家族:

| 模型名称 | 基础模型 | 语言模型 | 参数规模 |

|---|---|---|---|

| Sa2VA-InternVL3-2B | InternVL3-2B | Qwen2.5-1.5B | 2B |

| Sa2VA-InternVL3-8B | InternVL3-8B | Qwen2.5-7B | 8B |

| Sa2VA-InternVL3-14B | InternVL3-14B | Qwen2.5-14B | 14B |

| Sa2VA-Qwen2_5-VL-3B | Qwen2.5-VL-3B | Qwen2.5-3B | 3B |

| Sa2VA-Qwen2_5-VL-7B | Qwen2.5-VL-7B | Qwen2.5-7B | 7B |

性能表现:多项基准测试领先

Sa2VA在多个标准测试中展现出优异性能:

视觉问答能力

- MME测试:Sa2VA-InternVL3-14B达到1746/724分

- MMBench:84.3分,接近专业视觉理解模型水平

分割任务表现

- RefCOCO系列:在指代表达分割任务中表现优异

- 视频分割:MeVIS和DAVIS基准测试中达到最佳性能

应用场景:广泛的实用价值

Sa2VA的统一架构为多个领域带来新的可能性:

1. 内容创作

- 视频编辑:自动识别和分割视频中的对象,简化后期制作流程

- 图像标注:为大规模图像数据集提供精确的对象分割和描述

2. 教育培训

- 互动教学:通过视觉提示和问答帮助学生理解复杂概念

- 内容分析:自动分析教学视频中的关键信息点

3. 安防监控

- 智能分析:实时分析监控视频中的人员和物体行为

- 异常检测:结合视觉理解和分割能力识别异常情况

4. 医疗影像

- 辅助诊断:分析医学影像并提供详细的区域描述

- 病灶定位:精确分割和标注感兴趣区域

开源资源与获取方式

Sa2VA采用开源发布策略,为研究者和开发者提供便利:

官方资源链接:

- 项目主页:GitHub Sa2VA

- 论文地址:arXiv:2501.04001

- 模型下载:Hugging Face Sa2VA系列

Sa2VA的发布标志着多模态AI向更加统一和实用的方向发展,其将视觉分割与语言理解深度融合的设计思路,为未来的AI应用开辟了新的可能性。