OpenMOSS lanza MOVA - modelo de generación sincronizada de video y audio de código abierto

29/01/2026

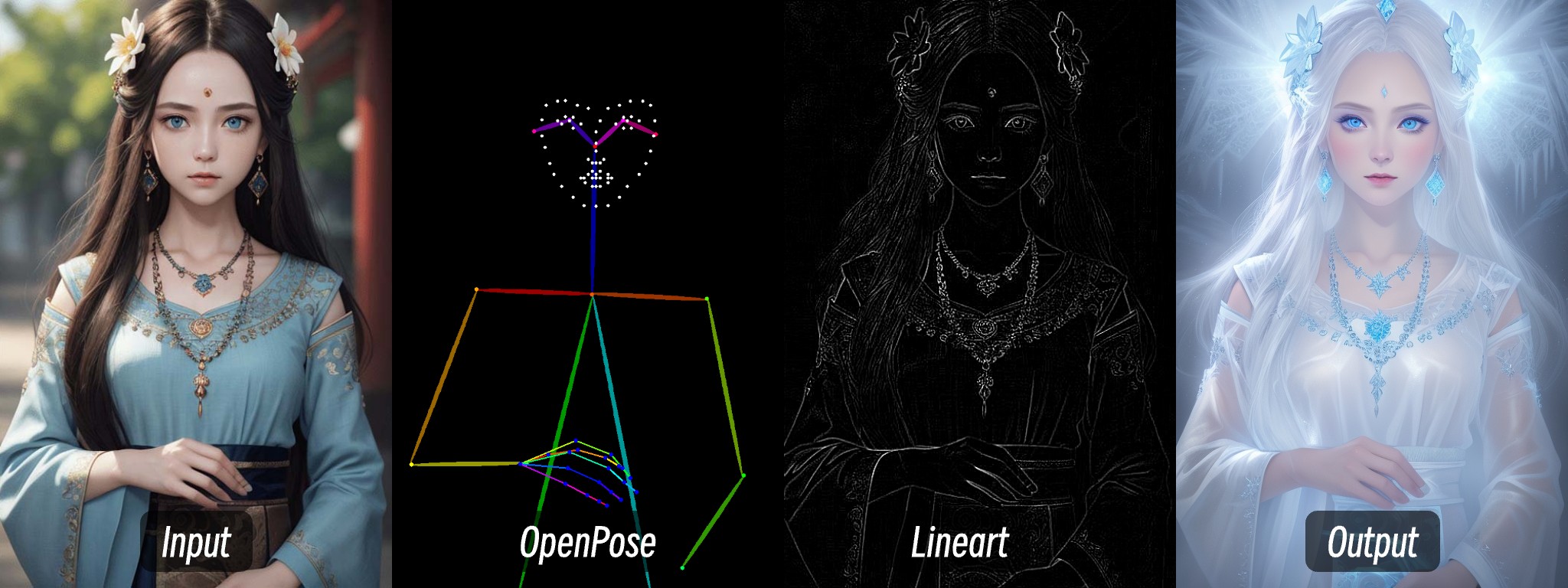

Tutorial sobre el uso de múltiples ControlNets en ComfyUI

En ControlNet, se pueden combinar múltiples ControlNets para lograr un control más preciso. Por ejemplo, al generar personajes, si hay un desalineamiento en las extremidades, se puede superponer la profundidad para asegurar la correcta relación frontal y trasera de las extremidades.

En ControlNet, se pueden combinar múltiples ControlNets para lograr un control más preciso. Por ejemplo, al generar personajes, si hay un desalineamiento en las extremidades, se puede superponer la profundidad para asegurar la correcta relación frontal y trasera de las extremidades.

En este artículo, utilizaré OpenPose y Lineart para lograr una transformación en el estilo visual.

- OpenPose se utiliza para controlar la postura del personaje.

- Lineart se utiliza para mantener la consistencia en la vestimenta y características faciales del personaje.

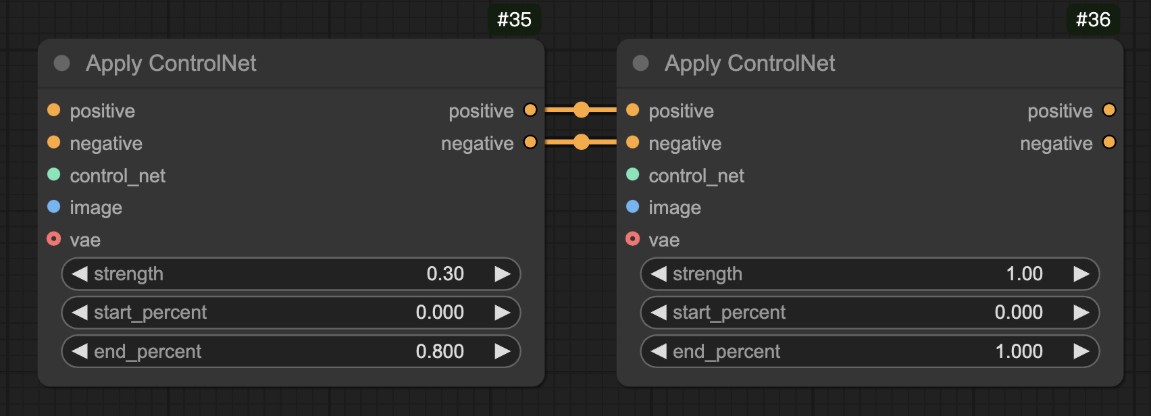

La clave es encadenar las condiciones de los nodos Apply ControlNet al usar múltiples ControlNets.

Para más información sobre el control de etapas de ControlNet, puedes consultar las Instrucciones de uso del nodo Apply ControlNet.

Para más información sobre el control de etapas de ControlNet, puedes consultar las Instrucciones de uso del nodo Apply ControlNet.

Pasos para usar múltiples ControlNets en ComfyUI

1. Instalar los plugins necesarios

Si has aprendido de otros tutoriales en ComfyUI Wiki, deberías haber instalado los plugins correspondientes, por lo que puedes omitir este paso.

Dado que ComfyUI Core no incluye un preprocesador de imágenes de profundidad correspondiente, necesitas descargar el plugin de preprocesador correspondiente por adelantado. Este tutorial requiere el uso del plugin ComfyUI ControlNet Auxiliary Preprocessors para generar mapas de profundidad.

Se recomienda utilizar ComfyUI Manager para la instalación. Puedes consultar el Tutorial de instalación de plugins de ComfyUI para obtener instrucciones detalladas sobre la instalación de plugins.

La última versión de ComfyUI Desktop ya tiene preinstalado el plugin ComfyUI Manager.

2. Descargar modelos

Primero, necesitas descargar los siguientes modelos:

| Tipo de modelo | Archivo del modelo | Enlace de descarga |

|---|---|---|

| Modelo base SD1.5 | dreamshaper_8.safetensors (opcional) | Civitai |

| Modelo ControlNet OpenPose | control_v11f1p_sd15_openpose.pth (requerido) | Hugging Face |

| Lineart | control_v11p_sd15_lineart.pth (requerido) | Hugging Face |

La versión SD1.5 del modelo puede usar los modelos en tu propia computadora; sin embargo, en este tutorial, estoy usando el modelo dreamshaper_8 como ejemplo.

Por favor, coloca los archivos del modelo según la siguiente estructura:

📁ComfyUI

├── 📁models

│ ├── 📁checkpoints

│ │ └── 📁SD1.5

│ │ └── dreamshaper_8.safetensors

│ ├── 📁controlnet

│ │ └── 📁SD1.5

│ │ └── control_v11f1p_sd15_openpose.pth

│ │ └── control_v11p_sd15_lineart.pth3. Archivo de flujo de trabajo e imagen de entrada

Descarga el siguiente archivo de flujo de trabajo y el archivo de imagen

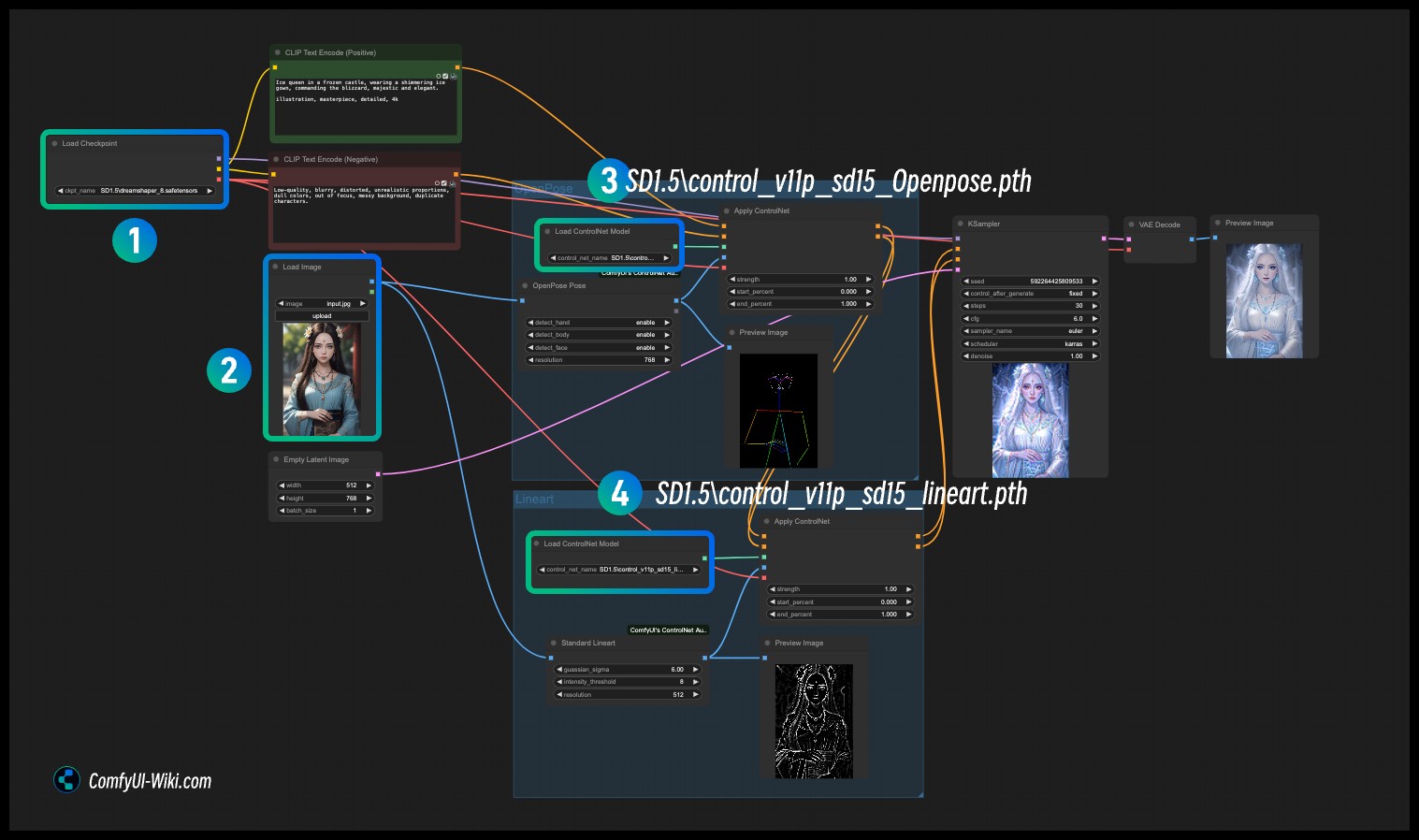

4. Importar flujo de trabajo en ComfyUI para cargar imágenes para generación

- Cargar el modelo Checkpoint SD1.5 correspondiente en el paso

1 - Cargar la imagen de entrada en el paso

2 - Cargar el modelo ControlNet OpenPose en el paso

3 - Cargar el modelo ControlNet Lineart en el paso

4 - Usar Queue o la tecla de acceso rápido

Ctrl+Enterpara ejecutar el flujo de trabajo y generar la imagen