Guide complète du flux de travail Wan2.1 Fun Control dans ComfyUI

Wan2.1-Fun-Control est la dernière capacité de contrôle vidéo lancée par l’équipe d’Alibaba, qui peut réaliser des capacités de contrôle vidéo telles que la profondeur, openpose et canny. Actuellement, ce modèle est divisé en deux catégories : modèles de 1.3B et 14B.

- Wan2.1-Fun-1.3B-Control

- Wan2.1-Fun-14B-Control

- Dépôt de code correspondant : VideoX-Fun

Ce guide couvrira deux types de flux de travail :

- Flux de travail natif de ComfyUI

-

- Entièrement natif (sans dépendre de nœuds personnalisés tiers)

-

- Version améliorée du flux de travail natif (utilisant des nœuds personnalisés)

- Flux de travail utilisant le ComfyUI-WanVideoWrapper de Kijai

- Les deux flux de travail sont essentiellement identiques en termes de modèle, mais j’ai utilisé des modèles de différentes sources pour mieux correspondre aux conditions et à l’utilisation du flux de travail d’origine.

- Pour les opérations vidéo, vous pouvez utiliser le paquet de nœuds personnalisés ComfyUI-VideoHelperSuite pour effectuer des chargements vidéo, des sauvegardes au format mp4, des fusions vidéo, etc.

- Pour l’installation des plugins, veuillez vous référer à ce guide sur comment installer des nœuds personnalisés.

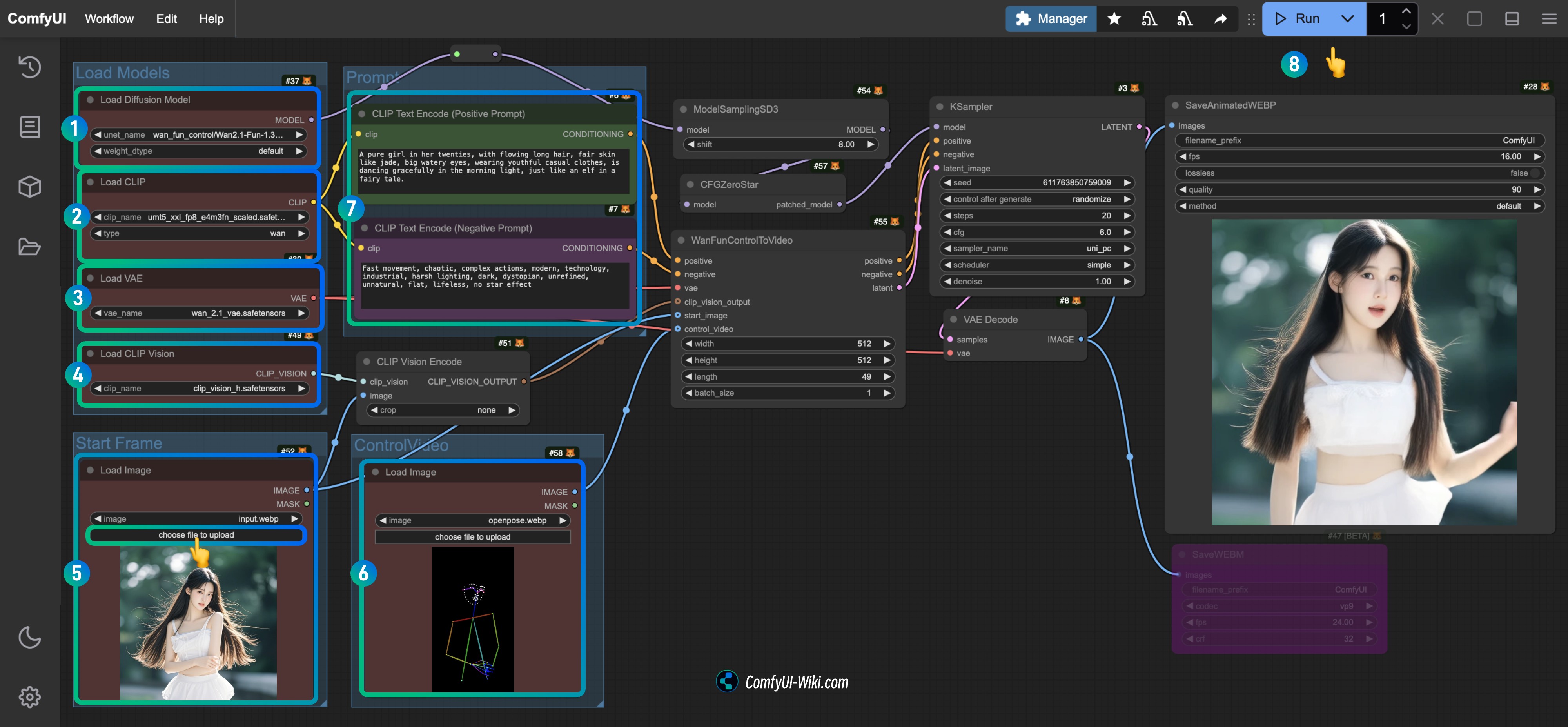

Flux de travail natif Wan2.1 Fun Control dans ComfyUI

Actuellement, ComfyUI prend en charge nativement le modèle Wan Fun Control, mais jusqu’à présent (2025-04-10), aucun exemple de flux de travail correspondant n’a été officiellement publié.

Avant de commencer, assurez-vous que votre version de ComfyUI est au moins postérieure à ce commit pour pouvoir trouver le nœud WanFunControlToVideo. Veuillez consulter comment mettre à jour ComfyUI pour mettre à jour votre version de ComfyUI.

1.1 Téléchargement du fichier de flux de travail Wan2.1 Fun Control

1.1.1 Fichier de flux de travail

Téléchargez l’image ci-dessous et faites-la glisser dans ComfyUI pour charger le flux de travail correspondant et vous indiquer le téléchargement du modèle correspondant.

Téléchargement au format Json

1.1.2 Images de départ et vidéo de contrôle

Téléchargez les images et vidéos ci-dessous, que nous utiliserons comme conditions d’entrée.

- Ici, je fournis une vidéo de contrôle prétraitée, simplement pour ne pas dépendre de nœuds personnalisés tiers et utiliser uniquement des nœuds natifs.

- Vous pouvez utiliser des nœuds personnalisés comme ComfyUI-comfyui_controlnet_aux pour effectuer le prétraitement de la vidéo.

1.2 Installation manuelle des modèles

Si le modèle correspondant n’a pas été téléchargé avec succès, voici les adresses de téléchargement des modèles correspondants.

Modèles de diffusion : choisissez entre 1.3B ou 14B, le fichier de 14B est plus volumineux, offre de meilleures performances, mais nécessite également plus de ressources système.

- Wan2.1-Fun-1.3B-Control : téléchargez et renommez en

Wan2.1-Fun-1.3B-Control.safetensors - Wan2.1-Fun-14B-Control : téléchargez et renommez en

Wan2.1-Fun-14B-Control.safetensors

Encodeurs de texte : choisissez l’un des deux modèles ci-dessous, le modèle fp16 est plus volumineux et exige plus de performances.

VAE

Vision CLIP : utilisé pour extraire les caractéristiques des images.

Emplacement de sauvegarde des fichiers

📂 ComfyUI/

├── 📂 models/

│ ├── 📂 diffusion_models/

│ │ └── Wan2.1-Fun-1.3B-Control.safetensors # Ou la version que vous choisissez

│ ├── 📂 text_encoders/

│ │ └─── umt5_xxl_fp8_e4m3fn_scaled.safetensors # Ou la version que vous choisissez

│ └── 📂 vae/

│ │ └── wan_2.1_vae.safetensors

│ └── 📂 clip_vision/

│ └── clip_vision_h.safetensors 1.3 Exécution du flux de travail étape par étape

- Assurez-vous que le nœud

Load Diffusion Modela chargé le modèleWan2.1-Fun-1.3B-Control.safetensors - Assurez-vous que le nœud

Load CLIPa chargé le modèleumt5_xxl_fp8_e4m3fn_scaled.safetensors - Assurez-vous que le nœud

Load VAEa chargé le modèlewan_2.1_vae.safetensors - Assurez-vous que le nœud

Load CLIP Visiona chargé le modèleclip_vision_h.safetensors - Chargez l’image d’entrée fournie précédemment comme image de départ dans le nœud

Load Image - Téléchargez la vidéo fournie précédemment dans le nœud

Load Imagecomme condition de contrôle - (Optionnel) Modifiez les mots-clés vidéo dans le nœud

CLIP Text Encoder - Cliquez sur le bouton

Run, ou utilisez le raccourciCtrl(cmd) + Enterpour exécuter la génération de vidéo

1.4 Analyse du flux de travail

Le flux de travail natif se concentre principalement sur l’acquisition des images vidéo, le nœud correspondant WanFunControlToVideo propose une longueur par défaut de 81 (ce qui générera une vidéo de 5 secondes à 15 images par seconde), alors que la vidéo de contrôle que j’ai fournie ne contient que 49 images, j’ai donc effectué des ajustements. De plus, vous pourriez remarquer que les personnages dans la vidéo générée semblent soudainement zoomés, cela est dû à l’incohérence de taille entre l’image de départ et la vidéo de contrôle, ce qui a entraîné un recadrage et un agrandissement pendant le traitement.

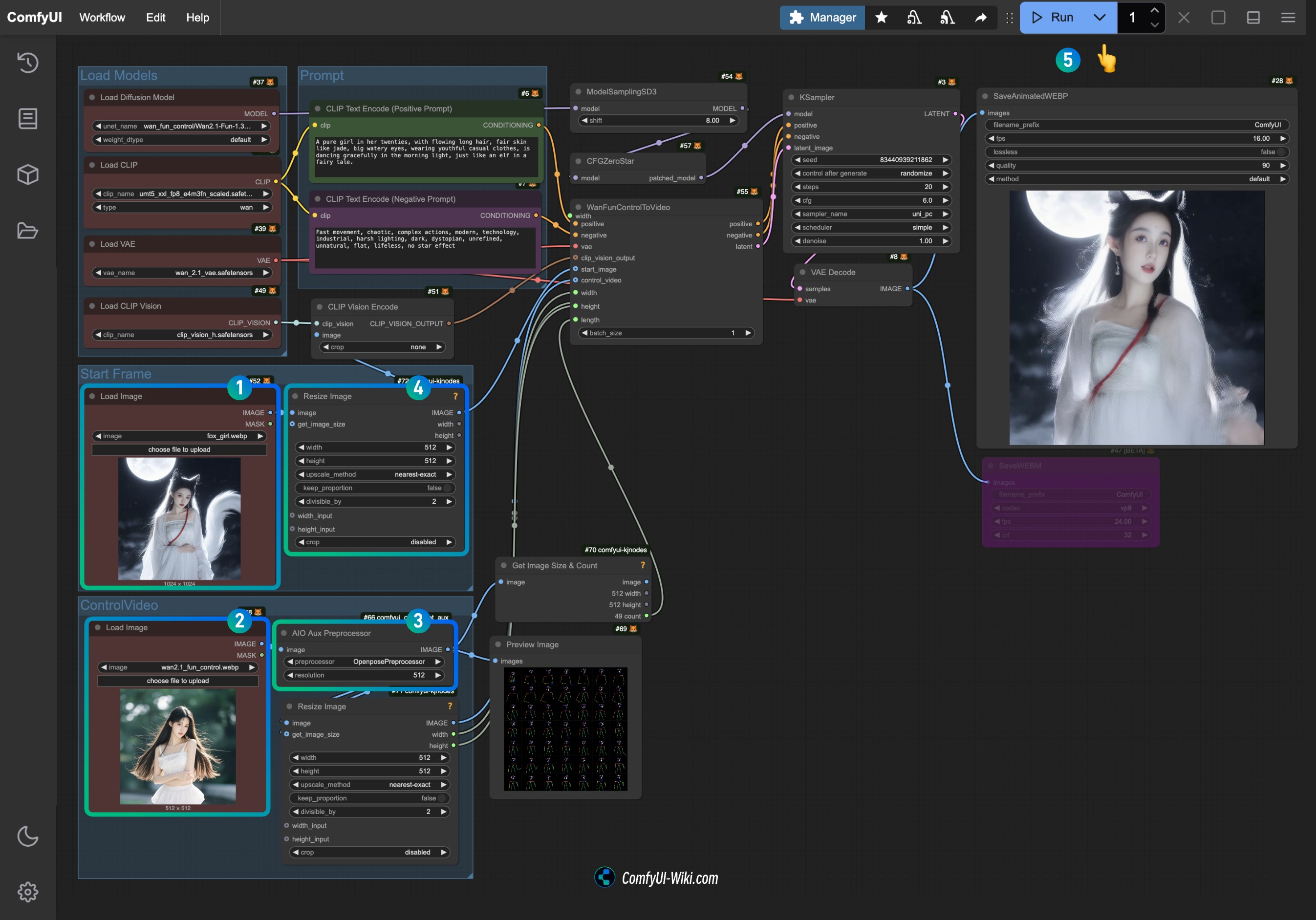

2. Version ajustée du flux de travail natif Wan2.1 Fun Control

Étant donné que le flux de travail entièrement natif n’est pas très pratique en termes de taille vidéo et de calcul du nombre d’images, j’ai utilisé certains nœuds du paquet de nœuds personnalisés dans cette version améliorée du flux de travail :

- ComfyUI-KJNodes pour ajuster la taille de la vidéo et obtenir le nombre d’images

- ComfyUI-comfyui_controlnet_aux : pour le prétraitement des images vidéo

Avant de commencer, assurez-vous d’avoir installé ces deux paquets de nœuds personnalisés, ou utilisez ComfyUI-Manager pour les installer après le chargement du flux de travail.

2.1 Téléchargement du fichier de flux de travail

2.1.1 Téléchargement du fichier de flux de travail

Téléchargez l’image ci-dessous et faites-la glisser dans ComfyUI pour charger le flux de travail correspondant et être invité à télécharger les modèles associés.

2.1.2 Téléchargement de la vidéo d’entrée

Téléchargez les images et vidéos ci-dessous pour les conditions d’entrée.

En raison du manque de temps, j’ai utilisé cette vidéo avec un effet de zoom soudain comme entrée.

2.2 Exécution du flux de travail étape par étape

- Téléchargez l’image d’entrée fournie dans le nœud

Load Imagede la frame de départ - Téléchargez la vidéo fournie dans le nœud

Load Imagede la vidéo de contrôle - Sélectionnez le préprocesseur que vous souhaitez utiliser sur

AIO Aux Preprocessor(le modèle correspondant sera téléchargé depuis Hugging Face lors de la première exécution) - Si vous devez ajuster la taille, modifiez les paramètres de taille dans le nœud

Resize Image, en veillant à ce que les deux nœuds soient cohérents - Cliquez sur le bouton

Run, ou utilisez le raccourciCtrl(cmd) + Enterpour exécuter la génération de vidéo

Actuellement, le nœud Load Image ne prend pas en charge les vidéos mp4. Si vous souhaitez avoir une vidéo d’entrée, vous pouvez utiliser le nœud Load Video (Upload) de ComfyUI-VideoHelperSuite pour gérer divers formats de vidéo.

3. Extensions associées

Vous pouvez ajouter des nœuds de génération d’images à ces flux de travail pour générer la vidéo finale sans dépendre d’images de référence d’entrée.

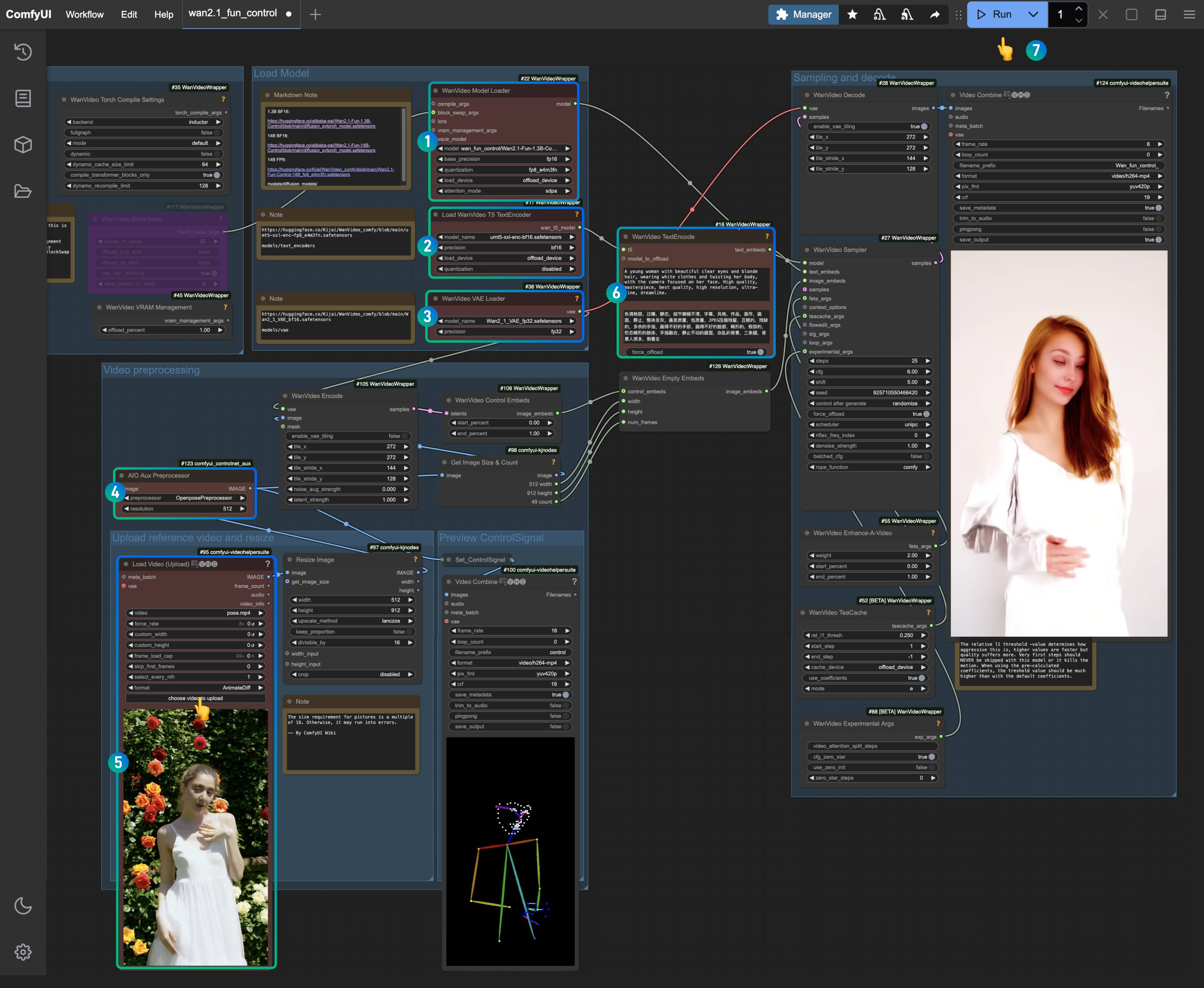

Flux de travail Kijai Wan Fun Control

Nous utiliserons le plugin ComfyUI-WanVideoWrapper de Kijai pour compléter l’exemple de Fun-Control. Vous pouvez trouver le flux de travail original fourni par Kijai ici.

Le flux de travail impliqué dans ce guide a été réorganisé par ComfyUI Wiki.

Cette section du flux de travail sera divisée en deux catégories :

- Flux de travail de contrôle pour image de texte à vidéo utilisant uniquement des conditions de contrôle vidéo

- Flux de travail de contrôle pour génération de vidéo de référence d’image qui analyse et extrait des caractéristiques d’images de référence en utilisant Clip_vision et ajoute des conditions de contrôle vidéo

Installation associée

Installation de nœud personnalisé

Vous devez installer les plugins suivants pour garantir que le flux de travail fonctionne sans problème :

- ComfyUI-WanVideoWrapper : doit être mis à jour vers la dernière version

- ComfyUI-VideoHelperSuite

- ComfyUI-KJNodes

- ComfyUI-comfyui_controlnet_aux : pour le prétraitement des images vidéo, ou vous pouvez le remplacer par vos nœuds de prétraitement d’images couramment utilisés

Vous pouvez utiliser le gestionnaire ComfyUI pour mettre à jour ou installer les nœuds personnalisés mentionnés ci-dessus, ou consulter comment installer des nœuds personnalisés pour compléter l’installation correspondante.

ComfyUI-comfyui_controlnet_aux téléchargera le modèle correspondant lors de la première exécution, assurez-vous que vous pouvez accéder à huggingface normalement.

Installation du modèle

Wan2.1 Fun Control Fournit deux modèles : 1.3B et 14B, vous pouvez choisir le modèle approprié en fonction des performances de votre appareil.

- Wan2.1-Fun-1.3B-Control : renommer en

Wan2.1-Fun-1.3B-Control.safetensorsaprès le téléchargement - Wan2.1-Fun-14B-Control : renommer en

Wan2.1-Fun-14B-Control.safetensorsaprès le téléchargement - Kijai/Wan2.1-Fun-Control-14B_fp8_e4m3fn.safetensors

Choisissez une version de encodeurs de texte à télécharger :

VAE

CLIP Vision

Emplacement de sauvegarde du fichier

📂 ComfyUI/

├── 📂 models/

│ ├── 📂 diffusion_models/

│ │ └── Wan2.1-Fun-1.3B-Control.safetensors # Ou la version que vous choisissez

│ ├── 📂 text_encoders/

│ │ └─── umt5-xxl-enc-bf16.safetensors # Ou la version que vous choisissez

│ ├── 📂 vae/

│ │ └── Wan2_1_VAE_bf16.safetensors

│ └── 📂clip_vision/

│ └── clip_vision_h.safetensors 1. Flux de travail de contrôle vidéo texte-à-vidéo

1.1 Télécharger les fichiers du flux de travail

Téléchargez l’image ci-dessous et faites-la glisser dans ComfyUI pour charger le flux de travail correspondant.

Téléchargez au format JSON.

Téléchargez la vidéo ci-dessous comme vidéo d’entrée.

1.2 Compléter les étapes du flux de travail

Téléchargez l’image ci-dessous et faites-la glisser dans ComfyUI pour charger le flux de travail correspondant.

Assurez-vous que les nœuds correspondants ont chargé les modèles appropriés, en utilisant les versions que vous avez téléchargées.

- Assurez-vous que le nœud

Chargeur de modèles WanVideoa chargé le modèleWan2.1-Fun-1.3B-Control.safetensors. - Assurez-vous que le nœud

Charger l'encodeur de texte WanVideo T5a chargé le modèleumt5-xxl-enc-bf16.safetensors. - Assurez-vous que le nœud

Chargeur de VAE WanVideoa chargé le modèleWan2_1_VAE_bf16.safetensors. - Dans le nœud

Préprocesseur AIO AuxAux, sélectionnez le nœudPréprocesseur Openpose. - Dans le nœud

Charger vidéo (Télécharger), téléchargez la vidéo d’entrée que nous avons fournie précédemment. - Dans l’

Encodeur de texte WanVideo, entrez l’invite pour la vidéo que vous souhaitez générer (vous pouvez la laisser par défaut). - Cliquez sur le bouton

File, ou utilisez le raccourciCtrl(cmd) + Enterpour exécuter la génération de la vidéo.

1.3 Analyse du flux de travail

Cette version du flux de travail encode principalement les conditions de l’image prétraitée et génère ensuite la vidéo. Dans le nœud de prétraitement d’images Préprocesseur Openpose, vous pouvez choisir plusieurs méthodes de prétraitement, telles que Openpose, Depth, Canny, etc. Ici, nous choisissons la méthode de prétraitement Openpose pour générer le contrôle et l’encodage du mouvement du personnage correspondant.

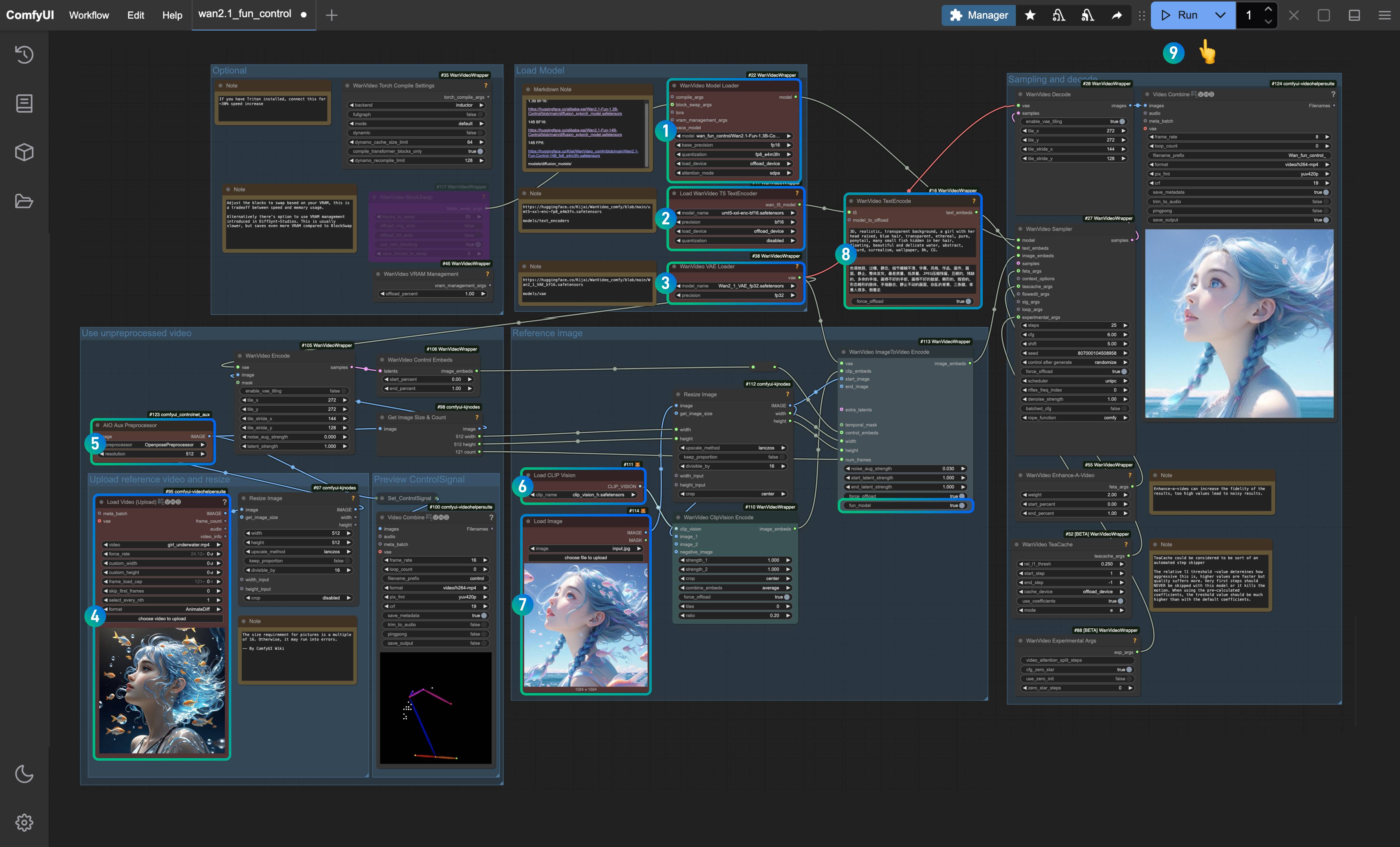

2. Flux de travail de génération de vidéo d’image de référence de contrôle vidéo

Ce flux de travail charge principalement un modèle clip_vision_h.safetensors, qui peut comprendre efficacement le contenu de l’image de référence. Cependant, il ne génère pas la vidéo en préservant complètement la cohérence, mais génère la vidéo basée sur les caractéristiques de l’image de référence.

2.1 Télécharger les fichiers du flux de travail

Téléchargez l’image ci-dessous et faites-la glisser dans ComfyUI pour charger le flux de travail correspondant.

Téléchargez au format JSON.

Téléchargez la vidéo et les images ci-dessous, que nous utiliserons comme conditions d’entrée.

2.2 Compléter les étapes du flux de travail

- Assurez-vous que le nœud

Chargeur de modèles WanVideoa chargé le modèleWan2.1-Fun-1.3B-Control.safetensors. - Assurez-vous que le nœud

Charger l'encodeur de texte WanVideo T5a chargé le modèleumt5-xxl-enc-bf16.safetensors. - Assurez-vous que le nœud

Chargeur de VAE WanVideoa chargé le modèleWan2_1_VAE_bf16.safetensors. - Dans le nœud

Charger vidéo (Télécharger), téléchargez la vidéo d’entrée que nous avons fournie précédemment. - Dans le nœud

Préprocesseur AIO AuxAux, sélectionnez le nœudPréprocesseur Openpose. - Dans le nœud

Charger Vision CLIP, assurez-vous que le modèleclip_vision_h.safetensorsest chargé, qui sera utilisé pour extraire les caractéristiques de l’image de référence. - Dans le nœud

Charger Image, téléchargez l’image de référence fournie précédemment. - Dans l’

Encodeur de texte WanVideo, entrez l’invite pour la vidéo que vous souhaitez générer (vous pouvez la laisser par défaut). - Cliquez sur le bouton

File, ou utilisez le raccourciCtrl(cmd) + Enterpour exécuter la génération de la vidéo.

2.3 Analyse du flux de travail

- Étant donné que Kijai a mis à jour les nœuds correspondants, gardez à l’esprit que le nœud

Encodage d'image à vidéo WanVideoa une option appeléefun_modelqui doit être configurée sur vrai. - Comparé aux autres, utiliser les caractéristiques de l’image de référence sera plus approprié, donc continuer à utiliser une image de référence reste nécessaire. Cependant, étant donné qu’il n’extrait que les caractéristiques de l’image, il ne peut pas maintenir complètement la cohérence du personnage.

- Dans la section de prétraitement des images, vous pouvez essayer de combiner plusieurs nœuds de prétraitement pour générer des conditions de contrôle plus riches.