Guide du workflow ByteDance USO ComfyUI, transfert de style d’image et génération d’images avec préservation de l’identité du sujet

USO (Unified Style and Subject-Driven Generation) est un modèle développé par l’équipe UXO de ByteDance qui unifie les tâches de génération pilotées par le style et le sujet. Construit sur l’architecture FLUX.1-dev, le modèle résout le problème où les méthodes traditionnelles traitent la génération pilotée par le style et le sujet comme des tâches opposées. USO résout cela grâce à un cadre unifié avec le découplage et la recombinaison du contenu et du style comme objectif central.

Le modèle adopte une méthode d’entraînement en deux étapes :

- Étape Un : Aligner les embeddings SigLIP par entraînement d’alignement de style pour obtenir un modèle avec des capacités de style

- Étape Deux : Découpler l’encodeur conditionnel et s’entraîner sur des données triplet pour réaliser une génération conditionnelle conjointe

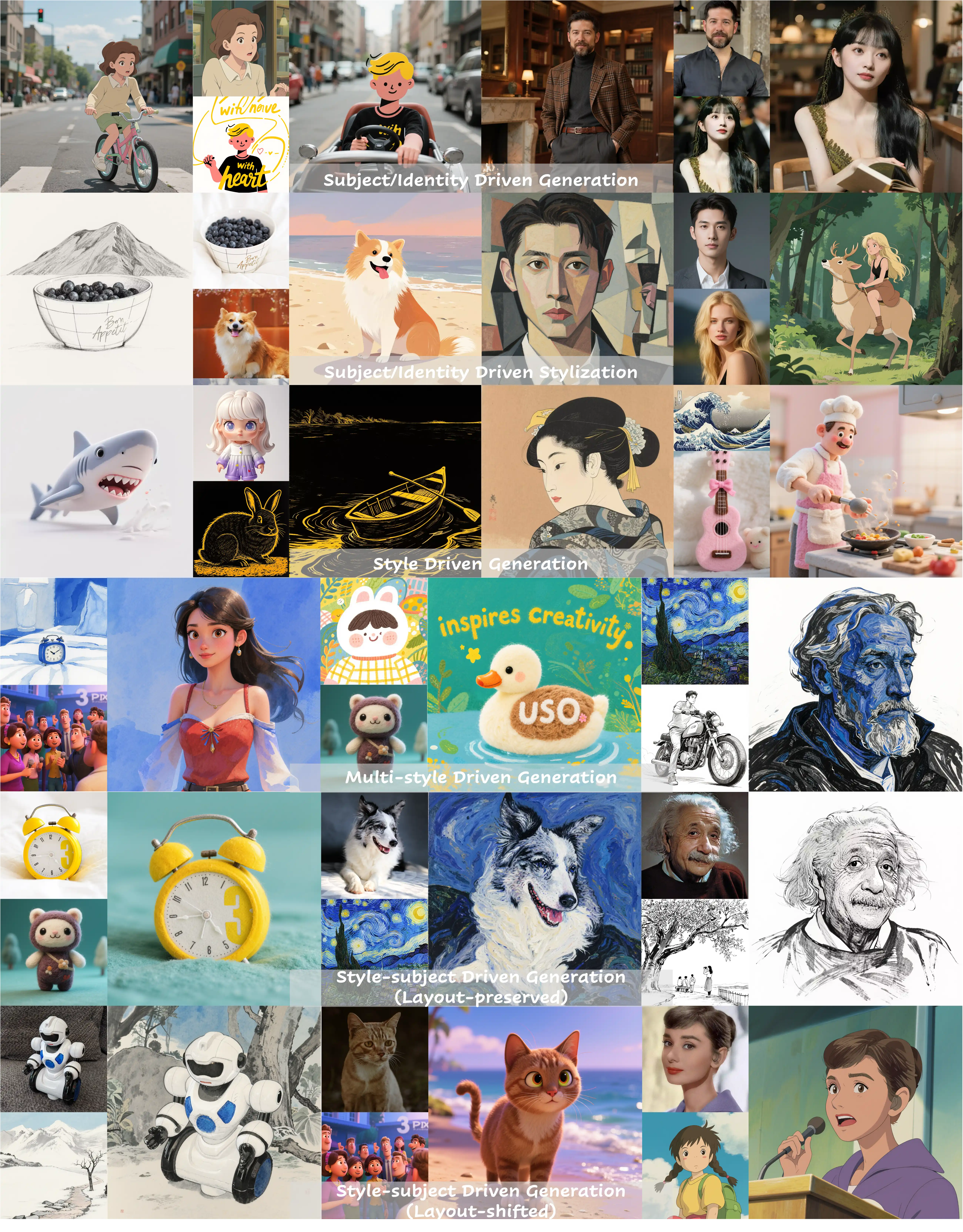

USO prend en charge plusieurs modes de génération :

- Génération pilotée par le sujet : Maintient la cohérence de l’identité du sujet, adapté pour styliser des sujets spécifiques tels que des personnes et des objets

- Génération pilotée par le style : Réalise un transfert de style de haute qualité en appliquant le style d’images de référence à un nouveau contenu

- Génération pilotée par l’identité : Réalise une stylisation tout en maintenant les caractéristiques d’identité, particulièrement adapté pour la stylisation de portraits

- Génération conjointe style-sujet : Contrôle simultanément le sujet et le style pour réaliser des expressions créatives complexes

- Génération mixte multi-style : Prend en charge l’application de fusion de plusieurs styles

Liens associés

Workflow natif ByteDance USO ComfyUI

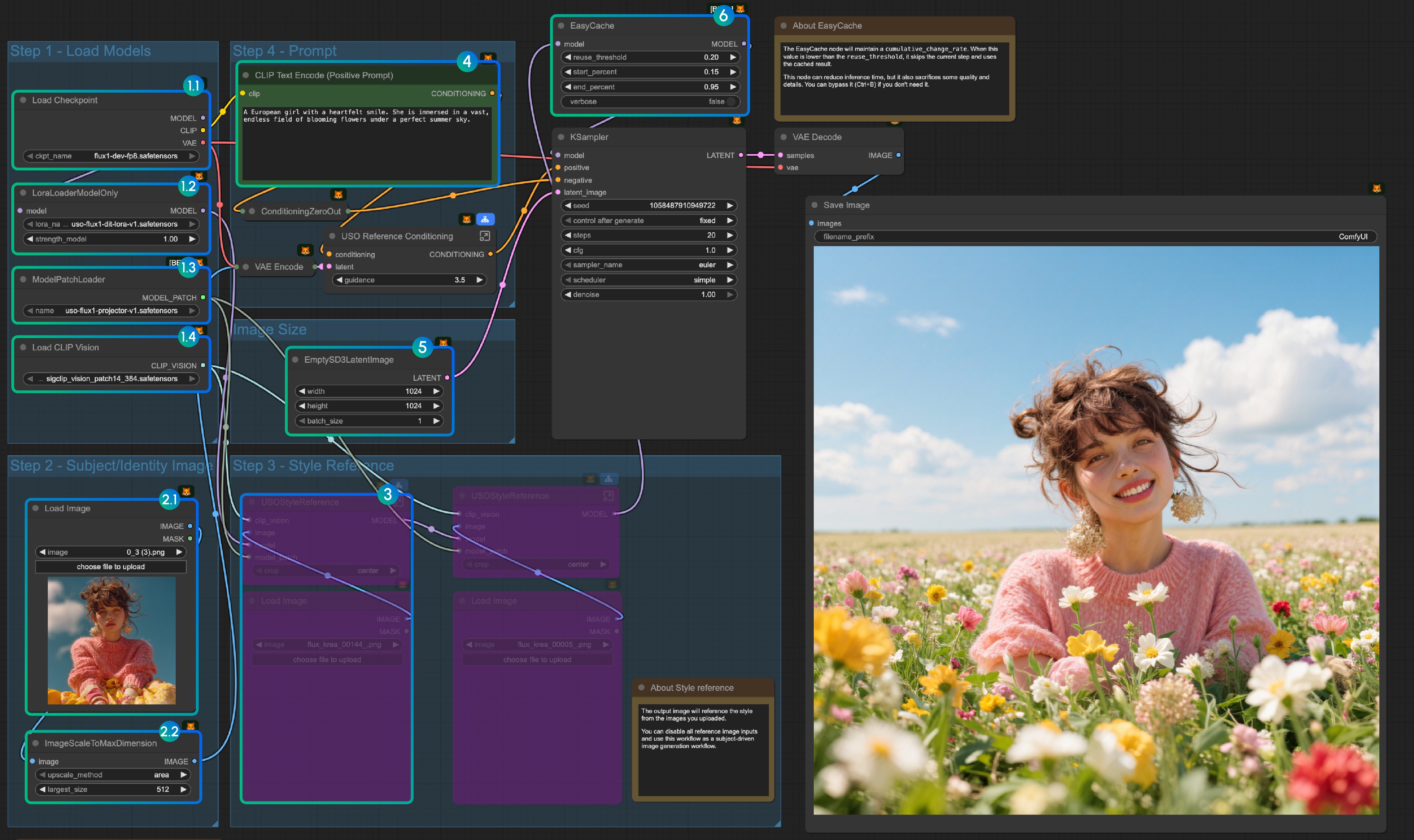

1. Workflow et entrée

Téléchargez l’image ci-dessous et faites-la glisser dans ComfyUI pour charger le workflow correspondant.

Utilisez l’image ci-dessous comme image d’entrée.

2. Liens des modèles

checkpoints

loras

model_patches

clip_visions

Veuillez télécharger tous les modèles et les placer dans les répertoires suivants :

📂 ComfyUI/

├── 📂 models/

│ ├── 📂 checkpoints/

│ │ └── flux1-dev-fp8.safetensors

│ ├── 📂 loras/

│ │ └── uso-flux1-dit-lora-v1.safetensors

│ ├── 📂 model_patches/

│ │ └── uso-flux1-projector-v1.safetensors

│ ├── 📂 clip_visions/

│ │ └── sigclip_vision_patch14_384.safetensors3. Instructions du workflow

- Charger les modèles :

- 1.1 Assurez-vous que le nœud

Load Checkpointa chargéflux1-dev-fp8.safetensors - 1.2 Assurez-vous que le nœud

LoraLoaderModelOnlya chargédit_lora.safetensors - 1.3 Assurez-vous que le nœud

ModelPatchLoadera chargéprojector.safetensors - 1.4 Assurez-vous que le nœud

Load CLIP Visiona chargésigclip_vision_patch14_384.safetensors

- 1.1 Assurez-vous que le nœud

- Référence de contenu :

- 2.1 Cliquez sur

Uploadpour télécharger l’image d’entrée que nous avons fournie - 2.2 Le nœud

ImageScaleToMaxDimensionmettra à l’échelle votre image d’entrée pour la référence de contenu, 512px conservera davantage de caractéristiques du personnage, mais si vous utilisez uniquement la tête du personnage comme entrée, l’image de sortie finale présente souvent des problèmes comme le personnage qui prend trop d’espace. Le définir à 1024px donne des résultats beaucoup meilleurs.

- 2.1 Cliquez sur

- Dans l’exemple, nous n’utilisons que l’entrée d’image

référence de contenu. Si vous souhaitez utiliser l’entrée d’imageréférence de style, vous pouvez utiliserCtrl-Bpour contourner le groupe de nœuds marqué. - Rédigez votre prompt ou gardez celui par défaut

- Définissez la taille de l’image si nécessaire

- Le nœud EasyCache sert à l’accélération de l’inférence, mais sacrifie également une certaine qualité et des détails. Vous pouvez le contourner (Ctrl+B) si vous n’avez pas besoin de l’utiliser.

- Cliquez sur le bouton

Run, ou utilisez le raccourciCtrl(Cmd) + Entréepour exécuter le workflow

4. Notes supplémentaires

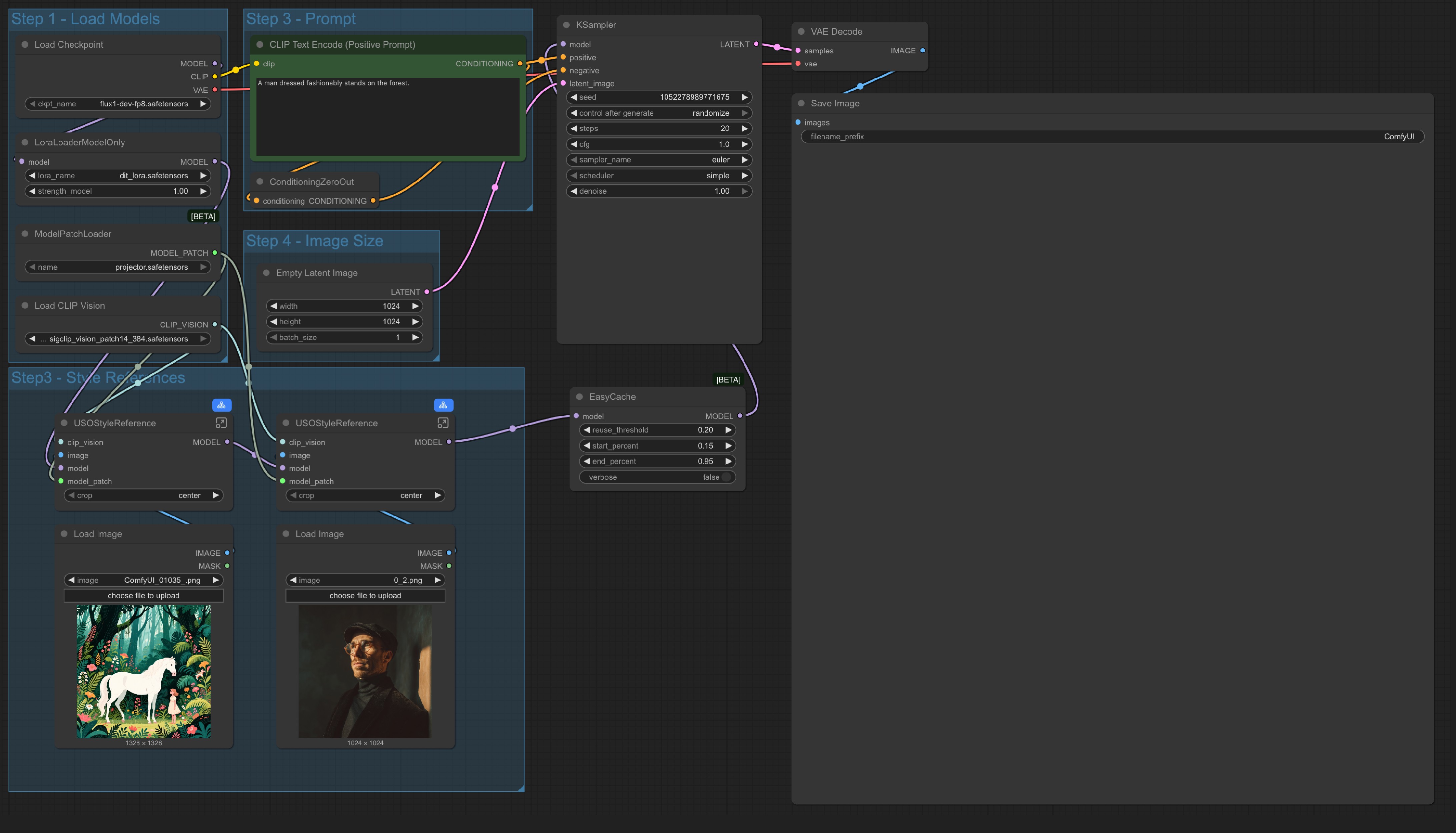

- Référence de style uniquement :

Nous fournissons également un workflow qui utilise uniquement la référence de style dans le même workflow que nous avons fourni

La seule différence est que nous avons remplacé le nœud

La seule différence est que nous avons remplacé le nœud référence de contenu et n’utilisons qu’un nœud Empty Latent Image.

- Vous pouvez également contourner tout le groupe

Référence de styleet utiliser le workflow comme un workflow texte vers image, ce qui signifie que ce workflow a 4 variantes :

- Génération pilotée par le sujet : Utiliser uniquement la référence de contenu (sujet)

- Génération pilotée par le style : Utiliser uniquement la référence de style

- Génération conjointe style-sujet : Référence de contenu et de style mixte

- Génération texte vers image : Comme un workflow standard texte vers image