AIGC 最新动态

及时了解 AIGC 领域的最新进展和更新。

OpenMOSS 发布 MOVA - 开源音视频同步生成模型

OpenMOSS 团队发布 MOVA (MOSS Video and Audio),这是一个端到端的音视频同步生成基础模型,支持单次推理生成视频和音频,实现精确的口型同步和环境感知音效,完全开源模型权重、训练和推理代码

阿里巴巴通义实验室发布 Z-Image-Base - 非蒸馏版高质量图像生成模型

阿里巴巴通义实验室发布 Z-Image-Base,这是 Z-Image 系列的非蒸馏基础模型,保留了完整的生成潜力,为社区微调和定制开发提供理想基础

DeepSeek 发布 DeepSeek-OCR-2 - 引入视觉因果流的文档理解模型

DeepSeek 开源 DeepSeek-OCR-2,引入全新 DeepEncoder V2 视觉编码器,通过视觉因果流机制模仿人类阅读逻辑,在 OmniDocBench v1.5 上达到 91.09% 准确率

月之暗面发布 Kimi K2.5 - 1T 参数原生多模态 Agent 大模型

月之暗面正式发布 Kimi K2.5,这是一个 1T 参数的原生多模态 Agent 模型,在 15 万亿混合视觉和文本 token 上持续预训练,支持图像、视频理解,并引入 Agent Swarm 自主协作机制

阿里通义千问发布 Qwen3-TTS - 97ms 超低延迟语音合成模型

阿里巴巴通义千问开源 Qwen3-TTS 系列语音生成模型,采用 Dual-Track 双轨建模实现 97ms 超低延迟,支持 3 秒音色克隆、自然语言音色设计,覆盖 10 种主流语言

微软发布 VibeVoice-ASR - 支持 60 分钟长音频单次处理的语音识别模型

微软开源 VibeVoice-ASR,一个 9B 参数的统一语音识别模型,能够一次性处理长达 60 分钟的音频,在单一推理过程中联合完成识别、说话人日志与时间戳生成

NVIDIA 发布 PersonaPlex-7B-v1 - 全双工语音对话模型

NVIDIA 开源 PersonaPlex-7B-v1,一款基于 Moshi 架构的 70 亿参数全双工语音对话模型,支持边听边说、自然打断和角色定制,中断响应延迟低至 240 毫秒

SVI 2.0 Pro 发布 - 支持 Wan 2.2 的无限长度视频生成

Stable Video Infinity 2.0 Pro 版本正式发布,新增对 Wan 2.2 基础模型的支持,提供 HIGH 和 LOW 两种版本的 LoRA 模型,可在 ComfyUI 中生成无限长度的视频内容

Qwen-Image-Layered 发布 - 支持图像分层编辑的生成模型

Qwen-Image-Layered 可以将图像分解为多个 RGBA 图层,每个图层可以独立编辑而不影响其他内容,支持重新着色、替换、删除、调整大小和移动等操作

微软发布TRELLIS.2 - 40亿参数的图像转3D生成模型

微软推出TRELLIS.2,一个40亿参数的大型3D生成模型,可在数秒内将图像转换为高质量的3D资产,支持完整PBR材质和复杂拓扑结构

阿里云 PAI 发布 Z-Image-Turbo-Fun-Controlnet-Union

阿里云 PAI 团队发布 Z-Image-Turbo-Fun-Controlnet-Union,一个为 Z-Image-Turbo 设计的 ControlNet 模型,支持 Canny、HED、Depth、Pose 和 MLSD 等控制条件

阿里巴巴 AIDC-AI 发布 Ovis-Image - 7B参数文本渲染优化的图像生成模型

阿里巴巴 AIDC-AI 团队发布 Ovis-Image,一个专注于高质量文本渲染的7B参数文生图模型,在多项文本渲染基准测试中表现出色,可在单张高端GPU上高效运行

阿里巴巴通义实验室发布 Z-Image-Turbo - 高效6B参数图像生成模型

阿里巴巴通义实验室发布Z-Image-Turbo,一个6B参数的高效图像生成模型,仅需8步采样即可生成高质量图像,在16GB显存消费级显卡上流畅运行

ByteDance发布Sa2VA:首个图像视频统一理解模型

ByteDance推出Sa2VA多模态模型,结合SAM2与LLaVA技术,实现图像和视频的密集分割与视觉问答,在多项基准测试中达到最佳性能

腾讯混元图像3.0发布 - 全球最大开源文本生成图像模型

腾讯发布混元图像3.0,这是首个开源商用级原生多模态生图模型,总参数达80B,具备世界知识推理能力,支持千字级复杂语义理解

Nunchaku 发布 4-Bit Lightning Qwen-Image-Edit-2509 模型

Nunchaku 团队发布了优化版本的 4-Bit Lightning Qwen-Image-Edit-2509 模型,支持 4/8 步快速推理,在 8GB 显存环境下也能流畅运行

阿里巴巴发布Wan-Animate模型 - 统一角色动画和替换技术

阿里巴巴通义实验室推出Wan-Animate,一个基于Wan2.2的统一角色动画框架,支持角色动画生成和视频角色替换,现已开源模型权重和推理代码

Comfy Cloud - 云端轻松访问ComfyUI

Comfy Cloud为用户提供便捷的ComfyUI云端访问,配备高性能GPU、主流模型和自定义节点。欢迎加入私测,免费体验云端ComfyUI。

腾讯混元世界Voyager:从单张图片生成3D世界探索视频

腾讯混元团队发布Voyager技术,能够从单张图片和用户定义的相机路径生成世界一致的3D点云序列视频,支持无限世界探索和直接3D重建

字节跳动发布USO:统一风格和主体驱动的图像生成模型

字节跳动推出USO模型,能够自由组合任何主体与任何风格,在保持主体一致性的同时实现高质量的风格迁移效果

Wan-S2V:音频驱动的视频生成模型发布

Wan-S2V是一款AI视频生成模型,能够将静态图像和音频转换为视频,支持对话、歌唱、表演等内容创作需求。

ComfyUI 挑战赛 #1:参与即有机会赢取100美元

参加首次ComfyUI每周挑战赛,赢取100美元奖金!使用提供的深度图创建一个视频,将猫人角色转过来。

InfiniteTalk开源发布 - 支持无限长度的音频驱动视频生成技术

MeiGen-AI团队开源InfiniteTalk模型,实现精准唇形同步和无限长度视频生成,支持图像到视频和视频到视频的转换,为数字人技术带来新突破。

ComfyUI 推出子图(Subgraph)功能现已正式推出

ComfyUI 正式推出子图(Subgraph)功能,允许用户将复杂的节点组合打包成单个可重用的子图节点,大幅提升工作流的模块化和可管理性。

Qwen-Image 在 ComfyUI 获得原生支持

Qwen-Image 是 20B 参数 MMDiT 图像生成模型,主打复杂文本渲染与精细编辑,现已可在 ComfyUI 使用。本文概览其核心能力、许可与资源链接。

腾讯混元团队开源 MixGRPO 框架,提升人类偏好对齐训练效率

腾讯混元团队发布开源 MixGRPO 框架,首个集成滑动窗口混合 ODE-SDE 采样的 GRPO 框架,可将训练速度提升71%,适用于扩散模型和流模型的人类偏好对齐任务。

Black Forest Labs 发布 FLUX.1 Krea [dev] 开源版本,ComfyUI 原生支持已发布

Black Forest Labs 与 Krea 合作开发的 FLUX.1 Krea [dev] 模型正式开源发布,这是目前最好的开源权重 FLUX 模型。ComfyUI 已实现原生支持,用户可直接体验最新文本生成图像技术。

阿里云通义万相发布Wan2.2开源版本,ComfyUI原生支持已发布

阿里云通义万相团队正式发布Wan2.2开源版本,采用创新的MoE架构,为视频生成带来显著质量提升。ComfyUI已实现原生支持,用户可直接体验最新视频生成技术。

字节开源 Seed-X 7B:支持28种语言互译的小型翻译模型

字节跳动开源了专为翻译任务设计的Seed-X 7B模型,支持28种语言互译,方便AI图像生成等多场景集成。

PUSA V1.0:低成本高性能视频生成模型发布

PUSA V1.0 通过创新的 VTA 技术,仅用极少的数据和成本,实现了高质量多任务视频生成,支持图像到视频、首尾帧生成、视频扩展、文生视频等功能。

AMAP 发布 FLUX-Text 场景文本编辑新方法

AMAP 团队发布 FLUX-Text,一种基于扩散模型的场景文本编辑新方法,支持多语言、风格一致性与高保真文本编辑。

OmniAvatar:高效音频驱动的虚拟人视频生成模型发布

OmniAvatar模型正式开源,支持音频驱动的全身虚拟人视频生成,具备自然动作与丰富表情,适用于播客、互动、动态场景等多种应用。

通义实验室发布 ThinkSound:多模态音频生成与编辑新范式

通义实验室开源 ThinkSound,首个支持链式推理的 Any2Audio 统一音频生成与编辑框架,支持视频、文本、音频等多模态输入,具备高保真、强同步、可交互编辑能力。

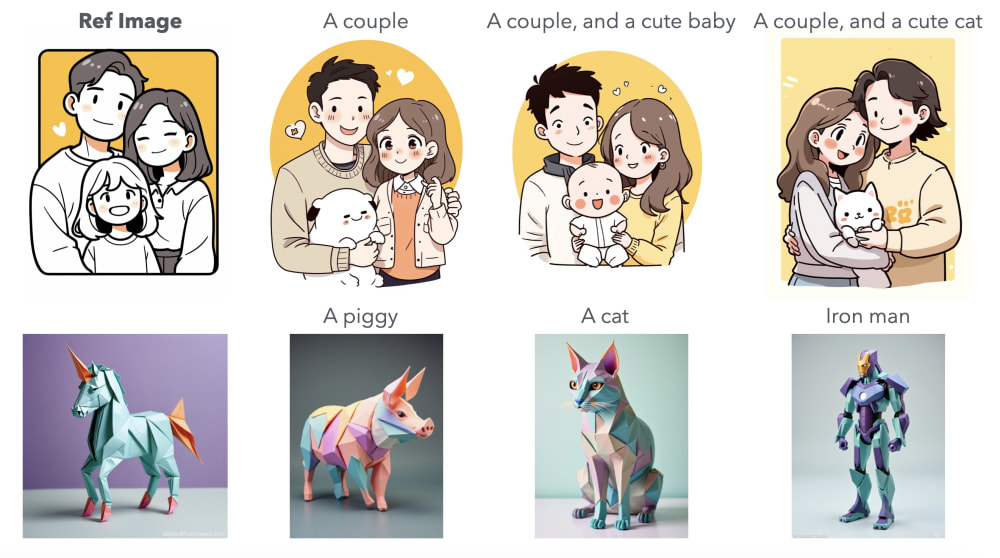

XVerse发布:多主体身份与语义属性可控的高一致性图像生成模型

字节跳动开源XVerse模型,实现多主体身份与语义属性(如姿态、风格、光照等)的高精度独立控制,提升AI图像生成的个性化与复杂场景表现力。

Flux.1 Kontext Dev 开源版本发布,ComfyUI 已原生支持

Black Forest Labs 发布 Flux.1 Kontext Dev 开源版本,这是一个拥有 120 亿参数的开源扩散变压器模型,ComfyUI 已在第一时间提供原生支持

OmniGen2发布:支持自然语言指令的统一图像理解与生成模型

VectorSpaceLab发布OmniGen2,这是一个强大的多模态生成模型,支持通过自然语言指令实现精准的局部图像编辑,包括对象删除替换、风格转绘、背景处理等多种编辑任务

NVIDIA 发布 UniRelight - 基于扩散模型的通用重照明技术

NVIDIA 研究团队推出 UniRelight,这是一项基于扩散模型的通用重照明技术,能够仅通过单个图像或视频实现高质量的重照明效果

新加坡国立大学发布 OmniConsistency - 低成本实现图像风格化一致性

新加坡国立大学团队推出 OmniConsistency 项目,仅需 2600 对图像和 500 小时 GPU 训练即可实现接近 GPT-4o 水平的图像风格化一致性,现已支持 ComfyUI 节点

Black Forest Labs 发布 FLUX.1 Kontext:支持上下文感知的图像编辑模型套件

Black Forest Labs 推出 FLUX.1 Kontext 系列模型,首次实现基于文本和图像输入的上下文感知编辑,支持角色一致性保持和本地化编辑功能

ID-Patch:多身份个性化合影生成新方法

字节跳动与密歇根州立大学联合提出ID-Patch方法,实现多身份个性化图像生成,提升身份保持与生成效率,适用于合影、广告等多角色场景。

腾讯开源语音数字人模型 HunyuanVideo-Avatar:一张图+音频即可生成自然数字人视频

腾讯发布 HunyuanVideo-Avatar,支持通过图片和音频生成高保真、情感可控的数字人视频,适用于短视频、电商广告等多场景。

Pixel-Reasoner:开源像素级视觉推理模型发布

Pixel-Reasoner 基于 Qwen2,具备全局与局部像素级视觉理解和推理能力,支持细节放大分析,推动视觉语言模型新进展。

IndexTTS 1.5版本发布:高质量中英文语音合成模型

IndexTTS发布1.5版本,显著提升模型稳定性和英语性能,支持拼音发音纠正和标点符号控制停顿,在多项测试中超越主流TTS系统

阶跃星辰开源Step1X-3D - 高保真3D资产生成框架

阶跃星辰发布Step1X-3D开源框架,可从单张图像生成高质量3D几何体和纹理,包含200万高质量数据集、完整训练代码和模型权重

BAGEL:字节跳动开源统一多模态基础模型,支持文本、图像、视频理解与生成

字节跳动发布 BAGEL,一个具备 7B 活跃参数的开源多模态基础模型,支持文本、图像、视频等多模态数据的理解与生成,在多项公开基准测试中表现优异。

ComfyUI 前端受部分节点影响的更新提示

近期 ComfyUI 更新后,部分自定义节点可能导致前端异常,本文汇总了受影响的插件及解决方法,建议及时更新或卸载相关插件。

Step1X-3D项目发布高质量3D资产生成与开源计划

Step1X-3D团队发布了高保真3D资产生成方案,开放了模型、数据集和代码,支持多种3D资产生成与纹理合成。

腾讯发布混元定制视频生成系统HunyuanCustom

腾讯推出的多模态视频定制生成框架HunyuanCustom,支持文本、图像、音频和视频条件,实现多场景下的高一致性视频生成

Insert Anything: 开源图像无缝插入编辑框架

Insert Anything是一个开源的统一框架,能够将参考图像中的人物、物体和服装等元素无缝插入到目标场景中,支持多种场景应用

Step1X-Edit: 开源AI图像编辑框架

Step1X-Edit是一个功能强大的开源图像编辑框架,支持自然语言指令编辑图像,提供类似于GPT-4o和Gemini2 Flash的图像编辑能力

Flex.2-preview:开源AI图像生成模型发布

Flex.2-preview是一款具有通用控制和内置修复绘制功能的开源文本到图像扩散模型,为创作者提供更强大的图像生成工具

Sand AI发布MAGI-1:规模化自回归视频生成模型

Sand AI开源了MAGI-1,这是一个能够逐块生成视频的自回归模型,提供24B和4.5B参数版本,支持多种视频生成方式

SkyReels-V2发布:支持无限长度视频生成的开源模型

SkyworkAI发布全新开源视频生成模型SkyReels-V2,支持无限长度视频生成,同时兼具文生视频和图生视频功能

Nari Labs发布Dia 1.6B文本对话语音合成模型

Nari Labs推出开源文本转语音模型Dia 1.6B,能够直接从文本生成多角色对话,支持情感表达和非语言交流

昆仑万维发布SkyReels-V2无限时长电影生成模型

昆仑万维SkyReels团队发布并开源SkyReels-V2,这是全球首个使用扩散强迫框架的无限时长电影生成模型,能够生成高质量、长时间的视频内容

Shakker Labs发布FLUX.1-dev-ControlNet-Union-Pro-2.0

Shakker Labs推出全新的FLUX.1-dev-ControlNet-Union-Pro-2.0模型,优化控制效果,支持多种控制模式,模型尺寸更小

腾讯混元与InstantX团队发布InstantCharacter开源项目

InstantCharacter是一种创新的无需微调方法,可实现从单一图像进行角色一致性生成,支持多种下游任务

FramePack: 高效视频生成的下一帧预测模型

Lvmin Zhang开发的FramePack技术通过压缩输入帧上下文,使得视频生成计算负载与视频长度无关,即使在笔记本电脑GPU上也能处理大量帧

字节跳动推出Seaweed-7B:高性价比的视频生成基础模型

Seaweed-7B以仅70亿参数的规模实现超越140亿参数模型的性能,训练成本仅为行业标准的三分之一,为视频生成领域带来新的可能性

FloED: 基于光流引导的高效视频修复扩散模型开源

一种新的视频修复框架FloED已发布代码和权重,通过光流引导技术实现更高视频连贯性和计算效率

PixelFlow: 直接在像素空间工作的生成模型

PixelFlow创新地在原始像素空间操作,简化了图像生成流程,无需使用预训练的变分自编码器,实现了端到端可训练的模型

VAST-AI发布HoloPart: 生成式3D部件非模态分割技术

HoloPart能将3D模型分解为完整、具有语义意义的部件,解决了3D内容创作中的编辑难题

VAST-AI与清华大学联合开源UniRig:一个能为所有3D模型自动绑定骨骼的框架

UniRig利用自回归模型为多样化的3D模型生成高质量骨骼结构和蒙皮权重,大幅简化动画制作流程

OmniSVG:复旦大学与StepFun联合发布统一矢量图形生成模型

OmniSVG是一种新型统一多模态SVG生成模型,能够基于文本、图像或角色参考等多种输入方式生成高复杂度、可编辑的矢量图形

TTT-Video:长视频生成技术

研究人员利用Test-Time Training技术,基于CogVideoX 5B模型开发了能生成长达63秒连贯视频的TTT-Video模型

字节跳动发布UNO:从少到多的生成能力扩展

字节跳动智能创作团队发布UNO模型,通过上下文生成方式解锁更多可控性,实现从单到多主体的高质量图像生成

EasyControl: 为扩散变换器带来高效灵活控制的新框架

Tiamat AI团队发布EasyControl框架,为DiT模型添加条件控制能力,现已支持通过ComfyUI-easycontrol插件在ComfyUI中使用

HiDream-I1开源发布 - 新一代开源图像生成模型

智象未来(HiDream.ai)发布全新开源文生图模型HiDream-I1,拥有17B参数,在多项基准测试中超越现有开源模型,支持多种风格的高质量图像生成

Hi3DGen: 通过法线桥接实现高保真3D几何生成的新框架

Stable-X团队推出Hi3DGen,一种创新的从图像生成高保真3D模型的框架,通过法线桥接技术解决了现有方法几何细节不足的问题

VAST AI Research开源TripoSF:重新定义3D生成技术新高度

TripoSF基于创新的SparseFlex表示法,支持高达1024³分辨率的3D模型生成,能够处理开放表面和复杂内部结构,显著提升3D资产质量

昆仑万维开源SkyReels-A2:商用级视频生成框架

昆仑万维发布全球首个商用级可控视频生成框架SkyReels-A2,通过双分支架构实现多元素视频生成,为电商、影视创作等领域带来新可能

阿里通义实验室发布VACE:视频创作与编辑迈入一体化时代

阿里巴巴集团旗下通义实验室发布全球首个面向多元视频任务的统一创作与编辑框架VACE,实现从文本生成视频、视频编辑到复杂任务组合的全流程覆盖

StarVector: 基于多模态模型的SVG代码生成工具

StarVector项目实现了从图像和文本自动生成SVG矢量图形代码,为设计师和开发者提供了新的创作工具

字节跳动发布 InfiniteYou:保留用户身份特征的灵活图像再创作框架

字节跳动推出 InfiniteYou (InfU),一种基于扩散变换器的创新框架,能在保持用户身份的同时进行灵活的图像再创作,解决现有方法在身份相似度、文本图像对齐和生成质量方面的不足

Stability AI发布Stable Virtual Camera:将2D照片转换为3D视频的技术

Stability AI推出新型AI模型Stable Virtual Camera,能将普通照片转换为具有真实深度和透视效果的3D视频,为创作者提供直观的相机控制

StdGEN: 从单一图像生成语义分解的3D角色

清华大学与腾讯AI实验室联合推出StdGEN,一种创新的管道,可从单一图像生成语义分解的高质量3D角色,实现身体、衣物和头发等组件的分离

腾讯混元3D 2.0:几何与纹理分离的架构驱动高质量3D资产生成

腾讯开源混元3D 2.0系统采用两阶段生成架构,实现高质量3D模型创建,支持多模态输入,显著提升几何精度与纹理质量

快手发布ReCamMaster单目视频重运镜技术

快手科技发布ReCamMaster,一项允许用户从单个视频创建新相机视角和运动轨迹的生成式视频技术

Open-Sora 2.0发布:低成本实现商业级视频生成能力

潞晨科技发布Open-Sora 2.0开源视频生成模型,仅用20万美元训练成本实现接近顶级商业模型的性能表现

阿里通义实验室发布VACE:一体化视频创建与编辑模型

阿里通义实验室推出多功能视频创建与编辑模型VACE,将多种视频处理任务整合于单一框架,降低视频创作门槛

微软发布ART多层透明图像生成技术

微软研究院推出基于全局文本提示的智能分层生成方案,支持创建包含50+独立图层的透明图像

腾讯开源图像生视频模型 HunyuanVideo-I2V

腾讯混元团队推出支持单图生成5秒视频的开源模型,提供智能动作生成与特效定制功能

阿里开源智能文档分析工具ViDoRAG

阿里巴巴推出能同时理解文字和图片的文档分析系统,处理复杂文档效率提升10%以上

智谱团队(THUDM)开源CogView4 - 原生支持中文的DiT文生图模型

智谱AI团队(THUDM)发布CogView4开源图像生成模型,支持中英双语输入与汉字生成,在多项基准测试中表现领先

Sesame发布CSM语音模型,实现拟真对话

Sesame团队推出基于双Transformer架构的对话语音模型CSM,通过端到端学习实现拟真对话交互,开源核心架构并提供在线演示

阿里巴巴通义万相 Wan2.1 视频生成模型正式开源

阿里巴巴正式开源其最新视频生成模型 Wan2.1,该模型仅需 8GB 显存即可运行,支持高清视频生成、动态字幕和多语言配音,在 VBench 榜单上以 86.22% 的总分超越 Sora 等模型

阿里巴巴开源 ComfyUI Copilot:AI 驱动的智能工作流助手

阿里巴巴国际数字商业集团(AIDC-AI)发布 ComfyUI Copilot 插件,通过自然语言交互和 AI 驱动功能简化 ComfyUI 的使用体验,支持中文交互,提供智能节点推荐等功能

阿里巴巴通义万相视频生成模型 WanX 2.1 即将开源

阿里巴巴宣布其最新视频生成模型 WanX 2.1 将于2025年第二季度开源,该模型支持高清视频生成、动态字幕和多语言配音,在VBench榜单上以84.7%的总分位居榜首

谷歌发布 PaliGemma 2 mix:支持多任务的开源视觉语言模型

Google 推出全新的 PaliGemma 2 mix 模型,支持图像描述、OCR、目标检测等多种视觉任务,提供 3B、10B 和 28B 三种规模版本

昆仑万维开源 SkyReels-V1:专注 AI 短剧创作的视频生成模型

昆仑万维发布开源视频生成模型 SkyReels-V1,支持文生视频和图生视频,具备电影级光影效果和自然动作表现,并已开放商用

Light-A-Video - 无需训练的视频重照明技术

研究人员提出了一种新的视频重照明方法 Light-A-Video,通过一致光注意力(CLA)和渐进式光融合(PLF)实现了时间上平滑的视频重照明效果

StepFun开源Step-Video-T2V:300亿参数文生视频模型发布

StepFun发布开源文生视频模型Step-Video-T2V,拥有300亿参数,支持生成长达204帧的高质量视频,并提供在线体验平台

快手推出CineMaster:突破3D感知的智能视频生成框架

快手正式发布CineMaster文本到视频生成框架,通过3D感知技术实现高品质视频内容创作

阿里巴巴开源 InspireMusic:创新的音乐、歌曲和音频生成框架

阿里巴巴最新开源项目 InspireMusic 是一个基于 FunAudioLLM 的综合音频生成框架,支持音乐制作、歌曲生成等多种音频合成任务。

阿里开源ACE++:无需训练实现角色一致图像生成

阿里巴巴研究院开源图像生成工具ACE++,通过上下文感知内容填充技术,支持单图输入生成角色一致的新图像,提供在线体验与三类专用模型。

字节跳动发布 OmniHuman:新一代人体动画生成框架

字节跳动研究团队发布 OmniHuman-1 人体动画生成框架,通过单张图片和动作信号即可生成高质量人体视频动画。

DeepSeek开源 Janus-Pro-7B 多模态 AI 模型性能超越DALL-E 3

TurboDiffusion 发布视频生成加速框架

清华大学团队开源 TurboDiffusion,一个视频生成加速框架,可在单个 RTX 5090 上实现 100-205 倍的端到端扩散生成加速,同时保持视频质量

腾讯混元3D 2.0发布:开源高质量3D生成大模型与全流程创作引擎

腾讯发布混元3D 2.0,开源完整DiT模型并推出包含骨骼动画、草图转3D等多项创新功能的一站式3D创作引擎,为元宇宙与游戏内容创作带来革命性突破

ComfyUI项目两周年,并推出官方中文社区

ComfyUI迎来两周岁生日,从一个个人项目发展成为全球最受欢迎的生成式AI视觉工具,祝 ComfyUI 生日快乐

NVIDIA开源Sana - 高效生成4K图像的AI模型

NVIDIA推出全新的Sana模型,可在普通笔记本GPU上快速生成高达4K分辨率的图像,并已支持ComfyUI集成

字节跳动开源LatentSync - 基于扩散模型的高精度口型同步技术

字节跳动发布开源口型同步工具LatentSync,基于音频条件潜空间扩散模型,可实现真人和动画角色的精准口型同步,并解决了传统方法中的画面跳动问题

VMix:字节跳动推出创新的文生图扩散模型美学增强技术

字节跳动与中国科技大学联合推出VMix适配器,通过交叉注意力混合控制技术提升AI生成图像的美学质量,无需重新训练即可与现有模型完美集成

腾讯开源 StereoCrafter:一键将普通视频转为 3D 视频

腾讯 AI Lab 和 ARC Lab 联合开发的 StereoCrafter 模型现已开源,可将任何 2D 视频转换为高质量的立体 3D 视频,支持多种 3D 显示设备,包括 Apple Vision Pro

LuminaBrush: ControlNet作者推出AI光照编辑工具

ControlNet和IC-Light作者lllyasviel发布新作LuminaBrush,通过两阶段框架实现精确的光照效果控制,提供直观的笔刷交互体验

Genesis:突破性的通用物理引擎和生成式AI平台发布

Genesis 项目发布全新的通用物理引擎和生成式AI平台,集成了物理模拟、机器人控制和生成式AI能力,为机器人和物理AI应用提供全方位解决方案

Odyssey发布Explorer - 突破性的生成式世界模型

Odyssey推出首个生成式世界模型Explorer,可将2D图像转换为完整的3D世界,支持动态效果和主流创意工具编辑,将为电影、游戏等领域带来革命性变革

ComfyUI Impact-Pack插件被植入挖矿病毒,请尽快处理

ComfyUI社区知名插件Impact-Pack被发现通过Ultralytics包植入挖矿病毒,影响大量用户。本文详细介绍病毒情况及解决方案。

Luma发布全新AI图像生成模型Photon - 超高性价比的创意生成引擎

Luma推出革命性的Photon和Photon Flash图像生成模型,以超高性价比和卓越的图像质量重新定义AI创作领域

腾讯开源混元视频生成大模型HunyuanVideo - 开创视频生成新纪元

腾讯正式开源业界最大规模的视频生成大模型HunyuanVideo,拥有130亿参数量,在视频生成质量、运动稳定性等方面达到领先水平

Stability AI 发布 Stable Diffusion 3.5 Large ControlNet 模型

Stability AI 推出三个新的 ControlNet 模型用于 Stable Diffusion 3.5 Large,包括 Blur、Canny 和 Depth,为图像生成提供更精确的控制能力

NVIDIA发布Edify 3D - 革命性的3D资产生成技术

NVIDIA推出全新的Edify 3D技术,可在2分钟内生成高质量3D资产,包括详细几何形状、清晰拓扑、高分辨率纹理和PBR材质

Lightricks 发布实时视频生成模型 LTX-Video

Lightricks 推出基于 DiT 的实时视频生成模型 LTX-Video,支持实时速率生成高质量视频,并已在 GitHub 和 Hugging Face 开源发布。

InstantX 开源 FLUX.1-dev IP-Adapter 模型

InstantX 团队发布了基于 FLUX.1-dev 的 IP-Adapter 模型,为 FLUX 模型带来更强大的图像参考能力

FLUX官方工具套件重磅发布

Black Forest Labs发布多款FLUX官方工具,包括局部重绘、ControlNet和图像风格转换等功能

IC-Light V2 发布: 更强大的图像编辑能力

IC-Light V2 是一个基于 Flux 的图像编辑模型,支持多种风格化图像处理,包括油画和动漫风格。本文详细介绍了 IC-Light V2 的新特性和应用场景。

Stable Diffusion 3.5 发布:AI 图像生成的新时代

Stability AI 发布 Stable Diffusion 3.5,提供多个强大的模型变体,支持商业使用,在图像质量和提示词遵循方面领先市场。

ComfyUI V1 发布:一键安装的跨平台桌面应用

ComfyUI 发布了 V1 版本,提供了跨平台的一键安装桌面应用,全新的用户界面,以及多项功能改进,大大提升了用户体验。

快手与北大联合推出 Pyramidal Flow Matching 视频生成模型

快手科技与北京大学联合开发的 Pyramidal Flow Matching 模型,基于流匹配的自回归视频生成技术,能够生成高质量、长时间的视频内容。

Jasperai 发布 Flux.1-dev ControlNet 模型系列

Jasperai 推出适用于 Flux.1-dev 的 ControlNet 模型系列,包括表面法线、深度图和超分辨率模型,为 AI 图像生成提供更精确的控制。

ComfyUI-PuLID-Flux: PuLID-Flux在ComfyUI中的实现

ComfyUI-PuLID-Flux is an open-source project that integrates PuLID-Flux into ComfyUI, offering powerful image generation and editing capabilities.

Meta发布Movie Gen: AI视频音频生成模型

Meta introduces the Movie Gen series of models, including video generation, audio generation, and personalized video editing capabilities, opening new frontiers in AI content creation.

ostris发布OpenFLUX.1:FLUX.1-schnell的可商用去蒸馏版本

ostris has released OpenFLUX.1, a de-distilled version of the FLUX.1-schnell model that can be fine-tuned, uses normal CFG values, and retains commercial licensing.

黑森林实验室推出FLUX1.1 [pro]AI绘图模型

Black Forest Labs introduces FLUX1.1 [pro], a generative AI model featuring ultra-fast generation, superior image quality, and 2K ultra-high resolution generation, opening unprecedented opportunities for creators, developers, and businesses.

智谱 AI 开源图像生成新模型:CogView3 与 CogView-3Plus

智谱 AI 开源了最新的图像生成模型 CogView3 和 CogView-3Plus-3B,展现出卓越的性能和效率。CogView3 采用级联扩散技术,而 CogView-3Plus-3B 是基于 DiT 架构的轻量级模型,为文本到图像生成领域带来了重大突破。