OpenMOSS 发布 MOVA - 开源音视频同步生成模型

2026/01/29

字节跳动发布UNO:从少到多的生成能力扩展

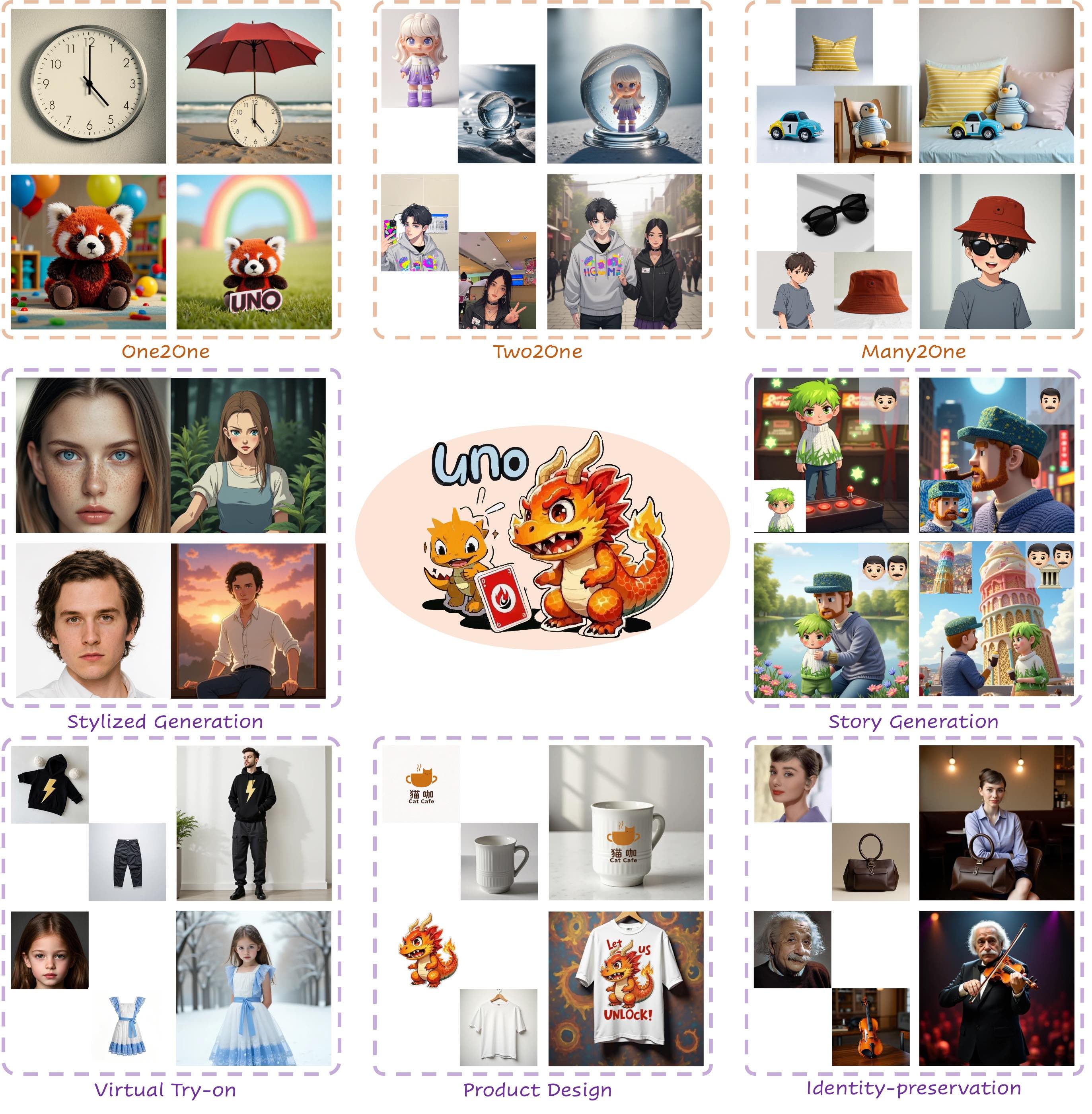

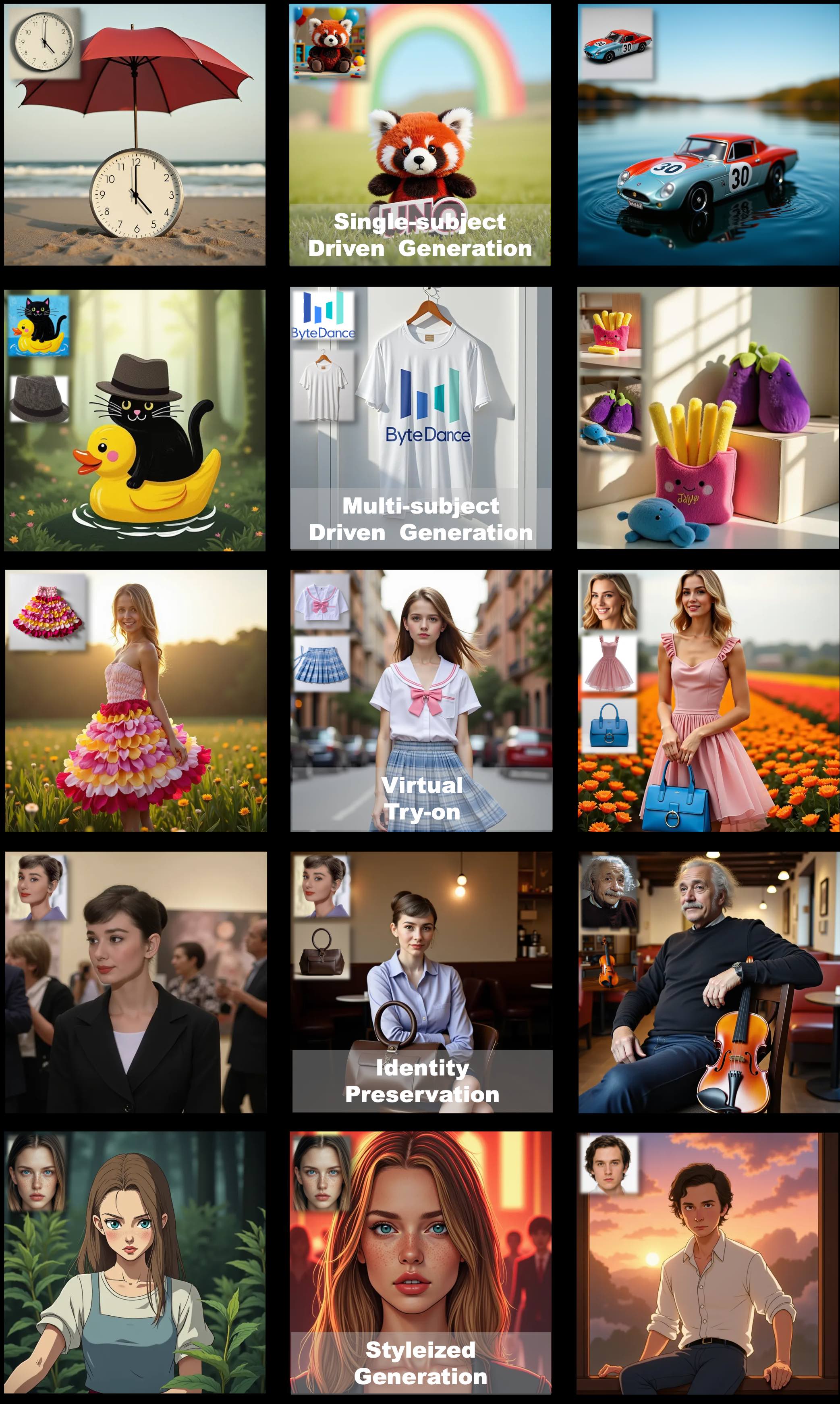

字节跳动智能创作团队近日发布了名为UNO的通用图像生成框架,该框架以”Less-to-More Generalization”(从少到多的泛化)为核心理念,通过上下文生成方式解锁更多可控性,实现从单主体到多主体的高质量图像生成。

UNO框架为内容创作者提供了更灵活且强大的工具,能够在保持多个物体特征的复杂场景中实现精确控制,让AI生成的图像更符合创作者的意图。

解决的关键问题

传统的AI图像生成模型在处理多个特定物体的场景时面临两大挑战:

- 数据可扩展性问题:从单主体数据集到多主体数据集的扩展特别困难,高质量的多角度且主体一致的配对数据难以大规模获取

- 主体扩展性问题:现有方法主要聚焦于单主体生成,难以适应多主体场景的复杂需求

UNO通过独特的方法解决了这些问题,实现了更一致、更可控的图像生成效果。

技术原理详解

UNO框架引入了两项关键技术创新:

-

渐进式跨模态对齐:分为两个阶段的训练策略

- 第一阶段:使用上下文生成的单主体数据微调预训练T2I模型,将其转变为S2I(Subject-to-Image)模型

- 第二阶段:继续使用生成的多主体数据对进行训练,提升模型处理复杂场景的能力

-

通用旋转位置嵌入(UnoPE):一种特殊的位置编码技术,有效解决在扩展视觉主体控制时出现的属性混淆问题,使模型能够准确区分和保持多个主体的特征

高一致性数据合成管道

UNO的一大创新是其高一致性数据合成管道:

- 利用扩散变换器的内在上下文生成能力:充分发挥当前扩散模型的潜力

- 生成高一致性的多主体配对数据:通过特定的数据生成策略,确保训练数据的质量和一致性

- 迭代训练流程:从文本到图像模型逐步演进到处理多图像条件的复杂模型

这种方法不仅解决了数据获取的难题,还提高了生成结果的质量和一致性。

实际应用场景

UNO模型展示了多样化的实用能力,可应用于:

- 多主体定制生成:将多个特定物体放置在同一场景中,保持各自特征

- 虚拟试穿和产品展示:在不同环境中展示特定产品或服务

- 品牌定制内容:将品牌元素融入各种场景,保持品牌一致性

- 创意设计和内容制作:为设计师和内容创作者提供更丰富的创作可能性

泛化能力展示

UNO模型展现了强大的泛化能力,能够统一处理多种任务:

- 单主体到多主体的迁移:从简单场景扩展到复杂场景

- 不同风格的适应:能够在保持主体特征的同时,适应不同的风格要求

- 多种创意任务的整合:一个模型处理原本需要多个专门模型才能完成的任务

在线体验

您可以通过以下界面亲自体验UNO的强大功能:

字节跳动UNO模型在线演示

技术参数与开源信息

UNO模型基于FLUX.1开发,由字节跳动团队开源,包括训练代码、推理代码和模型权重。

该项目已在GitHub上开源,研究人员和开发者可以自由获取和使用该技术。项目代码遵循Apache 2.0许可证,模型权重则使用CC BY-NC 4.0许可证发布。值得注意的是,与FLUX.1-dev基础模型相关的任何模型必须遵守原始许可条款。