OpenMOSS 发布 MOVA - 开源音视频同步生成模型

2026/01/29

Open-Sora 2.0发布:低成本实现商业级视频生成能力

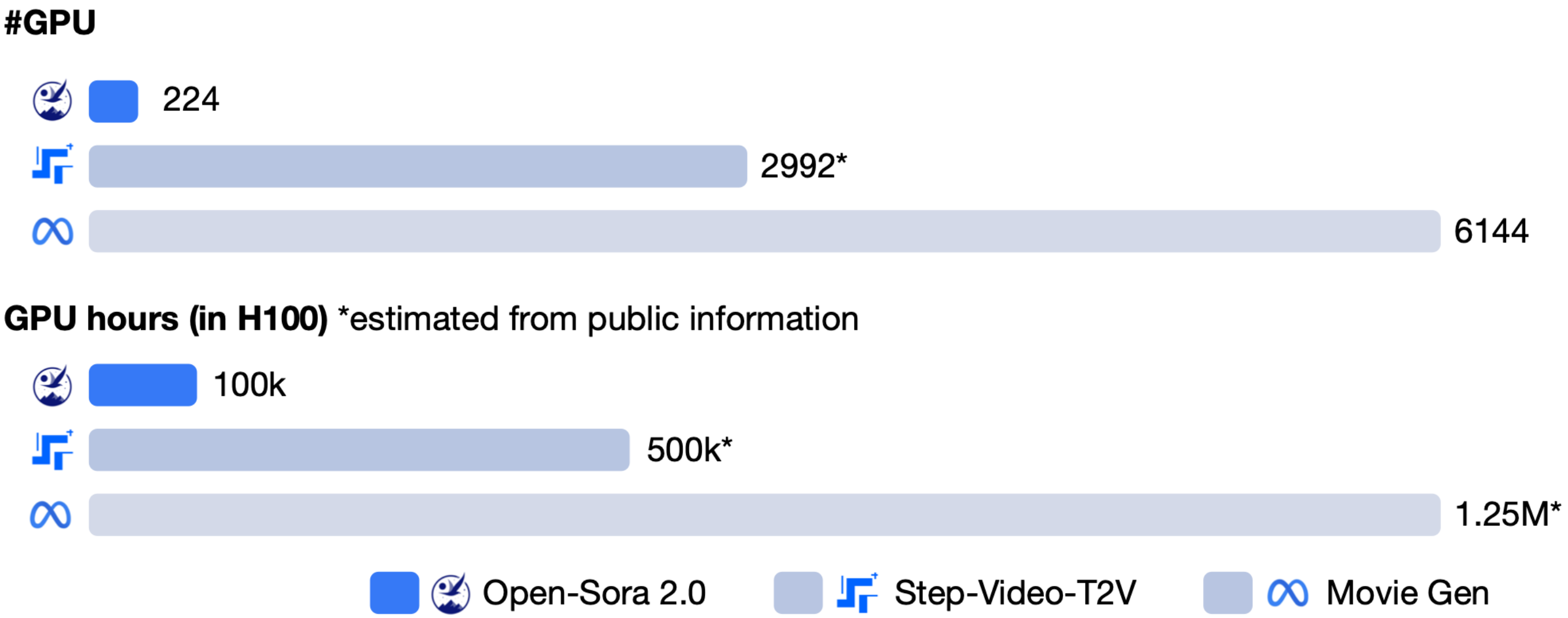

潞晨科技(ColossalAI团队)近日正式发布了Open-Sora 2.0,这是一款拥有110亿参数的开源视频生成模型,以其平衡成本与性能的特点引起业界广泛关注。该模型仅投入约20万美元(相当于224张GPU)的训练成本,却在多项评测中表现接近顶级商业模型。

视频演示

注:以上GIF为压缩格式,查看原始高质量视频请访问官方展示页面

性能表现

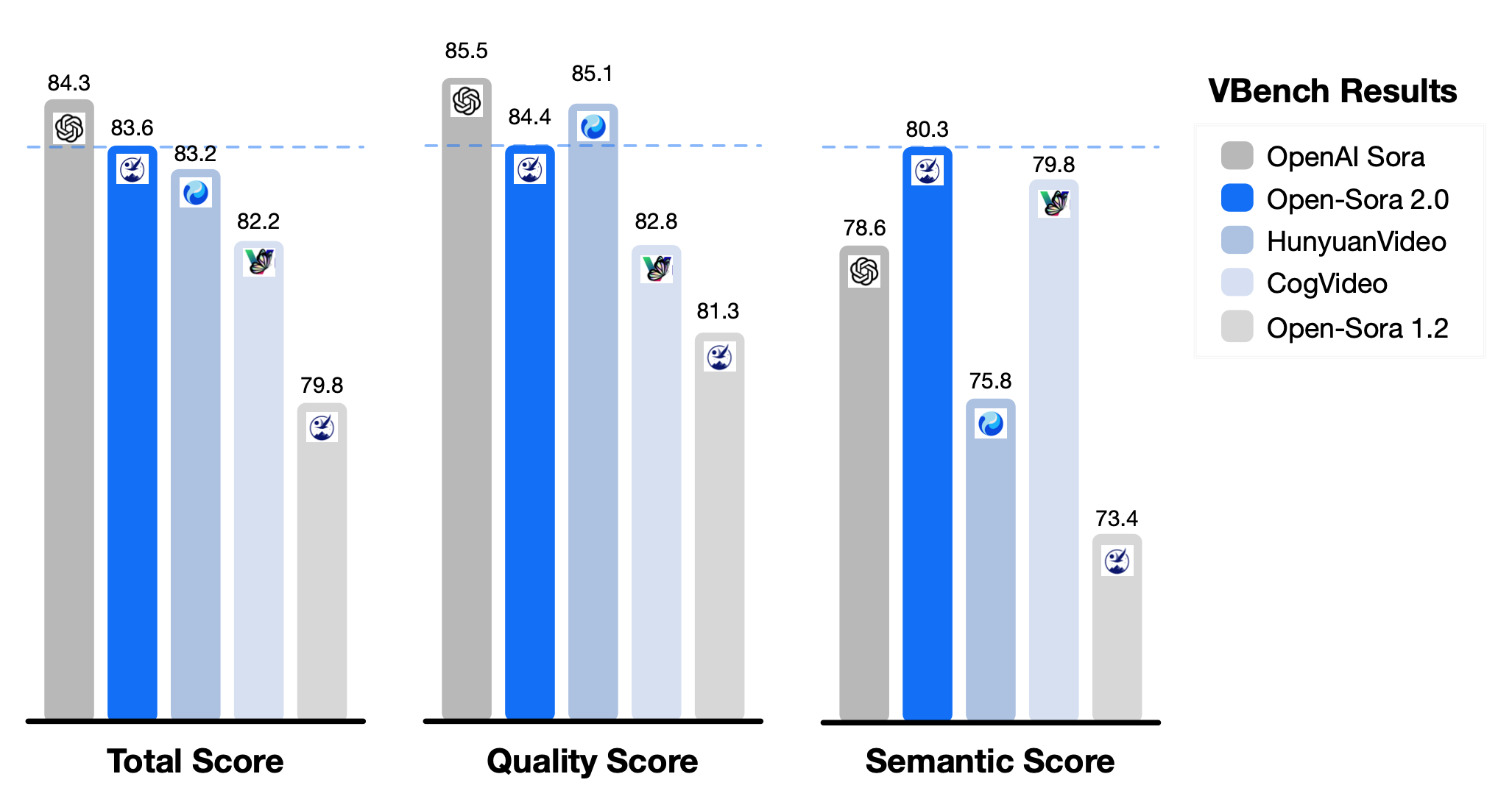

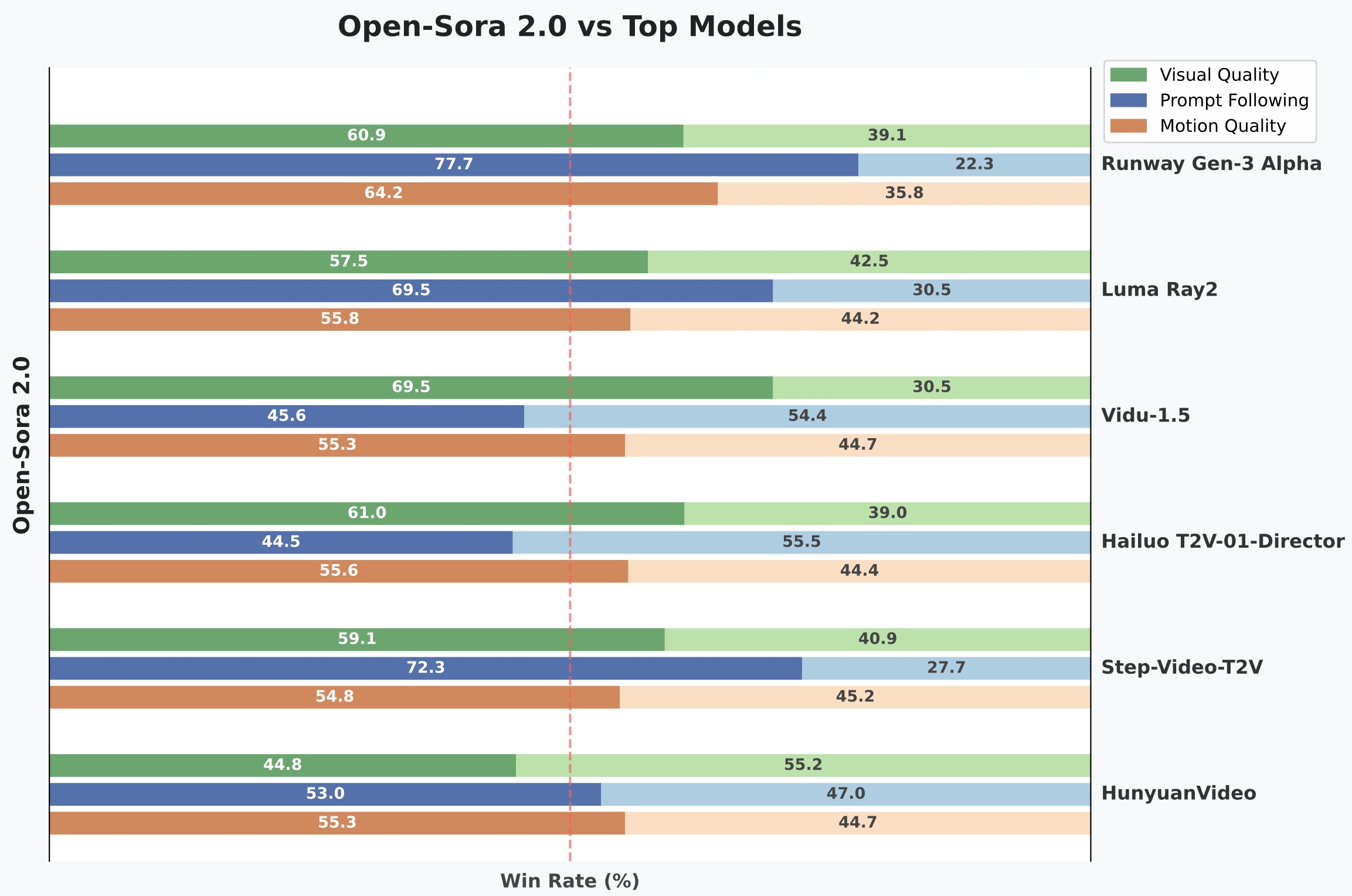

在权威的VBench评测中,Open-Sora 2.0与OpenAI Sora模型的性能差距从上一代的4.52%缩小到仅0.69%,几乎实现追平。用户偏好测试显示,该模型在视觉质量(69.5%胜率)、文本一致性(55.6%胜率)等指标上优于多款竞品,与腾讯HunyuanVideo(11B)和Step-Video(30B)等商业模型表现相当。

在VBench评测中的表现对比

用户偏好测试胜率对比

模型训练成本对比

技术创新

Open-Sora 2.0实现低成本高性能的背后,是一系列技术创新:

- 高效模型架构:采用3D全注意力机制与MMDiT架构(Masked Motion Diffusion Transformer),增强时空特征建模能力

- 低分辨率优先策略:先学习运动特征,再通过图生视频(T2I2V)提升画质,节省40倍计算资源

- 并行训练框架:借助ColossalAI并行框架,结合ZeroDP、Gradient Checkpointing等技术,GPU利用率达99%

- 高压缩自编码器:将768px视频生成时间从30分钟缩短至3分钟,速度提升10倍

开源生态价值

作为全栈开源项目,Open-Sora 2.0在GitHub公开了模型权重、训练代码(含数据预处理、分布式优化)和技术报告。模型支持多种应用场景:

- 影视预演:生成分镜脚本与特效原型

- 广告创意:快速制作多场景视频

- 教育科普:动态演示物理规律

- 游戏开发:自动生成NPC行为动画与场景过渡效果

该项目半年内论文引用量破百,吸引了包括英伟达在内的多家企业参与生态共建,为视频生成技术的普及提供了重要推动力。

实用功能与特性

Open-Sora 2.0具备丰富的实用功能:

多种分辨率与长宽比支持

支持256px和768px分辨率,能够处理16:9、9:16、1:1、2.39:1等不同长宽比的视频生成。

多种生成模式

- 文本生成视频:根据文字描述生成符合内容的视频

- 图像生成视频:将静态图像转化为具有动态效果的视频

- 动作强度控制:通过Motion Score参数(1-7分)调整视频中的运动幅度

动作分数从左到右分别为1分、4分、7分

高效推理

模型在高端GPU(如H100/H800)上能够高效运行:

- 256×256分辨率视频生成:单GPU仅需约60秒

- 768×768分辨率视频生成:8GPU并行可在约4.5分钟内完成

获取与使用

模型已在下列平台开放下载:

未来发展

潞晨科技团队表示,Open-Sora未来将继续提升:

- 支持4K分辨率、1分钟以上长视频生成

- 探索多模态能力(音频同步生成、跨模态编辑)

- 进一步降低训练与推理成本

这一突破性成果预计将显著降低视频内容创作门槛,推动AI视频工具在更广泛领域的应用。