Примеры моделей unCLIP

Модели unCLIP — это версии моделей Stable Diffusion, которые специально адаптированы для того, чтобы принимать в качестве входных данных не только текстовый запрос, но и концепции изображений. Изображения кодируются с помощью встроенного модуля CLIPVision, после чего извлечённые концепции передаются основной модели для генерации результата.

Это позволяет использовать изображения в вашем запросе.

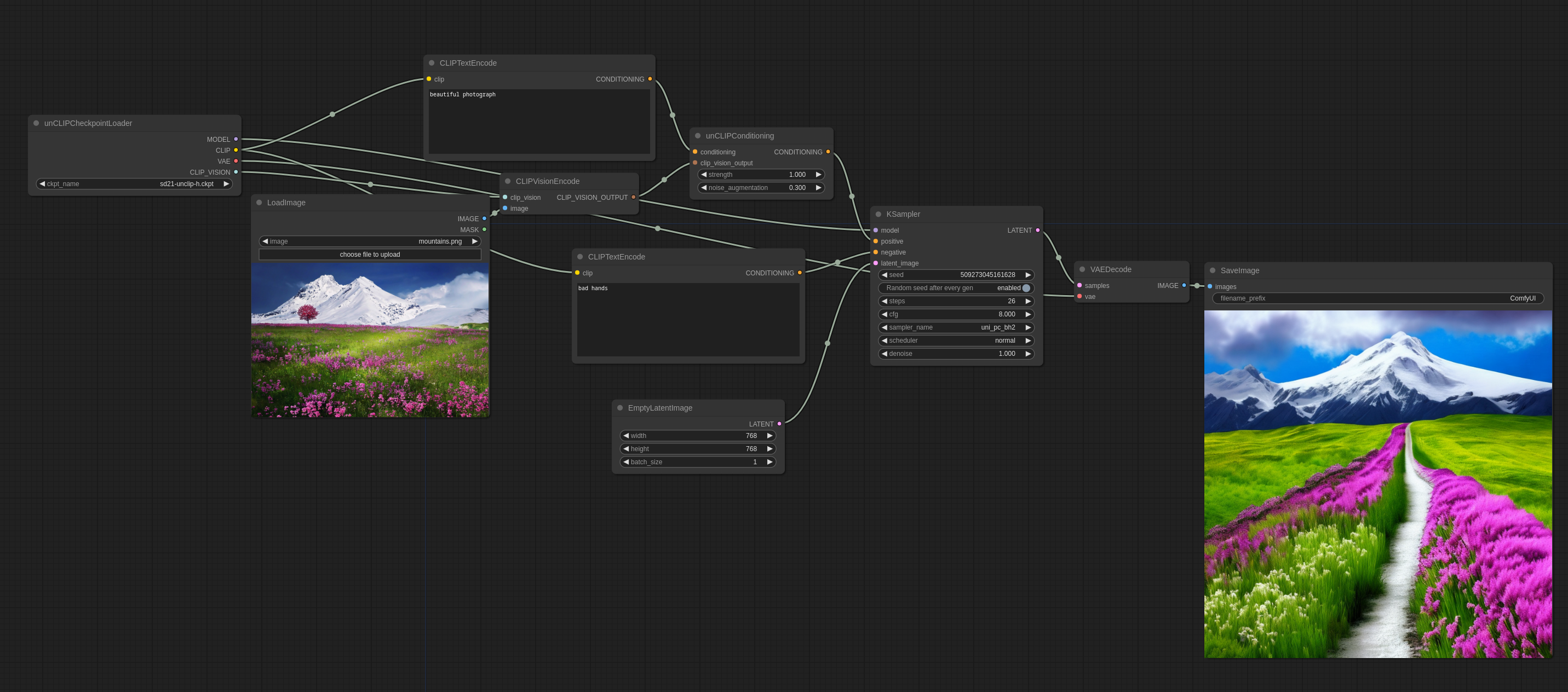

Вот как это можно использовать в ComfyUI (вы можете перетащить этот пример в ComfyUI, чтобы получить рабочий процесс):

Параметр noise_augmentation определяет, насколько точно модель будет следовать концепции изображения. Чем ниже значение, тем точнее результат будет соответствовать исходному изображению.

Параметр strength отвечает за силу влияния изображения на итоговый результат.

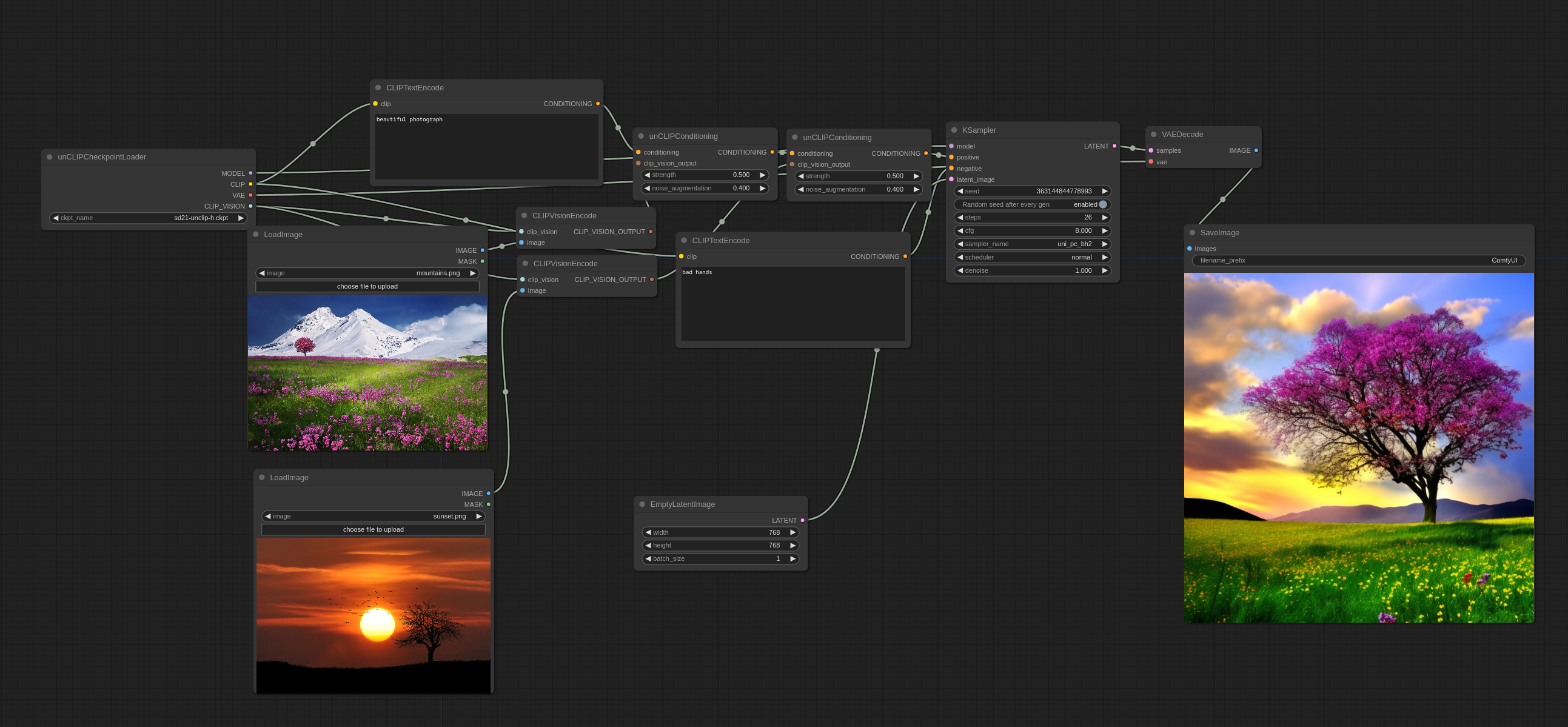

Можно использовать несколько изображений одновременно, например так:

Вы заметите, что изображения не просто смешиваются, а модель выбирает отдельные концепции из каждого и создает целостное изображение.

Входные изображения:

Официальные контрольные точки (checkpoints) unCLIP можно найти здесь

Некоторые контрольные точки unCLIP, которые были созданы на основе существующих 768-v моделей с помощью объединения, доступны здесь (на основе WD1.5 beta 2) и здесь (на основе illuminati Diffusion)

Более продвинутые рабочие процессы

Один из эффективных способов использования контрольных точек unCLIP — применять их на первом этапе двухшагового рабочего процесса (workflow), а затем переключаться на модель 1.x для второго этапа. Таким образом была сгенерирована следующая иллюстрация (вы также можете загрузить её в ComfyUI, чтобы получить рабочий процесс):