Open-Sora 2.0のリリース:低コストで商業レベルのビデオ生成能力を実現

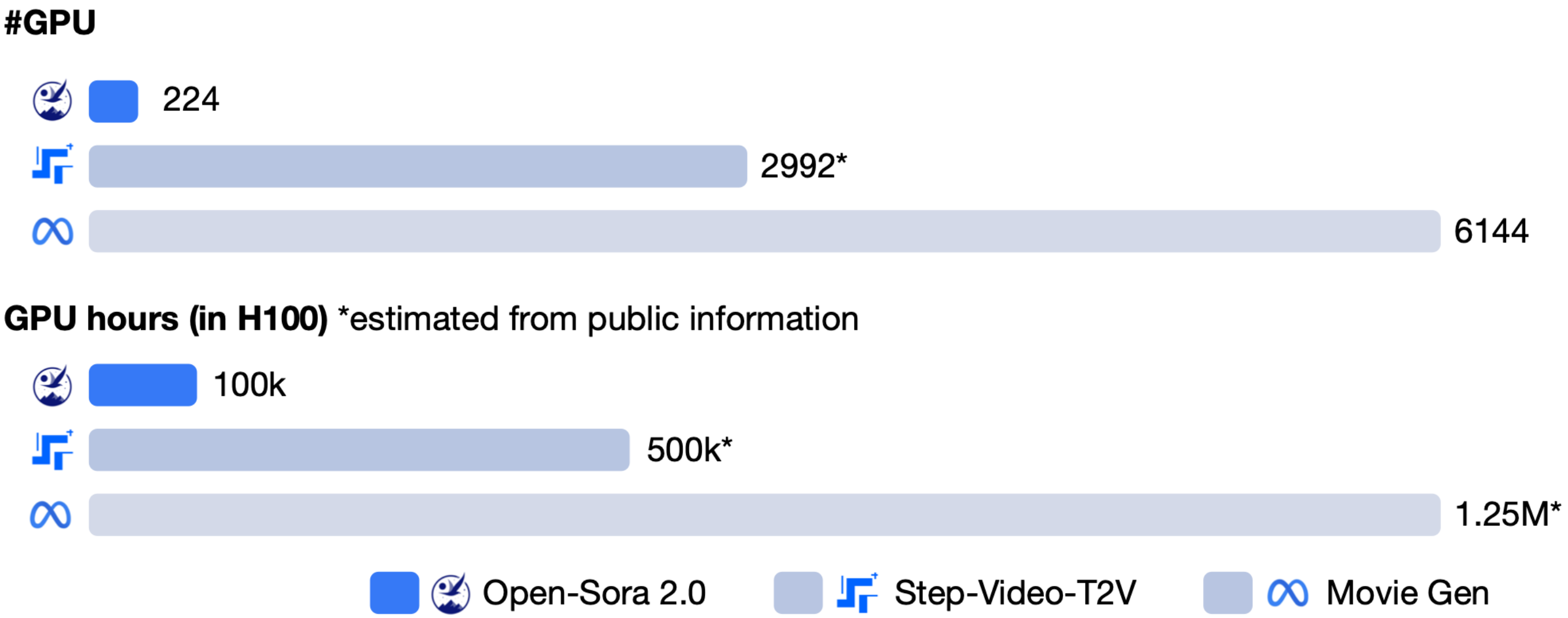

hpcaitech(ColossalAIチーム)は最近、Open-Sora 2.0を正式に発表しました。このモデルは110億のパラメータを持つオープンソースのビデオ生成モデルで、コストと性能のバランスが業界で広く注目されています。このモデルは約20万ドル(224台のGPUに相当)のトレーニングコストで、複数の評価でトップクラスの商業モデルに近い性能を示しました。

ビデオデモ

注:上記のGIFは圧縮形式です。元の高品質ビデオは公式展示ページをご覧ください。

性能評価

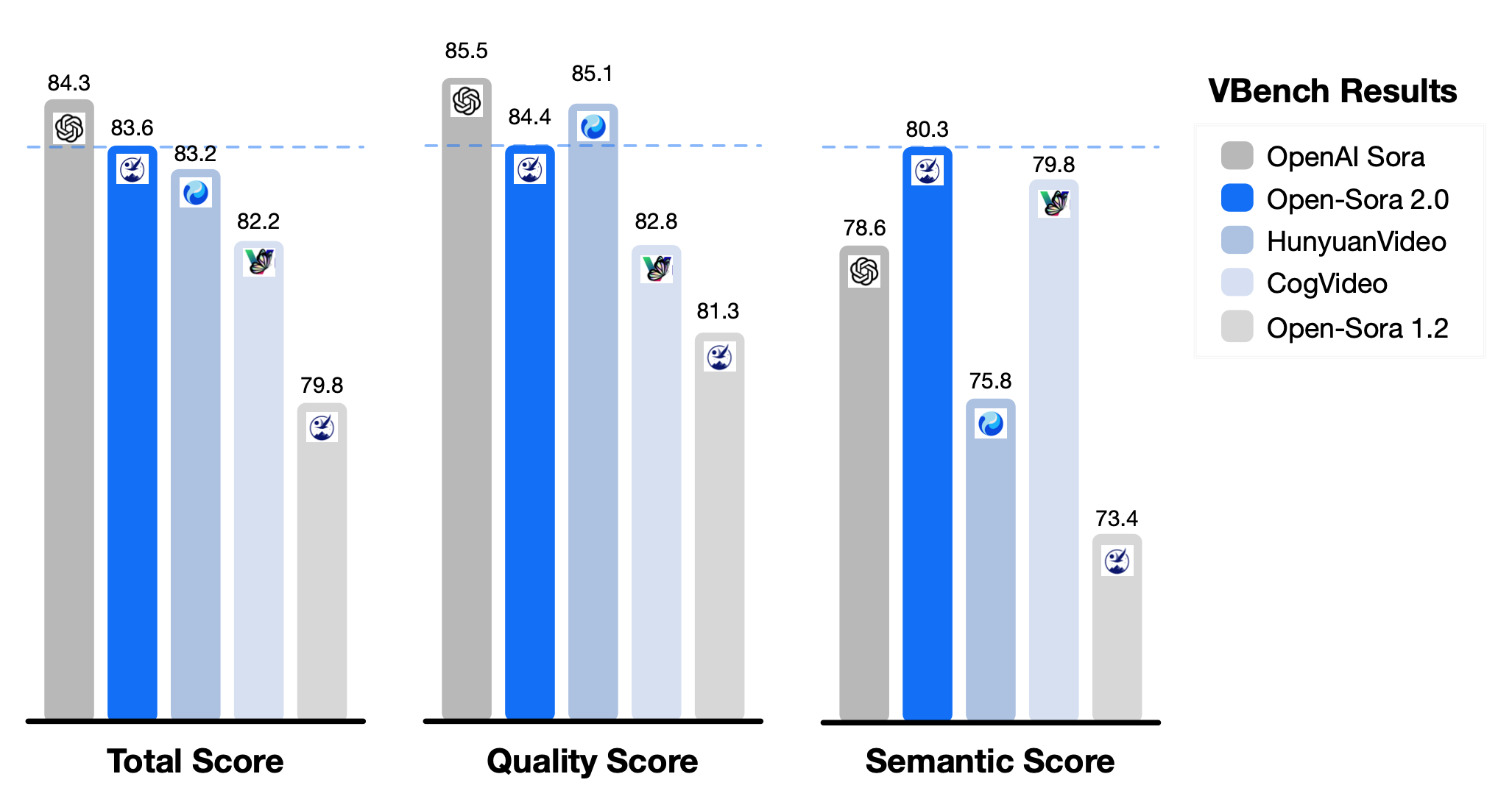

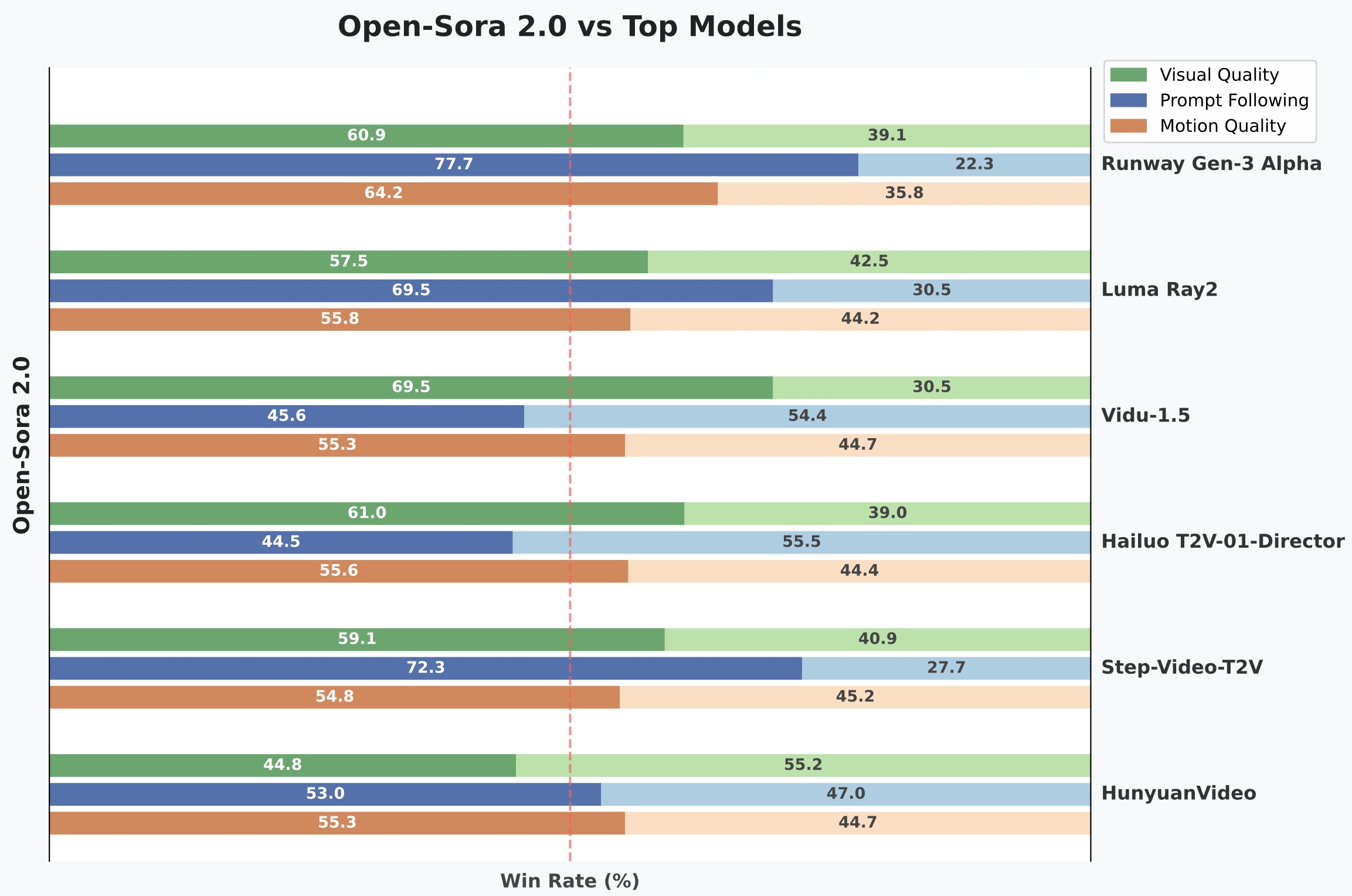

権威あるVBench評価において、Open-Sora 2.0はOpenAI Soraモデルとの性能差が前世代の4.52%からわずか0.69%に縮小し、ほぼ同等のレベルに達しました。ユーザーの好みテストでは、このモデルが視覚品質(69.5%の勝率)、テキストの一貫性(55.6%の勝率)などの指標で多くの競合製品を上回り、Tencent HunyuanVideo(11B)やStep-Video(30B)などの商業モデルと同等の性能を示しました。

VBench評価における性能比較

ユーザーの好みテスト勝率比較

モデルのトレーニングコスト比較

技術革新

Open-Sora 2.0の低コスト高性能の実現には、一連の技術革新が寄与しています:

- 効率的なモデルアーキテクチャ:3D全注意メカニズムとMMDiTアーキテクチャ(Masked Motion Diffusion Transformer)を採用し、時空間特性のモデリング能力を強化

- 低解像度優先戦略:まず運動特性を学習し、その後画像からビデオ(T2I2V)を通じて画質を向上させ、計算リソースを40倍節約

- 並列トレーニングフレームワーク:ColossalAIの並列フレームワークを活用し、ZeroDP、Gradient Checkpointingなどの技術を組み合わせてGPU利用率を99%に向上

- 高圧縮自己エンコーダ:768pxビデオ生成時間を30分から3分に短縮し、速度を10倍向上

オープンソースエコシステムの価値

全栈オープンソースプロジェクトとして、Open-Sora 2.0はGitHubでモデルの重み、トレーニングコード(データ前処理や分散最適化を含む)、技術報告書を公開しています。このモデルはさまざまなアプリケーションシーンをサポートします:

- 映画の予演:ストーリーボードスクリプトや特殊効果のプロトタイプを生成

- 広告の創造性:さまざまなシーンのビデオを迅速に制作

- 教育と科学:物理法則の動的なデモンストレーション

- ゲーム開発:NPCの行動アニメーションやシーン遷移効果を自動生成

このプロジェクトは半年以内に論文の引用数が100を超え、NVIDIAを含む多くの企業がエコシステムの共同構築に参加し、ビデオ生成技術の普及に重要な貢献をしています。

実用的な機能と特性

Open-Sora 2.0は多くの実用的な機能を備えています:

多様な解像度とアスペクト比のサポート

256pxおよび768pxの解像度をサポートし、16:9、9:16、1:1、2.39:1などの異なるアスペクト比のビデオ生成を処理できます。

多様な生成モード

- テキストからビデオ生成:テキストの説明に基づいて内容に合ったビデオを生成

- 画像からビデオ生成:静的画像を動的効果のあるビデオに変換

- 動作強度の制御:Motion Scoreパラメータ(1-7点)を通じてビデオ内の動作の強度を調整

動作スコアは左から右にそれぞれ1点、4点、7点です。

効率的な推論

モデルは高性能GPU(H100/H800など)で効率的に動作します:

- 256×256解像度のビデオ生成:単一GPUで約60秒

- 768×768解像度のビデオ生成:8GPUの並列処理で約4.5分で完了

入手と使用

モデルは以下のプラットフォームでダウンロード可能です:

今後の展望

hpcaitechチームは、Open-Soraが今後も進化し続けると述べています:

- 4K解像度および1分以上の長いビデオ生成のサポート

- マルチモーダル能力の探求(音声同期生成、クロスモーダル編集)

- トレーニングおよび推論コストのさらなる削減

この成果は、ビデオコンテンツ制作のハードルを大幅に下げ、AIビデオツールのより広範な分野での適用を促進することが期待されています。