FlexiAct: Гибкий контроль действий в гетерогенных сценариях

Исследовательская команда из Университета Цинхуа и Tencent ARC Lab недавно выпустила FlexiAct, новую технологию, которая может переносить действия из референсного видео на любое целевое изображение, сохраняя хорошие результаты даже когда макет, точка зрения и скелетная структура различаются. Эта технология была принята SIGGRAPH 2025.

Технический фон

Настройка действий относится к генерации видео, где субъект выполняет действия, диктуемые входными контрольными сигналами. Текущие методы в основном используют настройку, управляемую позой или глобальную настройку движения, но строго ограничены пространственной структурой (такой как согласованность макета, скелета и точки зрения), что затрудняет адаптацию к различным субъектам и сценариям.

Техническая инновация

FlexiAct преодолевает ограничения существующих технологий для достижения:

- Точного контроля действий

- Адаптации пространственной структуры

- Сохранения согласованности идентичности

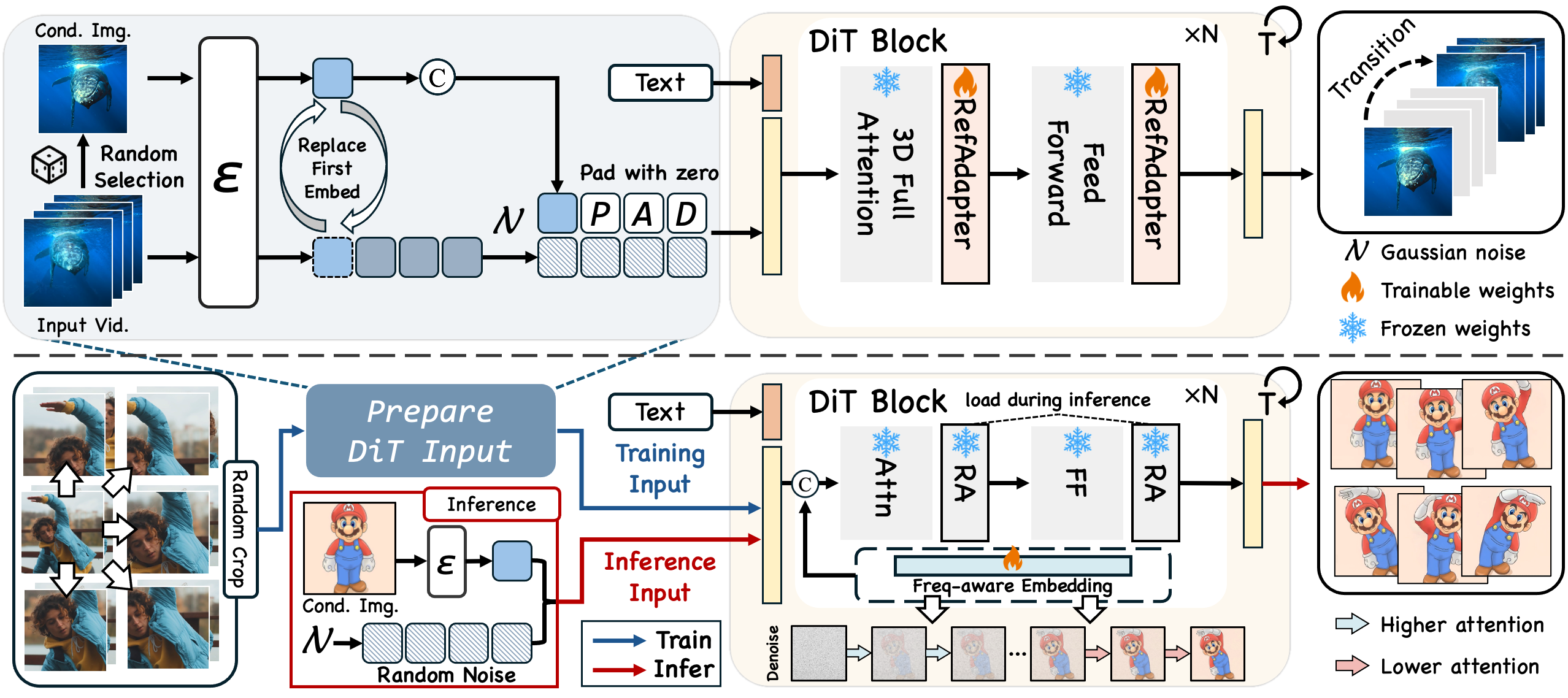

Технология построена вокруг двух ключевых компонентов:

-

RefAdapter: Легковесный адаптер с условием изображения, который превосходит в пространственной адаптации и сохранении согласованности, балансируя согласованность внешности и структурную гибкость.

-

FAE (Frequency-aware Action Extraction): Основываясь на наблюдениях исследовательской команды, процесс деноизинга демонстрирует различные уровни внимания к движению (низкая частота) и деталям внешности (высокая частота) на различных временных шагах. FAE достигает извлечения действий напрямую во время процесса деноизинга, не полагаясь на отдельные пространственно-временные архитектуры.

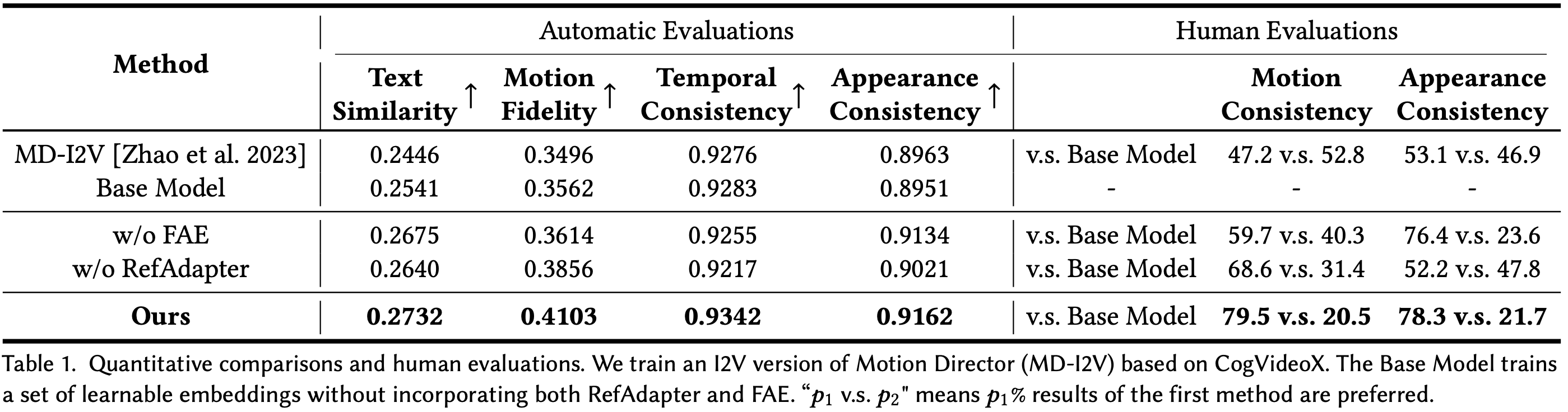

По сравнению с существующими методами, FlexiAct демонстрирует значительные преимущества производительности в гетерогенных сценариях:

Сценарии применения

FlexiAct может широко применяться в различных сценариях:

- Перенос человеческих действий: Перенос человеческих действий на игровых персонажей или мультипликационные фигуры

- Генерация анимации животных: Добавление динамических действий к изображениям животных

- Динамические эффекты камеры: Создание динамических эффектов под различными перспективами камеры

- Кросс-доменная миграция действий: Реализация миграции действий между различными видами, такими как применение человеческих действий к животным

Данные и модели

Исследовательская команда построила специализированный набор данных для этой работы, включая различные типы действий:

- Человеческие действия: Ходьба, приседание, прыжки и т.д.

- Действия животных: Бег, прыжки, стояние и т.д.

- Действия камеры: Движение вперед, вращение, увеличение и т.д.

FlexiAct разработан на основе модели CogVideoX-5B, достигая высококачественных эффектов переноса действий.

Ресурсы с открытым исходным кодом

Исследовательская команда открыла исходный код связанных ресурсов, включая:

- Предобученные модели FlexiAct (на основе CogVideoX-5B)

- Наборы данных для обучения и тестирования

- Код для обучения и вывода

- Подробные инструкции и примеры

Планы на будущее

Согласно журналу обновлений проекта, исследовательская команда планирует:

- Выпустить код обучения и вывода

- Выпустить чекпоинты FlexiAct (на основе CogVideoX-5B)

- Выпустить обучающие данные

- Выпустить демо Gradio