ByteDance、USOをリリース:統一されたスタイルと主体駆動型の画像生成モデル

ByteDanceのインテリジェント・クリエイション・ラボUXOチームは、USO(Unified Style and Subject-Driven Generation)モデルを発表しました。これは統一されたスタイルと主体最適化のカスタマイズ生成モデルです。USOは任意の主体と任意のスタイルを自由に組み合わせ、主体の一貫性を維持しながら高品質なスタイル転送効果を実現できます。

モデルの特徴

USOモデルは、既存技術におけるスタイル駆動型と主体駆動型の生成タスクが相互に対立する問題を解決しました。従来の方法では、これらの2つのタスクを独立したタスクとして扱うことが多く、スタイル駆動型生成はスタイルの類似性を優先し、主体駆動型生成は主体の一貫性を強調するため、両者の間に明らかな対抗関係が存在していました。

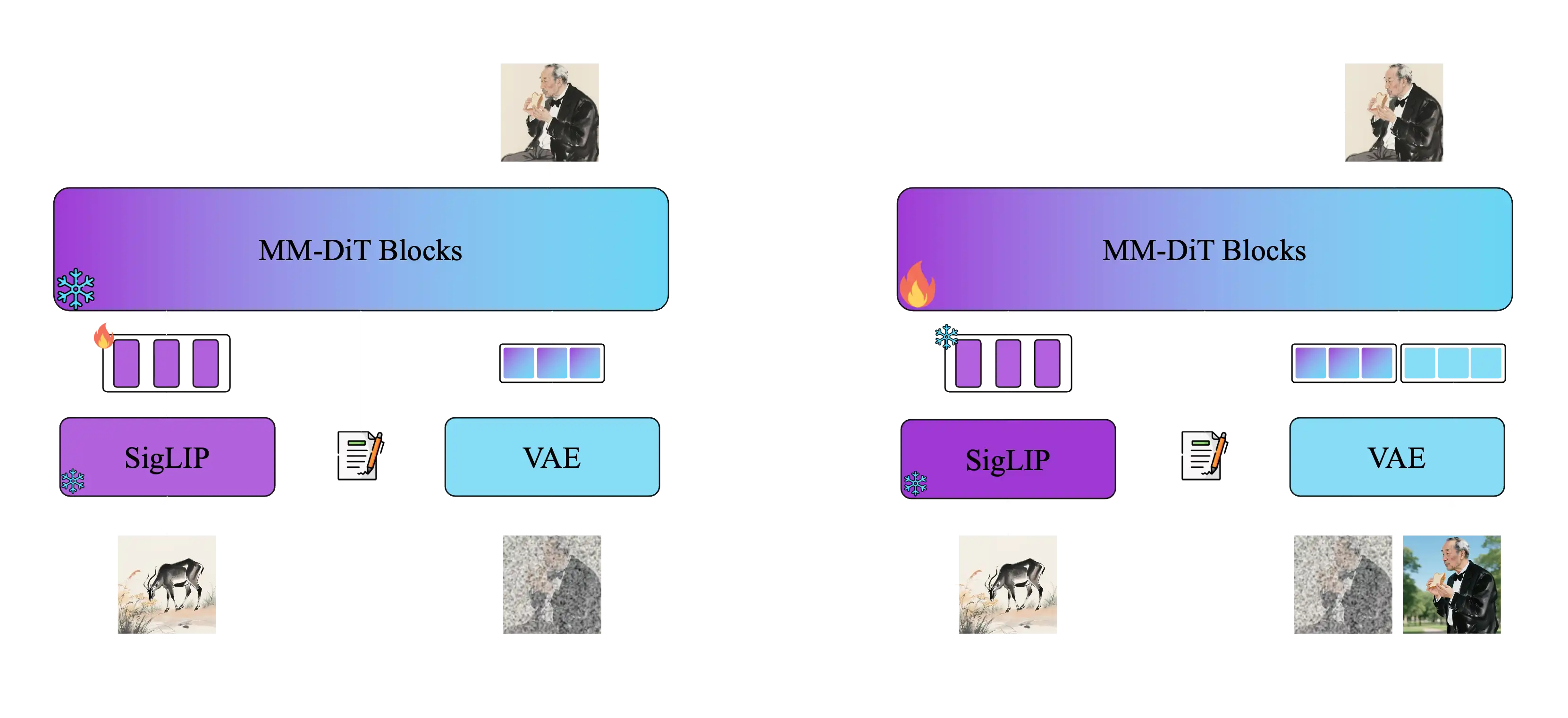

USOは統一フレームワークを通じてこの問題を解決し、コンテンツとスタイルの分離と再構成を核心目標としています。このモデルは2段階のトレーニング方法を採用しています:

第1段階:スタイルアラインメントトレーニングを通じてSigLIP埋め込みをアラインメントし、スタイル能力を備えたモデルを取得 第2段階:条件エンコーダをデカップリングし、トリプレットデータ上でトレーニングして、結合条件生成を実現

コア機能

USOモデルは複数の生成モードをサポートし、任意の主体と任意のスタイルを自由に組み合わせることができます:

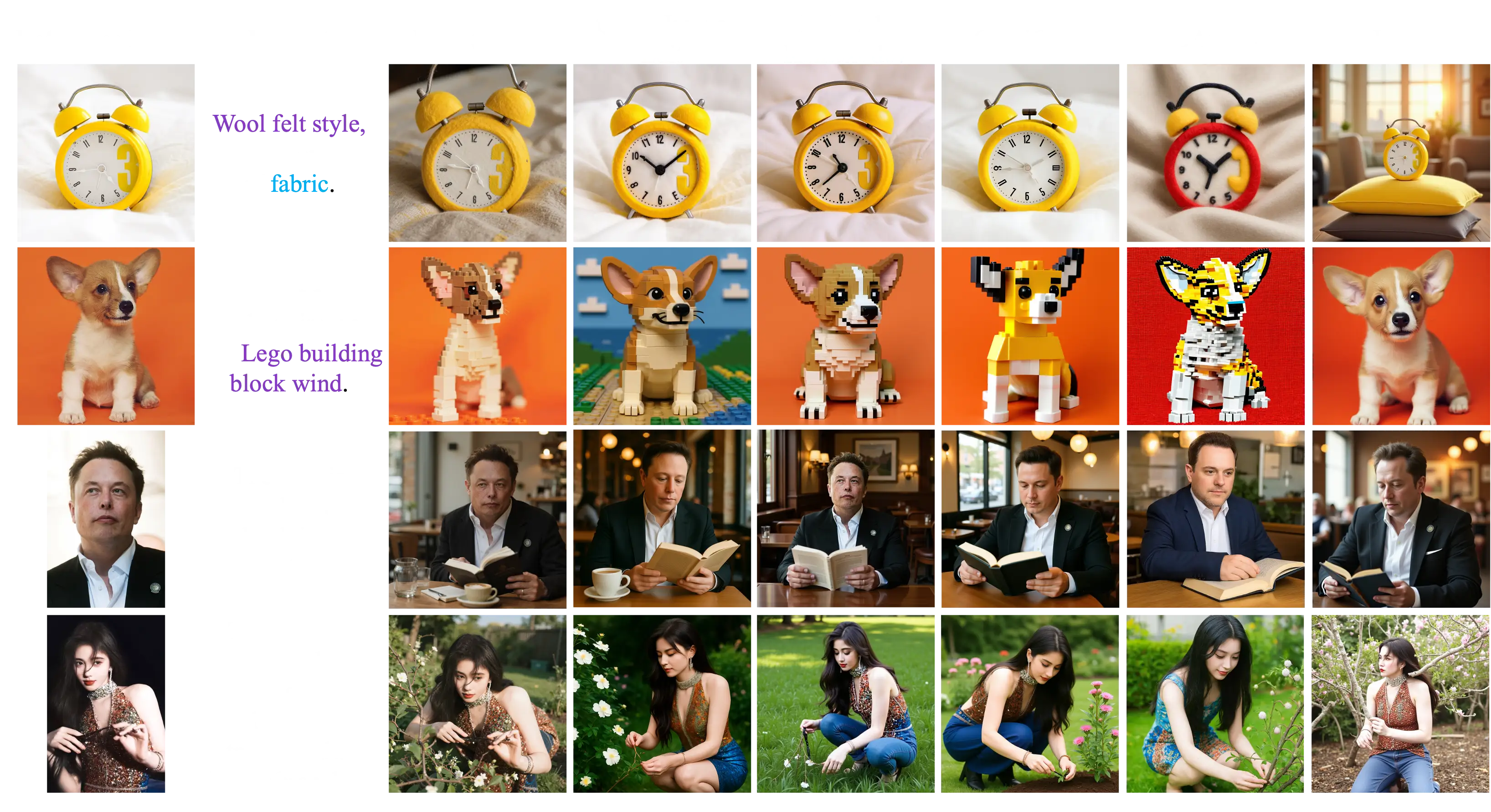

主体駆動型生成

主体のアイデンティティ一貫性を維持し、人物、物体などの特定主体のスタイル化に適しています。ユーザーは特定主体を含む参照画像を提供でき、モデルはその主体のアイデンティティ特徴を維持しながら、新しいスタイルやシーンを適用します。

アイデンティティ駆動型生成

アイデンティティ特徴を維持しながらスタイル化処理を行います。このモードは特に人物肖像のスタイル化に適しており、顔部特徴、表情、アイデンティティ情報を維持しながら、芸術スタイル、服装、背景環境を変更できます。

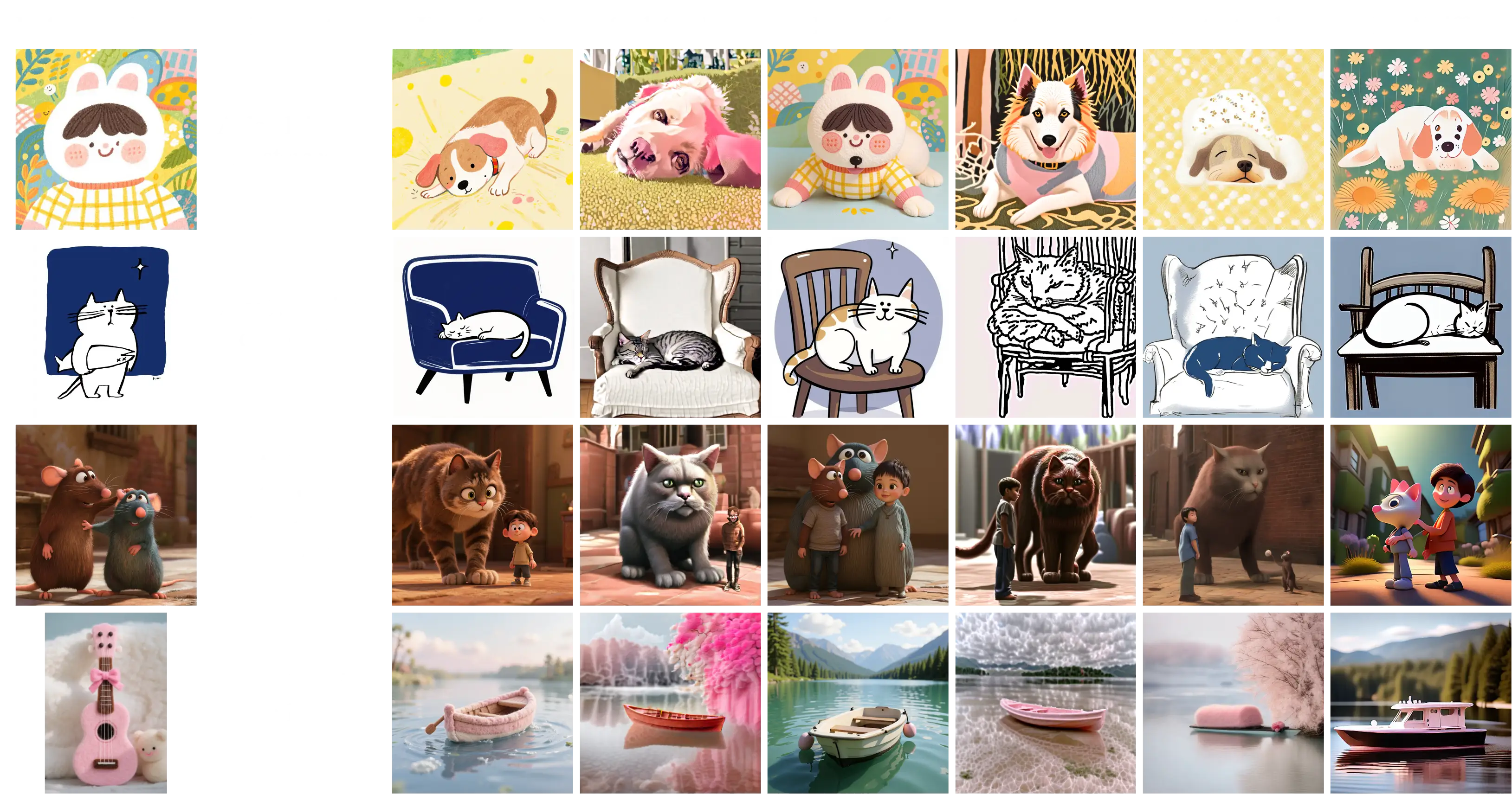

スタイル駆動型生成

高品質なスタイル転送を実現し、参照画像のスタイルを新しいコンテンツに適用します。ユーザーはスタイル参照画像を提供でき、モデルはこの芸術スタイルをテキスト記述のコンテンツに適用し、特定のスタイルを持つ新しい画像を作成します。

マルチスタイル混合生成

複数スタイルの融合適用をサポートします。ユーザーは同時に複数の異なるスタイルの参照画像を提供でき、モデルはこれらのスタイル要素を融合して、独自の混合スタイル効果を作成します。

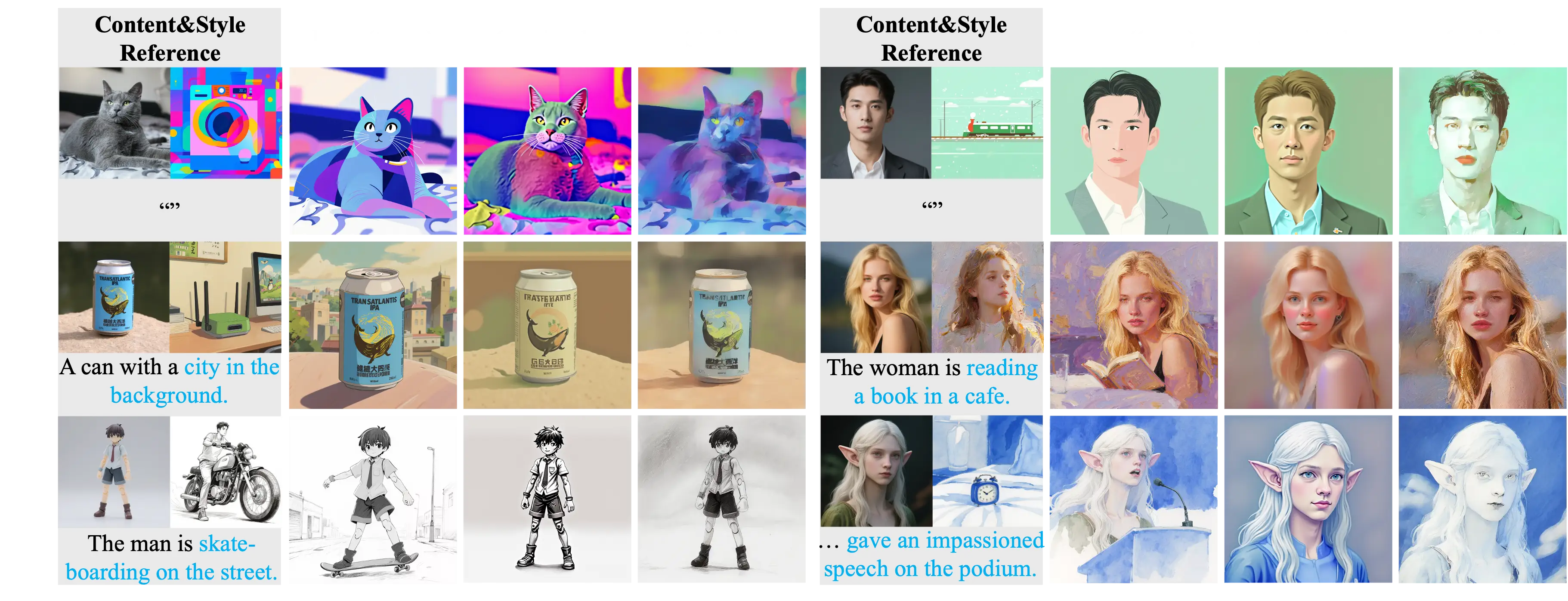

スタイル主体結合生成

主体とスタイルを同時に制御し、複雑なクリエイティブ表現を実現します。このモードは主体駆動とスタイル駆動の利点を結合し、ユーザーは特定の主体を指定し、芸術スタイルを制御して、より正確なクリエイティブコントロールを実現できます。

動作原理

USOは2段階のトレーニング方法を採用しています。第1段階ではスタイルアラインメントトレーニングを通じてSigLIP埋め込みをアラインメントし、スタイル能力を備えたモデルを取得します。第2段階では条件エンコーダをデカップリングし、トリプレットデータ上でトレーニングして、結合条件生成を実現します。最後にスタイル報酬学習パラダイムを通じて2つの段階を監督し、より強力な統一モデルを得ます。

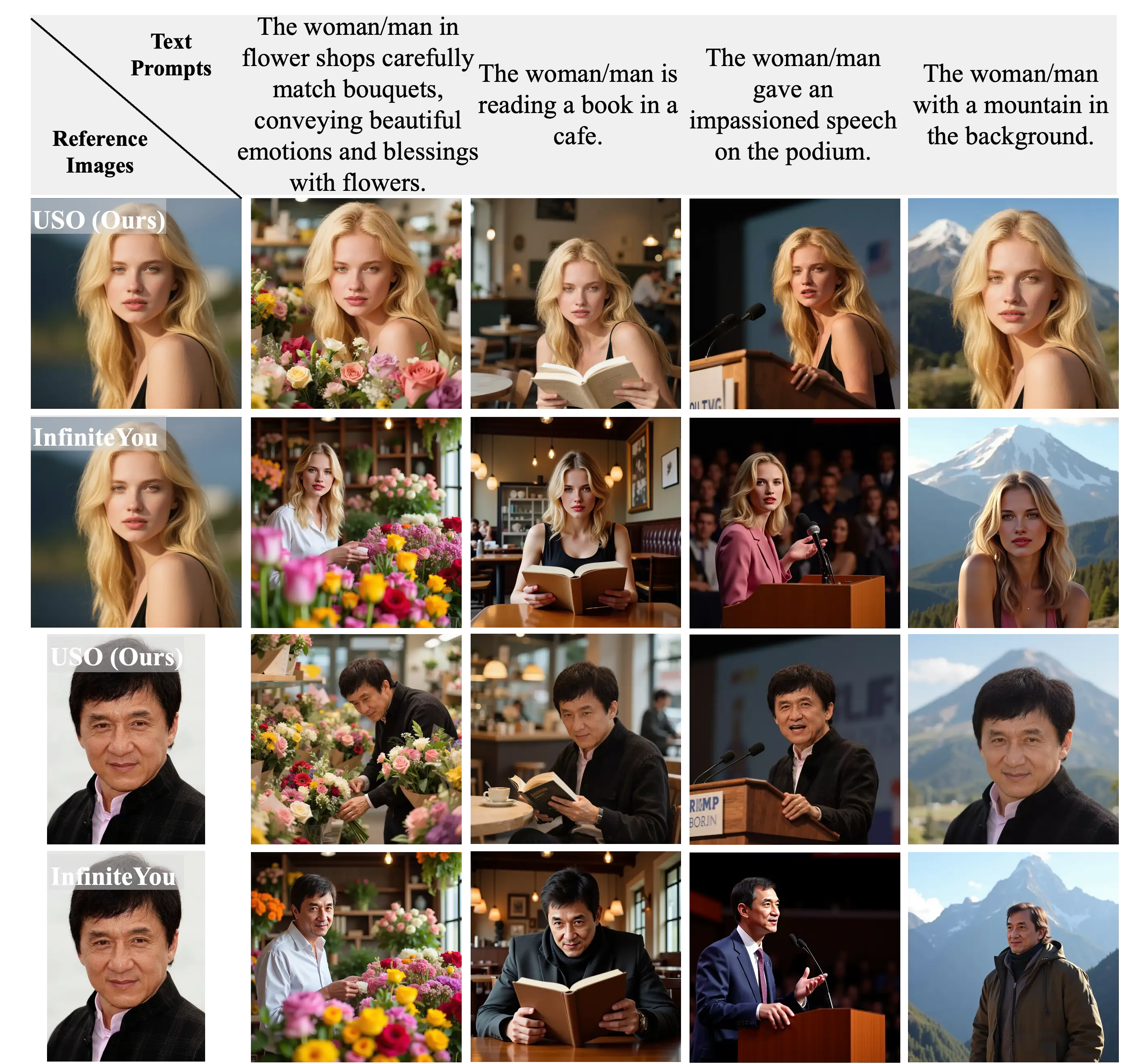

他の方法との比較

主体駆動型生成比較

スタイル駆動型生成比較

アイデンティティ駆動型生成比較

スタイル主体結合生成比較

データセットとトレーニング

研究チームは大規模なトリプレットデータセットを構築しました。これにはコンテンツ画像、スタイル画像、およびそれに対応するスタイル化されたコンテンツ画像が含まれます。デカップリング学習スキームを通じて、モデルはスタイルアラインメントとコンテンツスタイルのデカップリングという2つの目標を同時に処理できます。

性能表現

実験結果は、USOがオープンソースモデルの中で主体一貫性とスタイル類似性の2つの次元において最高の性能を実現したことを示しています。モデルは自然でプラスチック感のない人像を生成しながら、高主体一貫性と強スタイル忠実度を維持できます。

研究チームはまた、USO-Benchベンチマークをリリースしました。これはスタイル類似性と主体忠実度を同時に評価する初のマルチ指標ベンチマークであり、関連研究に標準化された評価ツールを提供します。

オープンソースと使用

プロジェクトアドレス:

USOのリリースは、AI画像生成分野に新しいソリューションをもたらし、特にスタイル転送と主体維持のバランスにおいて。このモデルのオープンソース化は関連研究の発展を促進し、オープンソースコミュニティに強力なツールサポートを提供します。