OpenMOSS lanza MOVA - modelo de generación sincronizada de video y audio de código abierto

29/01/2026

VAST AI Research libera como código abierto TripoSF: Redefiniendo nuevas alturas en tecnología de generación 3D

La empresa líder en tecnología de generación 3D, VAST AI Research, anunció recientemente la liberación como código abierto de su último modelo fundamental, TripoSF. Esta tecnología revolucionaria, centrada en la innovadora representación SparseFlex, establece un nuevo punto de referencia en la generación de modelos 3D de alta resolución, soportando modelado fino con resoluciones de hasta 1024³ y manejando tanto superficies abiertas como estructuras internas complejas, logrando verdaderamente una superioridad integral sobre el rendimiento de los modelos de generación 3D existentes.

Aspectos técnicos destacados de TripoSF

Representación SparseFlex: Desbloqueando la generación de detalles y estructuras complejas

TripoSF se basa en el nuevo método de representación 3D SparseFlex, que optimiza el uso de memoria mediante estructuras de vóxeles dispersos, soportando precisión de modelado con resoluciones de hasta 1024³. Esta tecnología solo necesita almacenar información de vóxeles cerca de las superficies de los objetos, siendo capaz de capturar texturas externas (como estructuras de tela de una sola cara) mientras genera detalles internos (como asientos y estructuras mecánicas de cabinas), terminando completamente con la era de modelos burdos “tipo masa” tradicionalmente generados por IA.

Estrategia de entrenamiento consciente del frustum de visión: Avance en eficiencia y precisión

Inspirándose en técnicas de recorte de frustum de visión en renderizado en tiempo real, TripoSF solo activa los vóxeles dentro de la vista de la cámara durante el entrenamiento, reduciendo significativamente la sobrecarga computacional. Los datos experimentales muestran que sus modelos generados logran una reducción del 82% en la Distancia Chamfer y una mejora del 88% en la puntuación F, con precisión de detalles y realismo alcanzando nuevos puntos de referencia en la industria.

Soporte de topología dinámica y ecosistema abierto

TripoSF soporta nativamente estructuras topológicas arbitrarias, capaz de manejar superficies abiertas (como telas y hojas) y sólidos cerrados, siendo compatible con procesos de optimización directa basados en pérdidas de renderizado. El contenido de código abierto incluye modelos pre-entrenados VAE, código de inferencia y demostraciones interactivas, permitiendo a los desarrolladores experimentarlo rápidamente a través de las plataformas GitHub y HuggingFace.

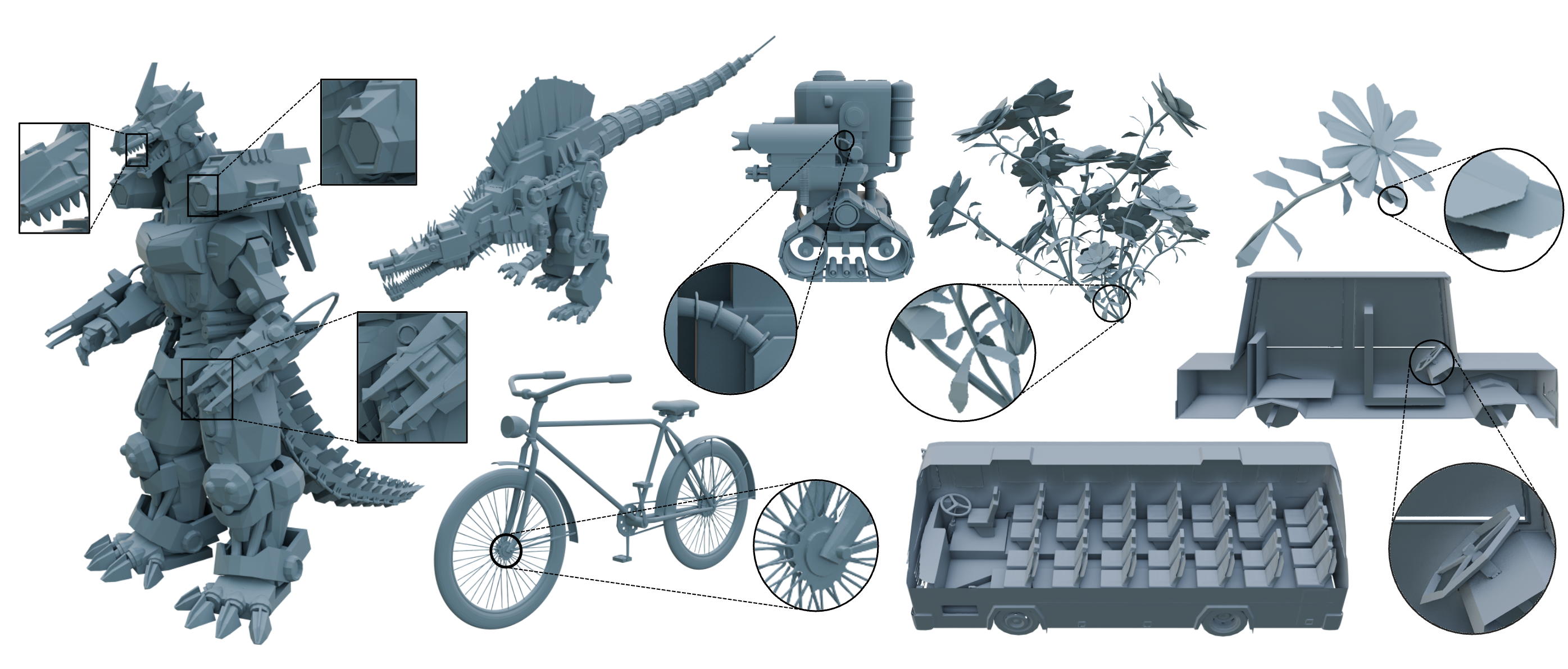

Demostración de efectos

Innovación revolucionaria: Ventajas clave más allá de los métodos de generación 3D existentes

En términos de calidad de resultados, TripoSF redefine el “límite superior de calidad del modelo”:

- Vista completa y estructura interna: Por primera vez, los modelos no solo pueden capturar detalles traseros sino también presentar con precisión estructuras internas (como asientos de autobús y cabinas de conductor)

- Manejo de superficies abiertas: Mientras que las tecnologías anteriores solo podían crear estructuras geométricas con grosor al generar ropa o pétalos, TripoSF puede presentar naturalmente verdaderos “activos de una sola cara”

- Riqueza de detalles sin precedentes: En diversos tipos de modelos, los detalles geométricos y la precisión de textura que genera alcanzan niveles sin precedentes

Escenarios de aplicación e impacto en la industria

- Producción de cine y videojuegos: Directores y diseñadores pueden generar rápidamente escenas y personajes 3D de alta fidelidad mediante texto o bocetos, acortando enormemente el ciclo creativo

- Impresión 3D y fabricación: Se reduce el umbral de diseño para piezas mecánicas complejas y productos personalizados, permitiendo a personas comunes realizar “lo que piensas es lo que obtienes”

- Investigación académica: El código abierto y los pesos del modelo proporcionan nuevos puntos de referencia para el campo de generación 3D, impulsando la innovación en algoritmos subyacentes

Enlaces de experiencia de participación y recursos

Requisitos técnicos

- GPU compatible con CUDA (≥12GB VRAM para resolución 1024³)

- PyTorch 2.0+

- Consulte la documentación del repositorio GitHub para métodos detallados de instalación y uso