title: “FlexiAct : Contrôle Flexible des Actions dans des Scénarios Hétérogènes” description: “FlexiAct, développé conjointement par l’Université Tsinghua et le Laboratoire ARC de Tencent, peut transférer des actions d’une vidéo de référence à n’importe quelle image cible tout en maintenant la cohérence d’identité” tag: AI, video-generation, action-control, image-to-video date: 2025-05-08

FlexiAct : Contrôle Flexible des Actions dans des Scénarios Hétérogènes

Une équipe de recherche de l’Université Tsinghua et du Laboratoire ARC de Tencent a récemment publié FlexiAct, une nouvelle technologie capable de transférer des actions d’une vidéo de référence à n’importe quelle image cible, en maintenant de bons résultats même lorsque la disposition, le point de vue et la structure squelettique diffèrent. Cette technologie a été acceptée par SIGGRAPH 2025.

Contexte Technique

La personnalisation d’actions fait référence à la génération de vidéos où le sujet exécute des actions dictées par des signaux de contrôle d’entrée. Les méthodes actuelles utilisent principalement la personnalisation guidée par pose ou le mouvement global, mais sont strictement contraintes par la structure spatiale (comme la disposition, le squelette et la cohérence du point de vue), ce qui rend difficile l’adaptation à différents sujets et scénarios.

Innovation Technique

FlexiAct surmonte les limitations des technologies existantes pour réaliser :

- Un contrôle précis des actions

- Une adaptation de la structure spatiale

- La préservation de la cohérence d’identité

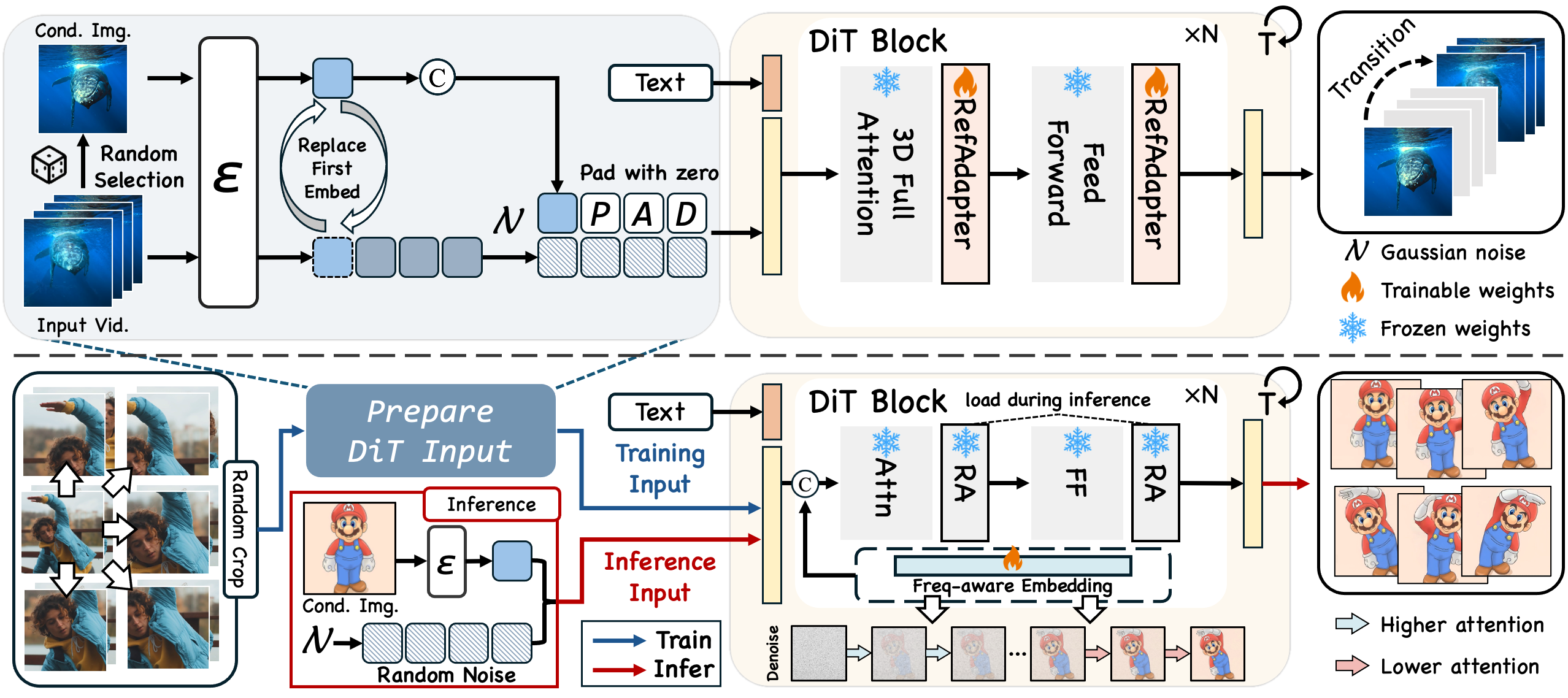

La technologie repose sur deux composants clés :

-

RefAdapter : Un adaptateur léger conditionné par l’image qui excelle dans l’adaptation spatiale et la préservation de la cohérence, équilibrant la cohérence d’apparence et la flexibilité structurelle.

-

FAE (Extraction d’Actions Consciente de la Fréquence) : Basé sur les observations de l’équipe de recherche, le processus de débruitage présente différents niveaux d’attention au mouvement (basse fréquence) et aux détails d’apparence (haute fréquence) à différentes étapes temporelles. FAE réalise l’extraction d’actions directement pendant le processus de débruitage, sans s’appuyer sur des architectures spatio-temporelles séparées.

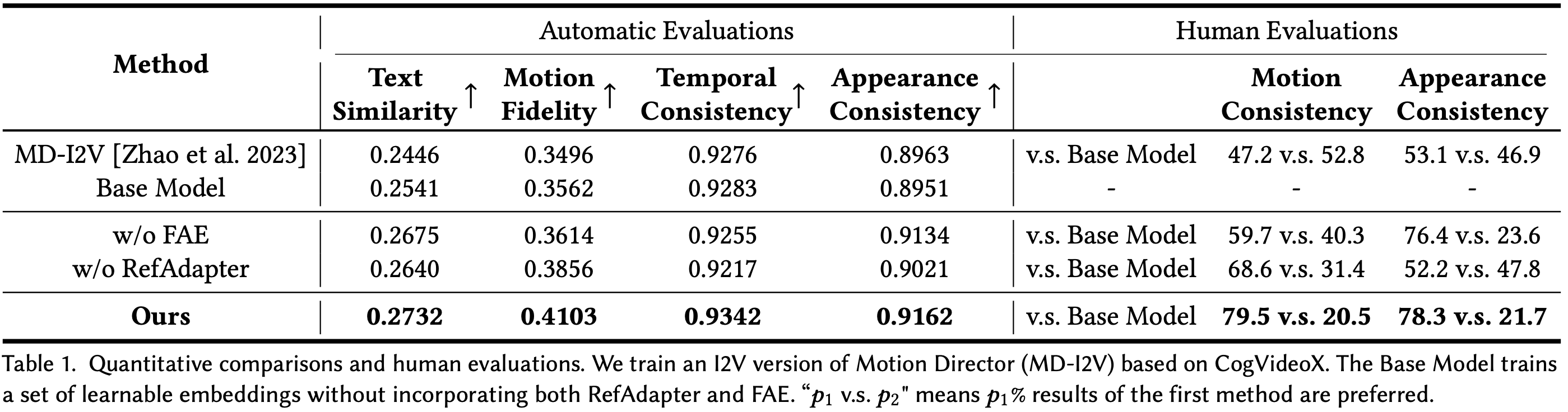

Par rapport aux méthodes existantes, FlexiAct démontre des avantages de performance significatifs dans des scénarios hétérogènes :

Scénarios d’Application

FlexiAct peut être largement appliqué dans divers scénarios :

- Transfert d’Actions Humaines : Transfert d’actions humaines à des personnages de jeu ou des figures de dessin animé

- Génération d’Animation Animale : Ajout d’actions dynamiques aux images d’animaux

- Effets Dynamiques de Caméra : Création d’effets dynamiques sous différentes perspectives de caméra

- Migration d’Actions Inter-domaines : Mise en œuvre de la migration d’actions entre différentes espèces, comme l’application d’actions humaines à des animaux

Données et Modèles

L’équipe de recherche a construit un ensemble de données dédié pour ce travail, comprenant divers types d’actions :

- Actions Humaines : Marche, accroupissement, saut, etc.

- Actions Animales : Course, saut, position debout, etc.

- Actions de Caméra : Mouvement vers l’avant, rotation, zoom, etc.

FlexiAct est développé sur la base du modèle CogVideoX-5B, réalisant des effets de transfert d’actions de haute qualité.

Ressources Open Source

L’équipe de recherche a mis en open source des ressources connexes, notamment :

- Modèles pré-entraînés FlexiAct (basés sur CogVideoX-5B)

- Ensembles de données pour l’entraînement et les tests

- Code pour l’entraînement et l’inférence

- Instructions détaillées et exemples

Plans Futurs

Selon le journal des mises à jour du projet, l’équipe de recherche prévoit de :

- Publier le code d’entraînement et d’inférence

- Publier les points de contrôle FlexiAct (basés sur CogVideoX-5B)

- Publier les données d’entraînement

- Publier une démo Gradio