Kunlun Wanwei lance SkyReels-V2, un modèle génératif de films de longueur infinie

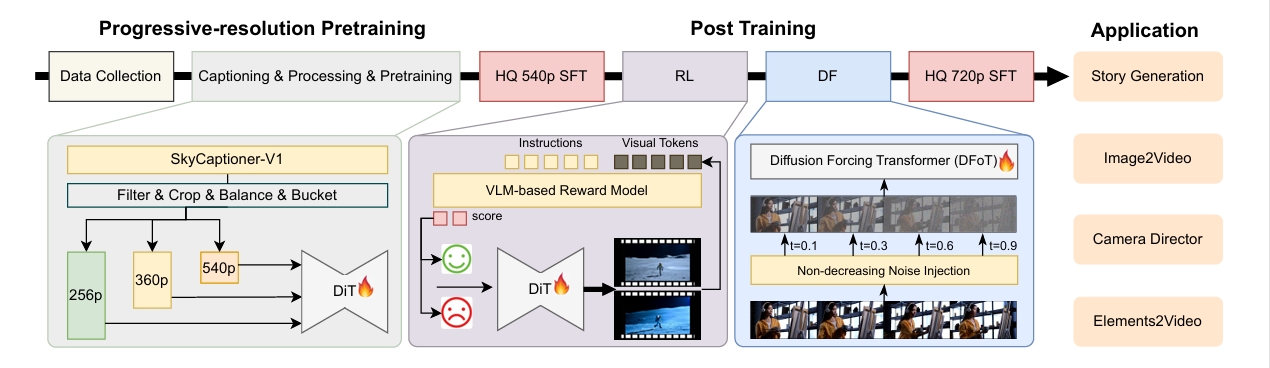

Le 21 avril, l’équipe SkyReels de Kunlun Wanwei a officiellement lancé et open-sourcé SkyReels-V2, le premier modèle génératif de films de longueur infinie au monde utilisant le cadre de Forçage de Diffusion (Diffusion Forcing). Ce modèle réalise une optimisation collaborative en combinant des grands modèles de langage multimodaux (MLLM), un pré-entraînement multi-étapes, l’apprentissage par renforcement et le cadre de Forçage de Diffusion, capable de générer des vidéos de haute qualité de 30 secondes, 40 secondes, voire plus longues.

🎥 Démonstrations

Les démonstrations ci-dessus présentent des vidéos de 30 secondes générées à l’aide du modèle de Forçage de Diffusion SkyReels-V2.

Innovations techniques

SkyReels-V2 réalise une génération vidéo de haute qualité grâce à plusieurs innovations techniques :

1. Modèle de compréhension vidéo de niveau cinématographique : SkyCaptioner-V1

L’équipe a conçu une méthode de représentation vidéo structurée qui combine des descriptions générales des LLM multimodaux avec un langage détaillé de plans issus de modèles sous-experts. Cette méthode identifie les types de sujets, les apparences, les expressions, les actions et les positions dans les vidéos.

SkyCaptioner-V1 comprend efficacement les données vidéo et génère des descriptions diverses alignées sur l’information structurelle originale. Il ne comprend pas seulement le contenu général de la vidéo, mais capture également le langage cinématographique professionnel dans les scènes de films, améliorant significativement l’adhérence aux instructions dans les vidéos générées. Ce modèle est maintenant open-source et disponible pour une utilisation directe.

2. Optimisation des préférences de mouvement

Grâce à un entraînement par apprentissage par renforcement utilisant des annotations humaines et des données de distorsion synthétique, l’équipe a résolu les problèmes de distorsion dynamique et de mouvements irréalistes dans les modèles existants de génération vidéo. Ils ont conçu un pipeline de collecte de données semi-automatique pour générer efficacement des paires de données de comparaison de préférences.

Cette approche permet à SkyReels-V2 d’exceller dans la dynamique du mouvement, générant un contenu vidéo fluide et réaliste qui répond aux exigences de mouvements de haute qualité.

3. Cadre efficace de Forçage de Diffusion

Pour réaliser des capacités de génération de vidéos longues, l’équipe a proposé une méthode de post-entraînement de Forçage de Diffusion. En ajustant finement des modèles de diffusion pré-entraînés et en les convertissant en modèles de Forçage de Diffusion, ils ont non seulement réduit les coûts d’entraînement mais aussi amélioré significativement l’efficacité de génération.

L’équipe a adopté un calendrier de temps de bruit non-décroissant, réduisant l’espace de recherche pour les calendriers de débruitage de trames continues de O(1e48) à O(1e32), permettant une génération efficace de vidéos longues.

4. Pré-entraînement à résolution progressive et optimisation post-entraînement multi-étapes

Pour développer un modèle de génération de films professionnel, le cadre d’assurance qualité multi-étapes de l’équipe a intégré des données provenant de trois sources principales : des ensembles de données généraux, des médias auto-collectés et des bibliothèques de ressources artistiques.

Sur cette base de données, l’équipe a d’abord établi un modèle de génération vidéo de base par pré-entraînement à résolution progressive, suivi de quatre étapes d’améliorations d’entraînement : ajustement fin supervisé initial équilibré conceptuellement, entraînement par apprentissage par renforcement spécifique au mouvement, cadre de Forçage de Diffusion et SFT de haute qualité.

Performance

SkyReels-V2 démontre d’excellentes performances dans de multiples évaluations :

-

Dans l’évaluation humaine multidimensionnelle SkyReels-Bench T2V, SkyReels-V2 a atteint les normes les plus élevées en adhérence aux instructions (3,15) et en cohérence (3,35), tout en maintenant une performance de premier niveau en qualité vidéo (3,34) et qualité de mouvement (2,74).

-

Dans l’évaluation automatisée VBench1.0, SkyReels-V2 a surpassé tous les modèles de comparaison avec le score total le plus élevé (83,9%) et le score de qualité (84,7%), y compris HunyuanVideo-13B et Wan2.1-14B.

Scénarios d’application

SkyReels-V2 fournit un support puissant pour plusieurs scénarios d’application pratiques :

-

Génération d’histoires : Capable de générer des vidéos de longueur théoriquement infinie en utilisant une méthode de fenêtre glissante et des techniques de stabilisation pour créer des plans longs avec des récits cohérents.

-

Synthèse d’image en vidéo : Offre deux méthodes pour la génération d’image en vidéo, surpassant d’autres modèles open-source dans toutes les dimensions de qualité et comparable aux modèles propriétaires.

-

Fonctionnalité de directeur de caméra : Grâce à des échantillons spécialement sélectionnés et des expériences d’ajustement fin, améliore significativement les effets photographiques, particulièrement dans la fluidité et la diversité des mouvements de caméra.

-

Génération d’élément en vidéo : Basée sur le modèle fondamental SkyReels-V2, la solution SkyReels-A2 peut combiner des éléments visuels arbitraires en vidéos cohérentes guidées par des instructions textuelles.

Modèles open-source

L’équipe SkyReels de Kunlun Wanwei a entièrement open-sourcé SkyCaptioner-V1 et les modèles de la série SkyReels-V2 (y compris Forçage de Diffusion, texte en vidéo, image en vidéo, directeur de caméra et modèles d’élément en vidéo) en diverses tailles (1,3B, 5B, 14B) pour promouvoir davantage de recherche et d’applications dans le milieu académique et industriel.