ByteDance lance UNO : Extension des capacités de génération du moins au plus

L’équipe d’Intelligence Créative de ByteDance a récemment lancé un cadre universel de génération d’images appelé UNO, basé sur le concept fondamental de “Généralisation du moins au plus” (Less-to-More Generalization) et offrant une plus grande contrôlabilité grâce à la génération contextuelle, permettant une génération d’images de haute qualité d’un à plusieurs sujets.

Le cadre UNO fournit aux créateurs de contenu des outils plus flexibles et puissants, permettant un contrôle précis dans des scènes complexes tout en maintenant les caractéristiques de multiples objets, rendant les images générées par IA plus conformes aux intentions des créateurs.

Défis clés relevés

Les modèles traditionnels de génération d’images par IA font face à deux défis majeurs lorsqu’ils traitent des scènes avec plusieurs objets spécifiques :

- Problème d’évolutivité des données : L’expansion des ensembles de données d’un seul sujet à plusieurs sujets est particulièrement difficile, car les données appariées de haute qualité, multi-angles et cohérentes au niveau du sujet sont difficiles à acquérir à grande échelle

- Problème d’extensibilité des sujets : Les méthodes existantes se concentrent principalement sur la génération d’un seul sujet et peinent à s’adapter aux exigences complexes des scénarios à sujets multiples

UNO résout ces problèmes grâce à des approches uniques, permettant des résultats de génération d’images plus cohérents et contrôlables.

Principes techniques expliqués

Le cadre UNO introduit deux innovations techniques clés :

-

Alignement progressif intermodal : Une stratégie d’entraînement en deux étapes

- Première étape : Ajustement fin d’un modèle T2I pré-entraîné en utilisant des données à sujet unique générées en contexte, le transformant en un modèle S2I (Subject-to-Image)

- Deuxième étape : Poursuite de l’entraînement avec des paires de données à sujets multiples générées pour améliorer la capacité du modèle à gérer des scènes complexes

-

Embedding de Position Rotatif Universel (UnoPE) : Une technique spéciale d’encodage de position qui résout efficacement les problèmes de confusion d’attributs lors de l’extension du contrôle visuel des sujets, permettant au modèle de distinguer et de maintenir avec précision les caractéristiques de plusieurs sujets

Pipeline de synthèse de données à haute cohérence

L’une des innovations majeures d’UNO est son pipeline de synthèse de données à haute cohérence :

- Exploitation des capacités inhérentes de génération en contexte des transformateurs de diffusion : Utilisation maximale du potentiel des modèles de diffusion actuels

- Génération de données appariées multi-sujets à haute cohérence : Garantie de la qualité et de la cohérence des données d’entraînement grâce à des stratégies spécifiques de génération de données

- Processus d’entraînement itératif : Évolution progressive des modèles texte-vers-image vers des modèles complexes gérant plusieurs conditions d’image

Cette approche résout non seulement le défi de l’acquisition de données, mais améliore également la qualité et la cohérence des résultats générés.

Scénarios d’application pratique

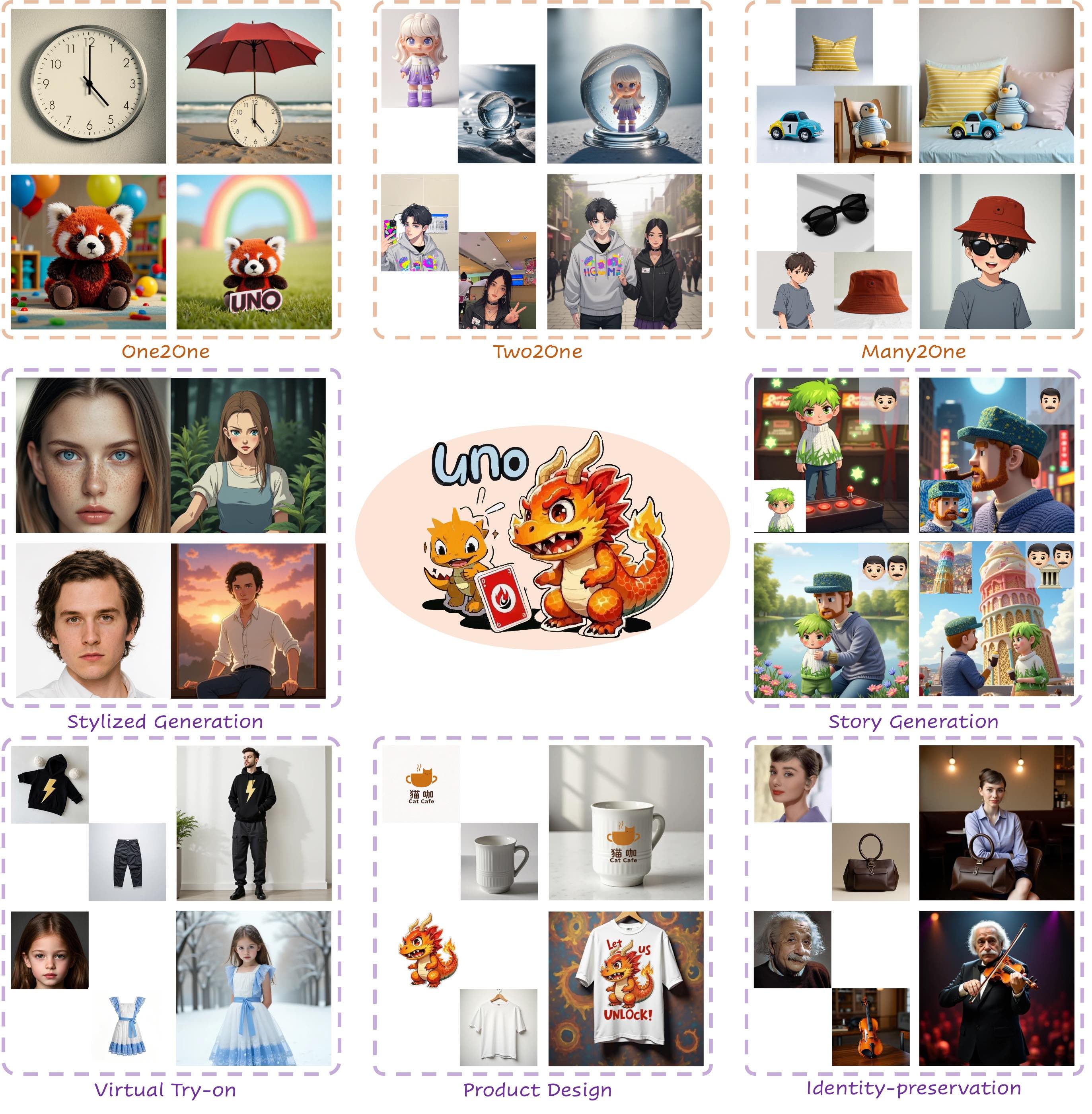

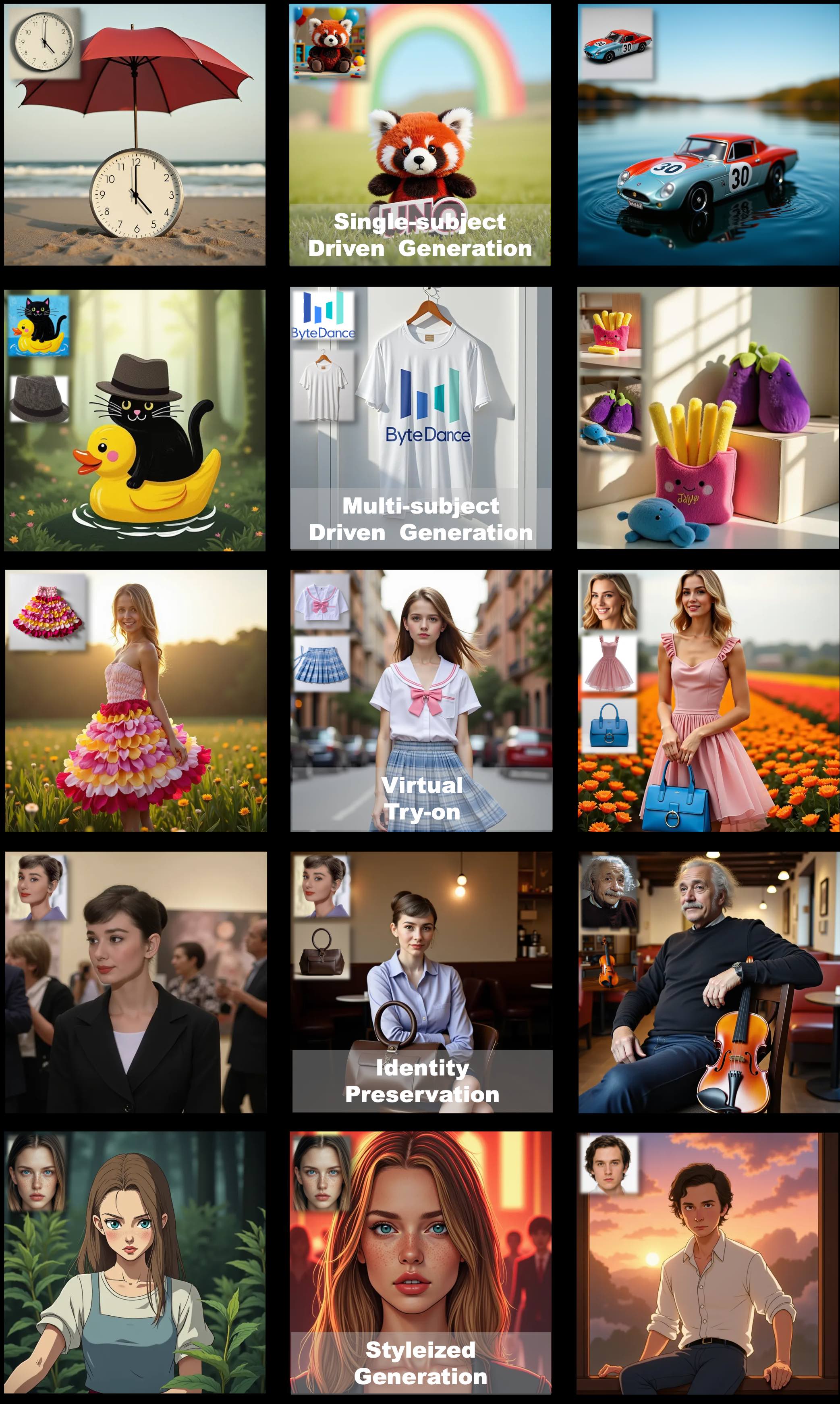

Le modèle UNO démontre des capacités pratiques diverses, applicables à :

- Génération personnalisée multi-sujets : Placement de plusieurs objets spécifiques dans la même scène tout en maintenant leurs caractéristiques individuelles

- Essayage virtuel et présentation de produits : Présentation de produits ou services spécifiques dans différents environnements

- Contenu personnalisé de marque : Intégration d’éléments de marque dans divers scénarios tout en maintenant la cohérence de la marque

- Conception créative et production de contenu : Offre aux designers et créateurs de contenu de possibilités créatives plus riches

Capacités de généralisation

Le modèle UNO démontre de puissantes capacités de généralisation, unifiant diverses tâches :

- Transfert de sujet unique à sujets multiples : Expansion des scènes simples aux scénarios complexes

- Adaptation à différents styles : Adaptation aux différentes exigences stylistiques tout en maintenant les caractéristiques du sujet

- Intégration de multiples tâches créatives : Un modèle gérant des tâches qui nécessitaient auparavant plusieurs modèles spécialisés

Expérience en ligne

Vous pouvez expérimenter personnellement les puissantes capacités d’UNO via l’interface suivante :

Paramètres techniques et informations open source

Le modèle UNO est développé sur la base de FLUX.1 et ouvert par l’équipe ByteDance, comprenant le code d’entraînement, le code d’inférence et les poids du modèle.

Le projet est disponible sur GitHub, permettant aux chercheurs et développeurs d’accéder et d’utiliser librement la technologie. Le code du projet suit la licence Apache 2.0, tandis que les poids du modèle sont publiés sous licence CC BY-NC 4.0. Il est important de noter que tout modèle lié au modèle de base FLUX.1-dev doit se conformer aux termes de la licence originale.